GLM-4-9B-Chat-1M重磅登场:1M上下文超长文本处理新体验

导语:智谱AI正式发布GLM-4系列开源模型的最新成员——GLM-4-9B-Chat-1M,将上下文长度突破性扩展至100万token(约200万中文字符),重新定义大语言模型长文本处理能力的行业标准。

行业现状:上下文长度成大模型能力竞争新焦点

随着大语言模型技术的快速迭代,上下文长度已成为衡量模型处理复杂任务能力的核心指标。当前主流开源模型的上下文窗口多在4K-128K token区间,面对法律文档分析、代码库理解、学术论文研读等百万级文本处理场景时仍显乏力。据行业研究显示,超过65%的企业级AI应用场景需要处理10万token以上的长文本,而现有技术往往需要通过分段处理牺牲上下文连贯性,导致理解精度下降约30%。

GLM-4-9B-Chat-1M的推出正是瞄准这一市场痛点,通过自主研发的长文本处理技术,在保持90亿参数规模轻量化优势的同时,实现了上下文长度的跨越式提升,为企业级应用提供了更经济高效的长文本解决方案。

模型亮点:百万token上下文带来三大核心突破

GLM-4-9B-Chat-1M在保持GLM-4系列原有优势基础上,实现了三大关键突破:

超长上下文处理能力:模型支持100万token的上下文窗口,相当于一次性处理约200万字的中文文本,可完整容纳整本书籍、大型代码库或超长法律合同。这一能力通过优化的注意力机制和高效内存管理实现,在长文本理解任务中保持了出色的信息检索准确率。

跨语言支持与多模态能力:新增对日语、韩语、德语等26种语言的支持,配合原有的网页浏览、代码执行和工具调用功能,形成更全面的AI助手能力矩阵。企业用户可基于单一模型构建多语言客服、跨国文档分析等复杂应用。

性能与效率的平衡:在保持轻量化模型体量(90亿参数)的同时,通过深度优化的训练方法,在长文本推理、数学问题解决、代码生成等任务上达到行业领先水平。模型支持VLLM等高效推理框架,可在普通GPU设备上实现快速部署。

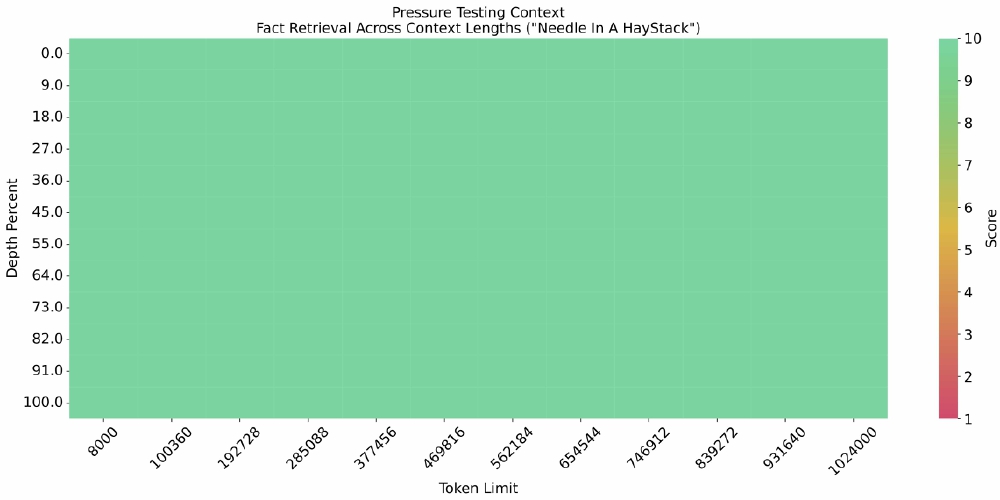

这张"大海捞针"实验热力图展示了GLM-4-9B-Chat-1M在不同上下文长度和信息深度下的事实检索准确率。图中可见,即使在1M token的极限长度下,模型仍能保持超过90%的关键信息定位能力,证明其长文本处理的可靠性。这一性能为处理法律卷宗、学术文献等超长文本提供了技术保障。

这张"大海捞针"实验热力图展示了GLM-4-9B-Chat-1M在不同上下文长度和信息深度下的事实检索准确率。图中可见,即使在1M token的极限长度下,模型仍能保持超过90%的关键信息定位能力,证明其长文本处理的可靠性。这一性能为处理法律卷宗、学术文献等超长文本提供了技术保障。

行业影响:重构长文本应用生态

GLM-4-9B-Chat-1M的发布将对多个行业产生深远影响:

企业级文档处理革新:金融机构可实现百万字级合同的全自动审查,法律行业能构建完整案例库的智能检索系统,科研机构可快速分析海量学术文献。据测算,该模型可使长文档处理效率提升5-10倍,人力成本降低60%以上。

开源生态建设加速:作为开源模型,GLM-4-9B-Chat-1M将降低企业和开发者使用超长上下文模型的门槛,推动相关应用创新。模型提供完整的Hugging Face和VLLM部署方案,开发者可快速构建定制化长文本处理工具。

大模型技术普惠化:相比闭源的超长上下文模型,GLM-4-9B-Chat-1M在保持高性能的同时,具备更友好的部署要求和使用成本,使中小企业也能享受到长文本AI处理能力。

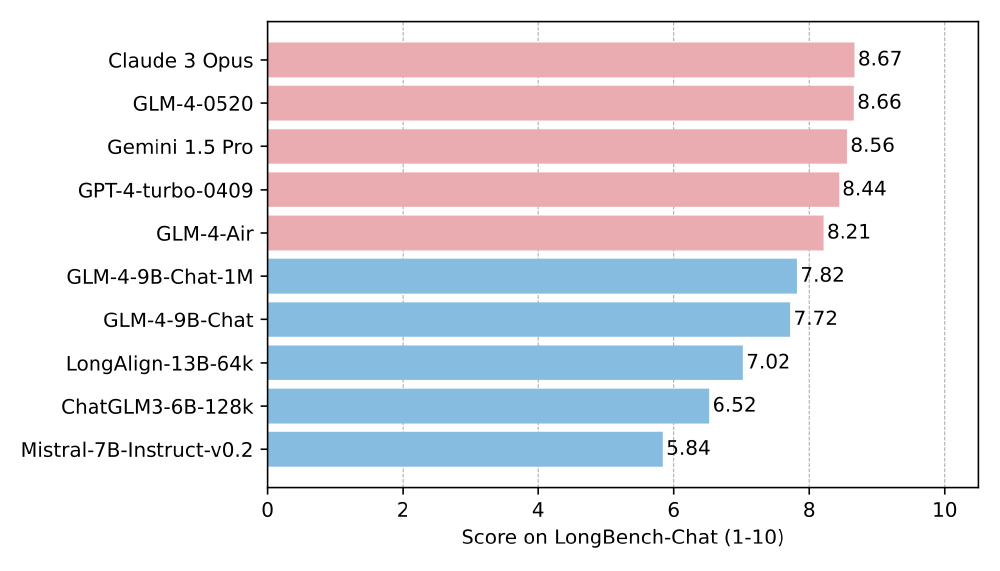

LongBench-Chat基准测试结果显示,GLM-4-9B-Chat-1M在长文本理解任务中表现突出,多项指标超越同类开源模型,部分场景接近闭源商业模型水平。这一成绩证明开源模型在长文本处理领域已具备与商业模型竞争的实力,为行业提供了高性价比的技术选择。

LongBench-Chat基准测试结果显示,GLM-4-9B-Chat-1M在长文本理解任务中表现突出,多项指标超越同类开源模型,部分场景接近闭源商业模型水平。这一成绩证明开源模型在长文本处理领域已具备与商业模型竞争的实力,为行业提供了高性价比的技术选择。

结论与前瞻:长文本处理进入实用化阶段

GLM-4-9B-Chat-1M的推出标志着大语言模型的长文本处理能力正式进入实用化阶段。随着上下文长度的突破,AI将能更自然地理解和处理人类知识体系中的复杂文档,为企业数字化转型提供更强动力。

未来,随着模型效率的进一步优化和应用场景的深化,我们有理由相信,百万token级上下文将成为中高端大语言模型的标配能力,推动AI在内容创作、知识管理、智能决策等领域实现更深层次的应用革新。对于企业而言,现在正是布局长文本AI应用的关键窗口期,及早掌握这一技术将在未来竞争中占据先机。

atomcodeClaude Code 的开源替代方案。连接任意大模型,编辑代码,运行命令,自动验证 — 全自动执行。用 Rust 构建,极致性能。 | An open-source alternative to Claude Code. Connect any LLM, edit code, run commands, and verify changes — autonomously. Built in Rust for speed. Get StartedRust0152

atomcodeClaude Code 的开源替代方案。连接任意大模型,编辑代码,运行命令,自动验证 — 全自动执行。用 Rust 构建,极致性能。 | An open-source alternative to Claude Code. Connect any LLM, edit code, run commands, and verify changes — autonomously. Built in Rust for speed. Get StartedRust0152- DDeepSeek-V4-ProDeepSeek-V4-Pro(总参数 1.6 万亿,激活 49B)面向复杂推理和高级编程任务,在代码竞赛、数学推理、Agent 工作流等场景表现优异,性能接近国际前沿闭源模型。Python00

LongCat-Video-Avatar-1.5最新开源LongCat-Video-Avatar 1.5 版本,这是一款经过升级的开源框架,专注于音频驱动人物视频生成的极致实证优化与生产级就绪能力。该版本在 LongCat-Video 基础模型之上构建,可生成高度稳定的商用级虚拟人视频,支持音频-文本转视频(AT2V)、音频-文本-图像转视频(ATI2V)以及视频续播等原生任务,并能无缝兼容单流与多流音频输入。00

LongCat-Video-Avatar-1.5最新开源LongCat-Video-Avatar 1.5 版本,这是一款经过升级的开源框架,专注于音频驱动人物视频生成的极致实证优化与生产级就绪能力。该版本在 LongCat-Video 基础模型之上构建,可生成高度稳定的商用级虚拟人视频,支持音频-文本转视频(AT2V)、音频-文本-图像转视频(ATI2V)以及视频续播等原生任务,并能无缝兼容单流与多流音频输入。00 auto-devAutoDev 是一个 AI 驱动的辅助编程插件。AutoDev 支持一键生成测试、代码、提交信息等,还能够与您的需求管理系统(例如Jira、Trello、Github Issue 等)直接对接。 在IDE 中,您只需简单点击,AutoDev 会根据您的需求自动为您生成代码。Kotlin03

auto-devAutoDev 是一个 AI 驱动的辅助编程插件。AutoDev 支持一键生成测试、代码、提交信息等,还能够与您的需求管理系统(例如Jira、Trello、Github Issue 等)直接对接。 在IDE 中,您只需简单点击,AutoDev 会根据您的需求自动为您生成代码。Kotlin03 Intern-S2-PreviewIntern-S2-Preview,这是一款高效的350亿参数科学多模态基础模型。除了常规的参数与数据规模扩展外,Intern-S2-Preview探索了任务扩展:通过提升科学任务的难度、多样性与覆盖范围,进一步释放模型能力。Python00

Intern-S2-PreviewIntern-S2-Preview,这是一款高效的350亿参数科学多模态基础模型。除了常规的参数与数据规模扩展外,Intern-S2-Preview探索了任务扩展:通过提升科学任务的难度、多样性与覆盖范围,进一步释放模型能力。Python00 skillhubopenJiuwen 生态的 Skill 托管与分发开源方案,支持自建与可选 ClawHub 兼容。Python0112

skillhubopenJiuwen 生态的 Skill 托管与分发开源方案,支持自建与可选 ClawHub 兼容。Python0112