探索智能的视觉守护者:AdaptiveAttention

在这个数字化的时代,图像描述生成(Image Captioning)已经成为人工智能领域的一大热点。AdaptiveAttention项目,正是一个专注于优化这一领域的创新性开源实现,它引入了一种名为“视觉哨兵”的机制,能智能地决定何时关注图像的哪些部分,从而生成更精准的图像描述。

项目介绍

AdaptiveAttention是基于Lua和Torch的深度学习框架实现,其灵感来自于论文"Knowing When to Look: Adaptive Attention via A Visual Sentinel for Image Captioning"。这个项目的核心是动态调整注意力机制,即“视觉哨兵”,它可以识别并强调图像中最重要的信息,提高图像描述的准确性和连贯性。

项目技术分析

该项目使用了ResNet预训练模型,并且在训练过程中分为两个阶段。首先,对语言模型进行训练,然后在保持CNN权重不变的情况下,再进行微调。这个过程通过自适应注意力机制,可以学习到如何在每个时间步长中选择性地关注图像的不同区域,避免不必要的计算资源浪费。

此外,项目依赖于一些Torch库,如cudnn.torch,torch-hdf5,以及iTorch,这些工具让模型的训练和调试更加便捷。

应用场景

AdaptiveAttention可以在多个场景下发挥作用:

- 社交媒体:自动为上传的照片生成描述,方便用户分享。

- 无障碍应用:帮助视障人士理解图片内容。

- 搜索引擎:增强搜索结果的相关性,提升用户体验。

- 图像数据库管理:自动标记和归档大量图像。

项目特点

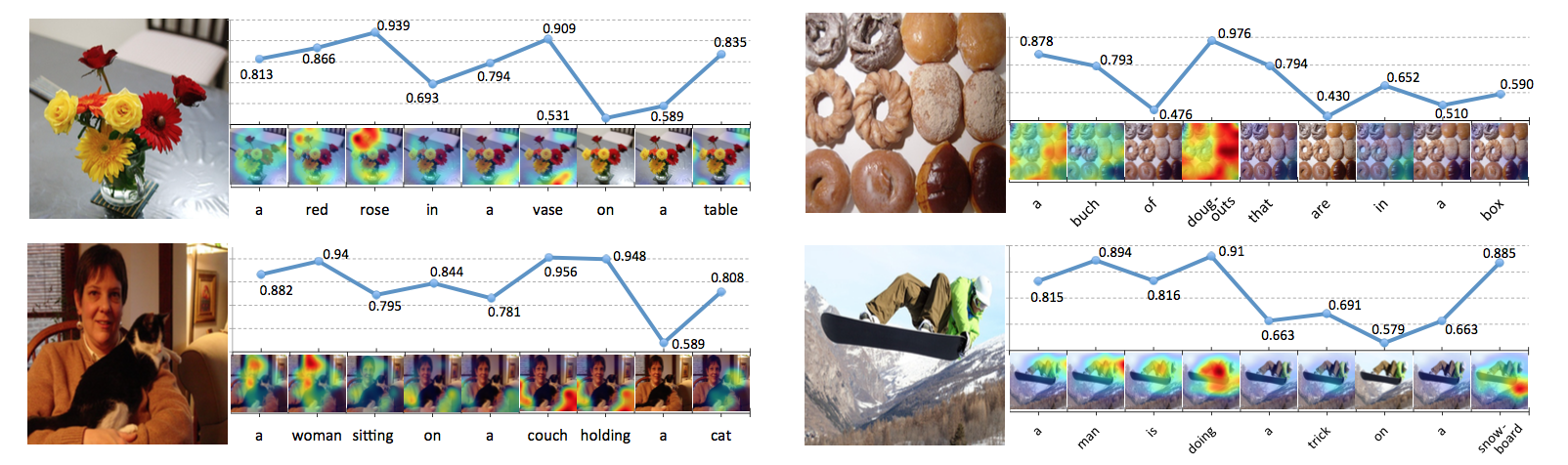

- 自适应注意力:能够智能地动态调整对图像的关注度,只聚焦在关键信息上。

- 可视化结果:提供丰富的可视化结果展示,直观呈现注意力分布情况。

- 易于使用:提供了预训练模型,无需GPU也可直接进行推理。

- 开源社区支持:基于强大的Torch框架,便于进一步开发和扩展。

如果你对利用AI创造生动的图像描述感兴趣,或者正在寻找一种高效的方法来处理图像数据,那么AdaptiveAttention无疑是你的理想之选。立即尝试下载并开始探索吧!

参考文献

如果使用本代码作为研究的一部分,请引用以下论文:

@misc{Lu2017Adaptive,

author = {Lu, Jiasen and Xiong, Caiming and Parikh, Devi and Socher, Richard},

title = {Knowing When to Look: Adaptive Attention via A Visual Sentinel for Image Captioning},

journal = {CVPR},

year = {2017}

}

致谢

AdaptiveAttention项目是在NeuralTalk2的基础上发展起来的。感谢Torch团队和Facebook的ResNet实现。

许可证

本项目遵循BSD 3-Clause License。

atomcodeClaude Code 的开源替代方案。连接任意大模型,编辑代码,运行命令,自动验证 — 全自动执行。用 Rust 构建,极致性能。 | An open-source alternative to Claude Code. Connect any LLM, edit code, run commands, and verify changes — autonomously. Built in Rust for speed. Get StartedRust0152

atomcodeClaude Code 的开源替代方案。连接任意大模型,编辑代码,运行命令,自动验证 — 全自动执行。用 Rust 构建,极致性能。 | An open-source alternative to Claude Code. Connect any LLM, edit code, run commands, and verify changes — autonomously. Built in Rust for speed. Get StartedRust0152- DDeepSeek-V4-ProDeepSeek-V4-Pro(总参数 1.6 万亿,激活 49B)面向复杂推理和高级编程任务,在代码竞赛、数学推理、Agent 工作流等场景表现优异,性能接近国际前沿闭源模型。Python00

LongCat-Video-Avatar-1.5最新开源LongCat-Video-Avatar 1.5 版本,这是一款经过升级的开源框架,专注于音频驱动人物视频生成的极致实证优化与生产级就绪能力。该版本在 LongCat-Video 基础模型之上构建,可生成高度稳定的商用级虚拟人视频,支持音频-文本转视频(AT2V)、音频-文本-图像转视频(ATI2V)以及视频续播等原生任务,并能无缝兼容单流与多流音频输入。00

LongCat-Video-Avatar-1.5最新开源LongCat-Video-Avatar 1.5 版本,这是一款经过升级的开源框架,专注于音频驱动人物视频生成的极致实证优化与生产级就绪能力。该版本在 LongCat-Video 基础模型之上构建,可生成高度稳定的商用级虚拟人视频,支持音频-文本转视频(AT2V)、音频-文本-图像转视频(ATI2V)以及视频续播等原生任务,并能无缝兼容单流与多流音频输入。00 auto-devAutoDev 是一个 AI 驱动的辅助编程插件。AutoDev 支持一键生成测试、代码、提交信息等,还能够与您的需求管理系统(例如Jira、Trello、Github Issue 等)直接对接。 在IDE 中,您只需简单点击,AutoDev 会根据您的需求自动为您生成代码。Kotlin03

auto-devAutoDev 是一个 AI 驱动的辅助编程插件。AutoDev 支持一键生成测试、代码、提交信息等,还能够与您的需求管理系统(例如Jira、Trello、Github Issue 等)直接对接。 在IDE 中,您只需简单点击,AutoDev 会根据您的需求自动为您生成代码。Kotlin03 Intern-S2-PreviewIntern-S2-Preview,这是一款高效的350亿参数科学多模态基础模型。除了常规的参数与数据规模扩展外,Intern-S2-Preview探索了任务扩展:通过提升科学任务的难度、多样性与覆盖范围,进一步释放模型能力。Python00

Intern-S2-PreviewIntern-S2-Preview,这是一款高效的350亿参数科学多模态基础模型。除了常规的参数与数据规模扩展外,Intern-S2-Preview探索了任务扩展:通过提升科学任务的难度、多样性与覆盖范围,进一步释放模型能力。Python00 skillhubopenJiuwen 生态的 Skill 托管与分发开源方案,支持自建与可选 ClawHub 兼容。Python0112

skillhubopenJiuwen 生态的 Skill 托管与分发开源方案,支持自建与可选 ClawHub 兼容。Python0112