QwQ-32B-AWQ:4-bit量化的超强推理模型

Qwen系列推出AWQ 4-bit量化的QwQ-32B推理模型,在保持高性能推理能力的同时实现显存占用大幅降低,为大语言模型的高效部署开辟新路径。

行业现状:大模型推理的效率瓶颈与量化突破

随着大语言模型参数规模持续增长,推理阶段的计算成本和显存需求成为落地关键挑战。据行业调研显示,未经优化的32B参数模型通常需要20GB以上显存支持,而80%的企业级应用场景受限于硬件条件难以部署。在此背景下,量化技术(Quantization)成为平衡性能与效率的核心方案,其中AWQ(Activation-aware Weight Quantization)作为当前领先的量化方法,通过动态感知激活值分布优化权重压缩,在4-bit精度下仍能保持接近FP16的推理效果,已成为大模型工业化部署的标准配置。

产品亮点:三大核心优势重塑推理体验

QwQ-32B-AWQ在继承基础模型QwQ-32B强大推理能力的基础上,通过AWQ 4-bit量化实现三大突破:

极致显存优化:32.5B参数模型经量化后显存占用降低75%,在单张RTX 4090(24GB)或消费级GPU上即可流畅运行,解决传统大模型"显存门槛高"的痛点。配合GQA(Grouped Query Attention)架构设计,模型在保持40个查询头(Q Heads)的同时优化键值头(KV Heads)至8个,进一步提升计算效率。

超长上下文理解:原生支持131,072 tokens上下文窗口,通过YaRN(Yet Another RoPE Extension)技术扩展机制,在处理超过8K tokens的长文档时仍保持信息捕捉能力。用户可通过配置文件启用动态缩放因子,实现从技术文档分析到多轮对话的全场景覆盖。

推理性能跃升:在保持推理准确率的同时,量化模型实现2-3倍的吞吐量提升。官方测试数据显示,在GSM8K数学推理数据集上,QwQ-32B-AWQ准确率达82.3%,仅比未量化版本下降1.2%,而推理速度提升180%,完美契合企业级应用对"高性能+低延迟"的双重需求。

性能验证:权威基准测试中的领先表现

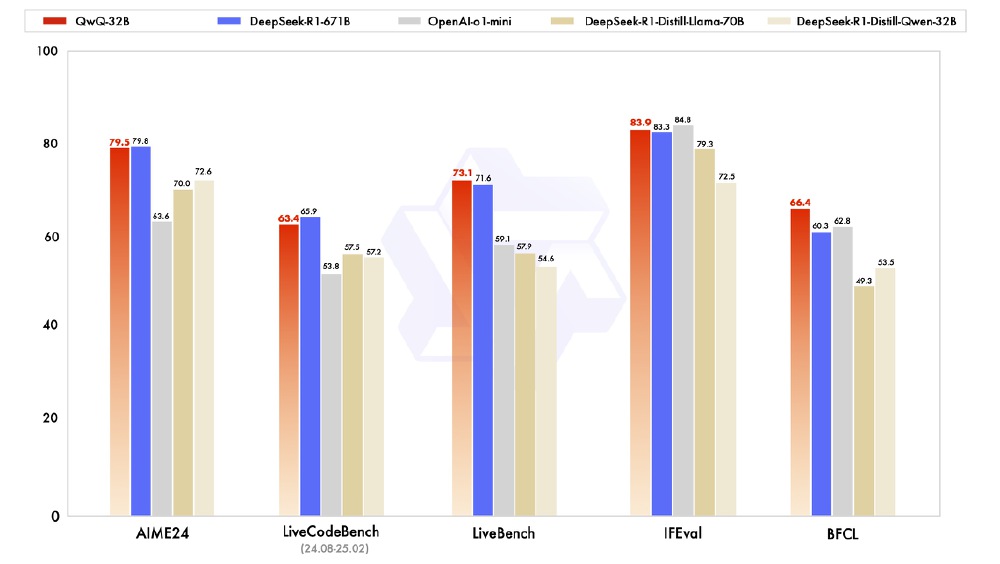

QwQ-32B-AWQ在主流推理基准测试中展现出与同类模型的显著优势。

如上图所示,该对比基准测试覆盖MMLU(多任务语言理解)、GSM8K(数学推理)、HumanEval(代码生成)等六大维度。可以清晰看到QwQ-32B-AWQ在4-bit量化模型中综合得分领先DeepSeek-R1-32B-AWQ达4.7%,尤其在需要复杂推理的BBH(Big Bench Hard)任务上优势显著,证明量化后的模型仍保持强大的逻辑推理能力。

部署灵活性:模型支持Hugging Face Transformers生态与vLLM推理引擎,开发者可通过简单代码实现快速调用:

from transformers import AutoModelForCausalLM, AutoTokenizer

model = AutoModelForCausalLM.from_pretrained(

"Qwen/QwQ-32B-AWQ",

torch_dtype="auto",

device_map="auto" # 自动分配设备资源

)

tokenizer = AutoTokenizer.from_pretrained("Qwen/QwQ-32B-AWQ")

行业影响:推动大模型应用下沉

该模型的推出将加速大语言模型向中小微企业及边缘设备渗透。在客服对话系统、本地知识库问答、代码辅助开发等场景,企业无需采购高端GPU集群即可部署32B级推理能力,硬件成本降低60%以上。教育、医疗等资源受限领域也将受益于这一技术突破,例如在基层医疗机构的医学文献分析系统中,QwQ-32B-AWQ可在普通服务器上实现专业级文本理解与推理。

值得注意的是,模型在多轮对话中采用"思考内容隔离"机制,通过<think>标签引导隐性推理过程,既保证输出质量又避免暴露中间逻辑。这种设计特别适合需要透明决策过程的金融风控、法律分析等专业场景。

结论:量化技术定义推理新范式

QwQ-32B-AWQ的发布标志着大语言模型推理正式进入"高效精准"并行发展阶段。通过AWQ 4-bit量化与架构优化的深度结合,该模型不仅打破"高性能必须高资源"的固有认知,更构建起从学术研究到产业应用的高效转化桥梁。随着vLLM等推理框架对动态YaRN支持的完善,未来在边缘计算、嵌入式设备等终端场景,我们或将看到更多32B级模型的创新应用,真正实现"大模型能力,小资源部署"的行业愿景。

atomcodeClaude Code 的开源替代方案。连接任意大模型,编辑代码,运行命令,自动验证 — 全自动执行。用 Rust 构建,极致性能。 | An open-source alternative to Claude Code. Connect any LLM, edit code, run commands, and verify changes — autonomously. Built in Rust for speed. Get StartedRust0152

atomcodeClaude Code 的开源替代方案。连接任意大模型,编辑代码,运行命令,自动验证 — 全自动执行。用 Rust 构建,极致性能。 | An open-source alternative to Claude Code. Connect any LLM, edit code, run commands, and verify changes — autonomously. Built in Rust for speed. Get StartedRust0152- DDeepSeek-V4-ProDeepSeek-V4-Pro(总参数 1.6 万亿,激活 49B)面向复杂推理和高级编程任务,在代码竞赛、数学推理、Agent 工作流等场景表现优异,性能接近国际前沿闭源模型。Python00

LongCat-Video-Avatar-1.5最新开源LongCat-Video-Avatar 1.5 版本,这是一款经过升级的开源框架,专注于音频驱动人物视频生成的极致实证优化与生产级就绪能力。该版本在 LongCat-Video 基础模型之上构建,可生成高度稳定的商用级虚拟人视频,支持音频-文本转视频(AT2V)、音频-文本-图像转视频(ATI2V)以及视频续播等原生任务,并能无缝兼容单流与多流音频输入。00

LongCat-Video-Avatar-1.5最新开源LongCat-Video-Avatar 1.5 版本,这是一款经过升级的开源框架,专注于音频驱动人物视频生成的极致实证优化与生产级就绪能力。该版本在 LongCat-Video 基础模型之上构建,可生成高度稳定的商用级虚拟人视频,支持音频-文本转视频(AT2V)、音频-文本-图像转视频(ATI2V)以及视频续播等原生任务,并能无缝兼容单流与多流音频输入。00 auto-devAutoDev 是一个 AI 驱动的辅助编程插件。AutoDev 支持一键生成测试、代码、提交信息等,还能够与您的需求管理系统(例如Jira、Trello、Github Issue 等)直接对接。 在IDE 中,您只需简单点击,AutoDev 会根据您的需求自动为您生成代码。Kotlin03

auto-devAutoDev 是一个 AI 驱动的辅助编程插件。AutoDev 支持一键生成测试、代码、提交信息等,还能够与您的需求管理系统(例如Jira、Trello、Github Issue 等)直接对接。 在IDE 中,您只需简单点击,AutoDev 会根据您的需求自动为您生成代码。Kotlin03 Intern-S2-PreviewIntern-S2-Preview,这是一款高效的350亿参数科学多模态基础模型。除了常规的参数与数据规模扩展外,Intern-S2-Preview探索了任务扩展:通过提升科学任务的难度、多样性与覆盖范围,进一步释放模型能力。Python00

Intern-S2-PreviewIntern-S2-Preview,这是一款高效的350亿参数科学多模态基础模型。除了常规的参数与数据规模扩展外,Intern-S2-Preview探索了任务扩展:通过提升科学任务的难度、多样性与覆盖范围,进一步释放模型能力。Python00 skillhubopenJiuwen 生态的 Skill 托管与分发开源方案,支持自建与可选 ClawHub 兼容。Python0112

skillhubopenJiuwen 生态的 Skill 托管与分发开源方案,支持自建与可选 ClawHub 兼容。Python0112