Kong AI网关革命:多模型支持与无代码AI应用

2026-02-04 04:25:45作者:虞亚竹Luna

你还在为企业AI应用落地烦恼吗?开发团队不懂API网关配置,运维人员缺乏AI模型管理经验,多模型集成导致系统复杂度飙升?Kong AI网关彻底解决这些痛点,让普通用户也能通过无代码方式构建企业级AI应用。

读完本文你将获得:

- 零基础配置多模型AI服务的完整指南

- 无需编码实现AI请求/响应转换的实用技巧

- 企业级AI流量管控与安全防护最佳实践

- 3分钟部署LLM应用的快速入门方案

什么是Kong AI网关?

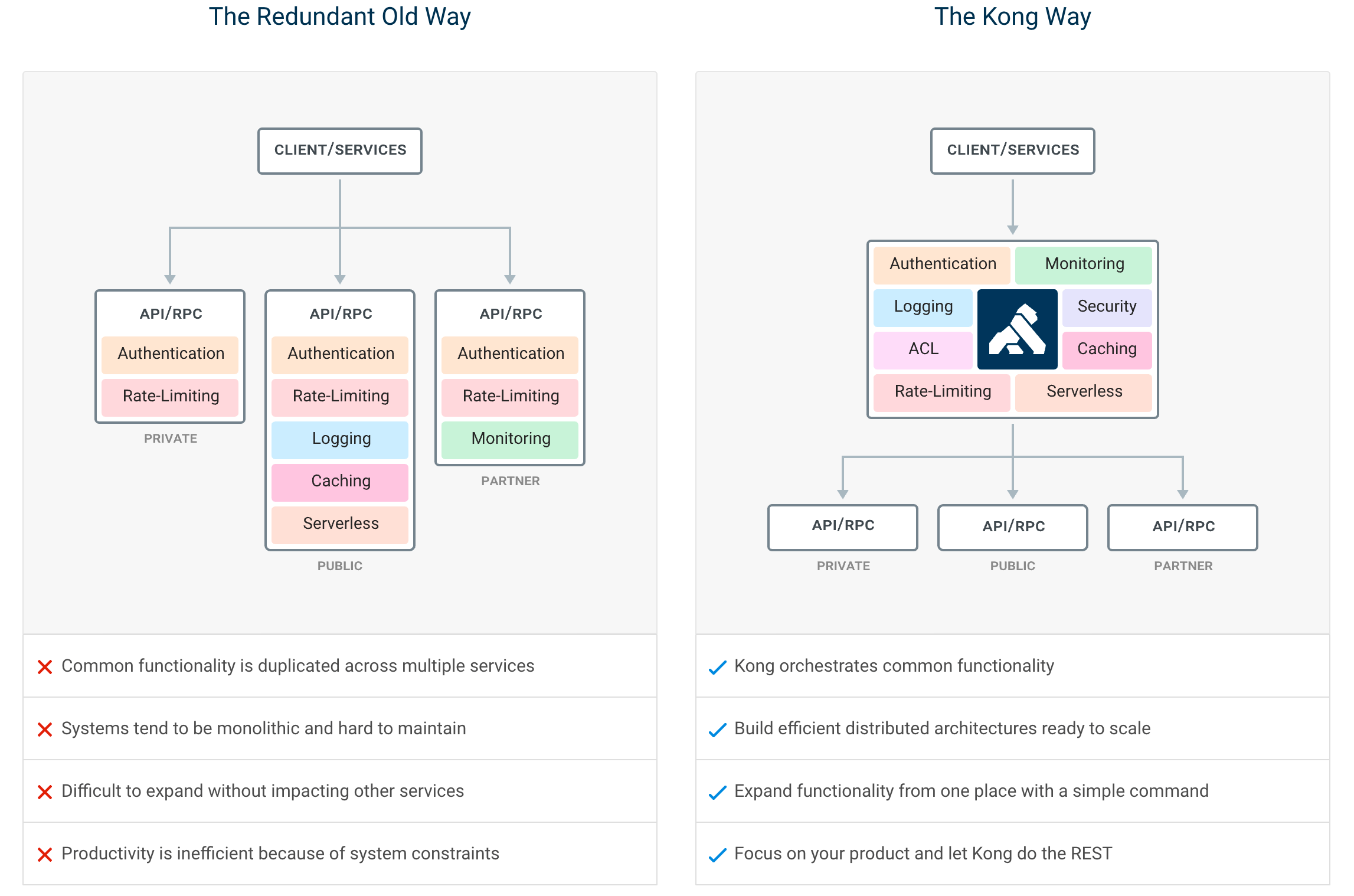

Kong作为云原生API网关(API Gateway)的领军者,在最新版本中推出了革命性的AI网关功能。通过插件化架构,Kong将传统API管理能力与AI模型调度深度融合,形成了业内首个支持多模型统一管控的无代码AI网关解决方案。

核心优势包括:

- 多模型聚合:同时对接OpenAI、Anthropic、国产大模型等20+主流AI服务

- 全流程可视化:通过Admin GUI实现AI流量的可观测性

- 零代码编排:使用AI插件实现提示词工程与请求转换

- 企业级安全:内置AI Prompt Guard防护注入攻击

核心AI插件矩阵

Kong通过插件化设计实现AI功能的解耦与扩展,主要AI插件包括:

| 插件名称 | 功能描述 | 典型应用场景 |

|---|---|---|

| ai-proxy | 多模型统一接入层 | 统一API密钥管理、模型负载均衡 |

| ai-prompt-template | 提示词模板引擎 | 标准化客服问答、动态变量注入 |

| ai-request-transformer | 请求格式转换 | 多模型协议适配、参数映射 |

| ai-response-transformer | 响应结果处理 | 格式化输出、敏感信息过滤 |

| ai-prompt-guard | 提示词安全检测 | 防注入攻击、合规性检查 |

这些插件可通过kong.conf.default配置文件启用,或在Admin GUI中一键激活。

5分钟上手:构建无代码AI翻译服务

准备工作

- 已安装Kong网关(参考安装指南)

- 拥有OpenAI和百度文心一言API密钥

配置步骤

1. 创建AI服务

通过Admin API创建两个AI服务端点:

# 创建OpenAI服务

curl -X POST http://localhost:8001/services \

-d "name=openai-service" \

-d "url=https://api.openai.com/v1/chat/completions"

# 创建百度文心一言服务

curl -X POST http://localhost:8001/services \

-d "name=ernie-service" \

-d "url=https://aip.baidubce.com/rpc/2.0/ai_custom/v1/wenxinworkshop/chat/completions"

2. 配置AI代理插件

为服务添加ai-proxy插件,实现多模型统一接口:

# 为OpenAI服务配置插件

curl -X POST http://localhost:8001/services/openai-service/plugins \

-d "name=ai-proxy" \

-d "config.model.provider=openai" \

-d "config.model.name=gpt-3.5-turbo" \

-d "config.auth.header=Authorization" \

-d "config.auth.value=Bearer sk-xxx"

3. 设置提示词模板

使用ai-prompt-template标准化翻译请求:

curl -X POST http://localhost:8001/routes/translation/plugins \

-d "name=ai-prompt-template" \

-d 'config.prompt="将以下文本翻译成英文:{{request.body.text}}"'

4. 启用请求转换

通过ai-request-transformer实现请求格式适配:

curl -X POST http://localhost:8001/routes/translation/plugins \

-d "name=ai-request-transformer" \

-d 'config.input_format="json"' \

-d 'config.output_format="llm/v1/chat"'

5. 测试AI翻译服务

curl -X POST http://localhost:8000/translation \

-H "Content-Type: application/json" \

-d '{"text":"Kong AI网关正在改变企业集成大模型的方式"}'

企业级最佳实践

多模型负载均衡

通过ai-proxy插件配置模型权重:

-- 在handler.lua中设置权重策略

local ai_driver = require("kong.llm.drivers." .. conf.model.provider)

local models = {

{name = "gpt-4", weight = 30},

{name = "claude-3", weight = 70}

}

提示词安全防护

ai-prompt-guard支持正则表达式检测:

config:

forbidden_patterns:

- "忽略以上指令"

- "system: "

error_message: "检测到不安全的提示词内容"

流量控制与监控

结合Kong原生限流插件与AI指标监控:

# 配置AI请求限流

curl -X POST http://localhost:8001/plugins \

-d "name=rate-limiting" \

-d "config.minute=60" \

-d "config.policy=local"

未来展望

Kong AI网关路线图显示,下一版本将重点增强:

- RAG文档集成能力(llm/drivers)

- 模型微调任务调度

- 向量数据库缓存优化

通过CONTRIBUTING.md参与社区共建,或关注CHANGELOG.md获取最新功能更新。

提示:生产环境部署请参考性能调优指南中的

cluster_max_payload等参数配置。

资源汇总

- 官方文档:DEVELOPER.md

- 插件开发:Plugin Hub

- 社区支持:Slack Channel

- 源码地址:https://gitcode.com/gh_mirrors/kon/kong

立即体验Kong AI网关,让企业AI应用建设迈入"插件即服务"的新时代!

登录后查看全文

热门项目推荐

atomcodeClaude Code 的开源替代方案。连接任意大模型,编辑代码,运行命令,自动验证 — 全自动执行。用 Rust 构建,极致性能。 | An open-source alternative to Claude Code. Connect any LLM, edit code, run commands, and verify changes — autonomously. Built in Rust for speed. Get StartedRust0152

atomcodeClaude Code 的开源替代方案。连接任意大模型,编辑代码,运行命令,自动验证 — 全自动执行。用 Rust 构建,极致性能。 | An open-source alternative to Claude Code. Connect any LLM, edit code, run commands, and verify changes — autonomously. Built in Rust for speed. Get StartedRust0152- DDeepSeek-V4-ProDeepSeek-V4-Pro(总参数 1.6 万亿,激活 49B)面向复杂推理和高级编程任务,在代码竞赛、数学推理、Agent 工作流等场景表现优异,性能接近国际前沿闭源模型。Python00

LongCat-Video-Avatar-1.5最新开源LongCat-Video-Avatar 1.5 版本,这是一款经过升级的开源框架,专注于音频驱动人物视频生成的极致实证优化与生产级就绪能力。该版本在 LongCat-Video 基础模型之上构建,可生成高度稳定的商用级虚拟人视频,支持音频-文本转视频(AT2V)、音频-文本-图像转视频(ATI2V)以及视频续播等原生任务,并能无缝兼容单流与多流音频输入。00

LongCat-Video-Avatar-1.5最新开源LongCat-Video-Avatar 1.5 版本,这是一款经过升级的开源框架,专注于音频驱动人物视频生成的极致实证优化与生产级就绪能力。该版本在 LongCat-Video 基础模型之上构建,可生成高度稳定的商用级虚拟人视频,支持音频-文本转视频(AT2V)、音频-文本-图像转视频(ATI2V)以及视频续播等原生任务,并能无缝兼容单流与多流音频输入。00 auto-devAutoDev 是一个 AI 驱动的辅助编程插件。AutoDev 支持一键生成测试、代码、提交信息等,还能够与您的需求管理系统(例如Jira、Trello、Github Issue 等)直接对接。 在IDE 中,您只需简单点击,AutoDev 会根据您的需求自动为您生成代码。Kotlin03

auto-devAutoDev 是一个 AI 驱动的辅助编程插件。AutoDev 支持一键生成测试、代码、提交信息等,还能够与您的需求管理系统(例如Jira、Trello、Github Issue 等)直接对接。 在IDE 中,您只需简单点击,AutoDev 会根据您的需求自动为您生成代码。Kotlin03 Intern-S2-PreviewIntern-S2-Preview,这是一款高效的350亿参数科学多模态基础模型。除了常规的参数与数据规模扩展外,Intern-S2-Preview探索了任务扩展:通过提升科学任务的难度、多样性与覆盖范围,进一步释放模型能力。Python00

Intern-S2-PreviewIntern-S2-Preview,这是一款高效的350亿参数科学多模态基础模型。除了常规的参数与数据规模扩展外,Intern-S2-Preview探索了任务扩展:通过提升科学任务的难度、多样性与覆盖范围,进一步释放模型能力。Python00 skillhubopenJiuwen 生态的 Skill 托管与分发开源方案,支持自建与可选 ClawHub 兼容。Python0112

skillhubopenJiuwen 生态的 Skill 托管与分发开源方案,支持自建与可选 ClawHub 兼容。Python0112

热门内容推荐

项目优选

收起

暂无描述

Dockerfile

733

4.75 K

Ascend Extension for PyTorch

Python

618

795

openEuler内核是openEuler操作系统的核心,既是系统性能与稳定性的基石,也是连接处理器、设备与服务的桥梁。

C

433

395

本项目是CANN提供的数学类基础计算算子库,实现网络在NPU上加速计算。

C++

1.01 K

1.01 K

Claude Code 的开源替代方案。连接任意大模型,编辑代码,运行命令,自动验证 — 全自动执行。用 Rust 构建,极致性能。 | An open-source alternative to Claude Code. Connect any LLM, edit code, run commands, and verify changes — autonomously. Built in Rust for speed.

Get Started

Rust

1.18 K

152

deepin linux kernel

C

29

16

华为昇腾面向大规模分布式训练的多模态大模型套件,支撑多模态生成、多模态理解。

Python

145

237

暂无简介

Dart

983

252

昇腾LLM分布式训练框架

Python

166

198

🎉 (RuoYi)官方仓库 基于SpringBoot,Spring Security,JWT,Vue3 & Vite、Element Plus 的前后端分离权限管理系统

Vue

1.68 K

989