探索常识生成新境界:推荐CommonGen——一个驱动人工智能理解日常场景的开源项目

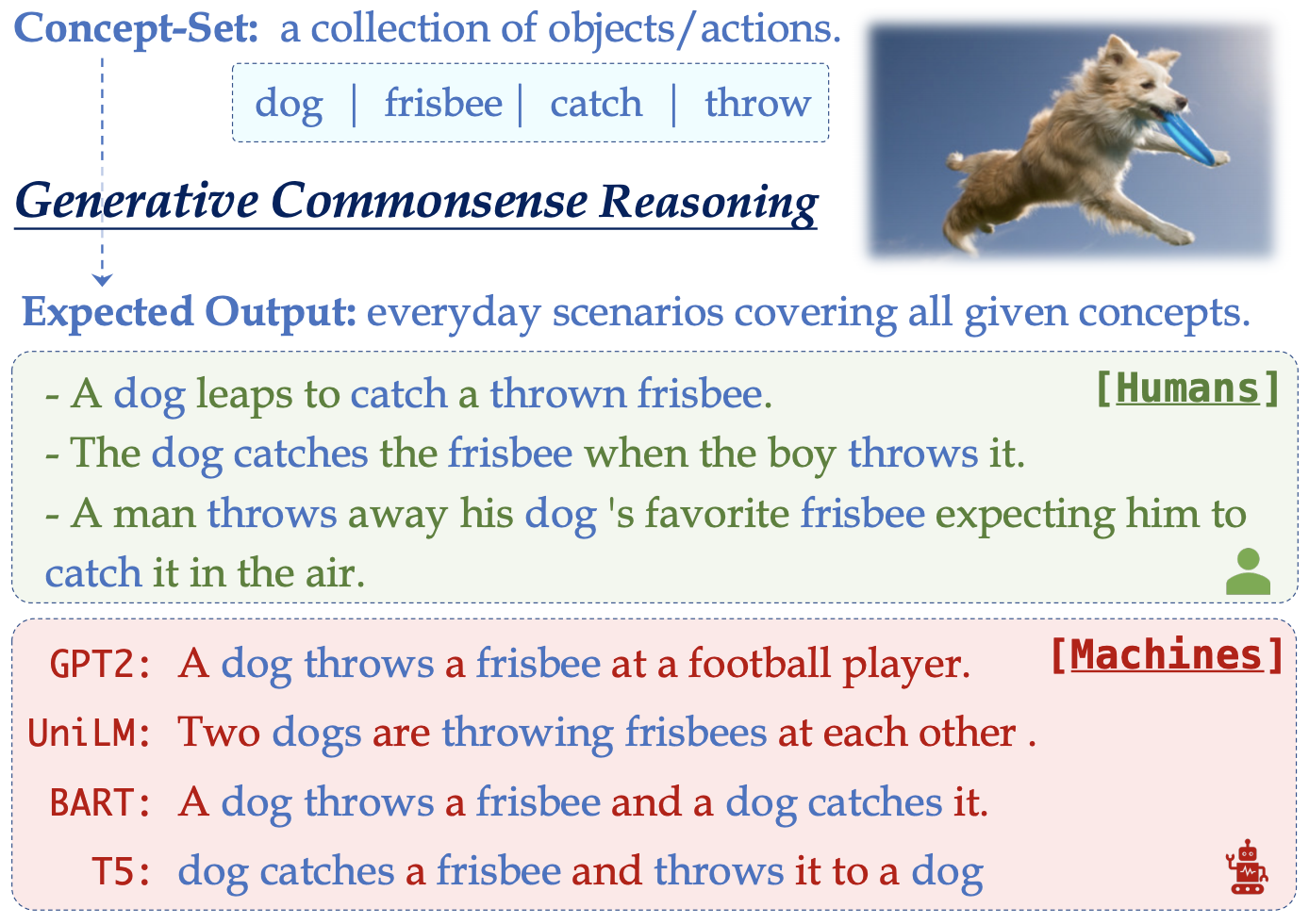

在当今人工智能领域,如何使机器具备更接近人类的推理和表达能力是研究的热点之一。今天,我们特别向您推荐一款名为CommonGen的创新开源项目,它旨在通过受限文本生成挑战,推进生成性常识推理的边界。CommonGen不仅是一个数据集,更是理解与生成日常场景描述的钥匙,为AI赋予更加丰富、真实的语境感知能力。

项目介绍

CommonGen是由Bill Yuchen Lin等多位学者共同研发,并发表于EMNLP的《CommonGen: 一种面向生成性常识推理的受限文本生成挑战》一文。这个项目提供了一个独特的数据集,旨在利用不同类型的常识来生成关于日常情景的句子,从而考验AI的生成性常识推理能力。其官方网站(http://inklab.usc.edu/CommonGen/)提供了详尽的资源和信息,是深入了解该项目的绝佳入口。

项目技术分析

CommonGen的数据集构建基于对多种常识的理解集成,要求模型能够综合概念并创造性地编织成连贯的语句。项目结合了如OpenNMT、Fairseq以及UniLM等框架的基线方法,展示了从基本到进阶的文本生成策略。这不仅仅是一场技术展示,更是对现有自然语言处理技术的一次挑战,推动着模型向理解和生成符合逻辑与常识的语句迈进。

项目及技术应用场景

CommonGen技术的应用前景广泛。在智能对话系统中,它能增强AI理解上下文和生成自然而富有逻辑的回答的能力;在教育技术中,可以帮助创建更为智能化的辅导工具,提升学习者的常识理解和应用水平;而在创意写作、新闻自动化等领域,CommonGen则能促进更有创造力和连贯性的内容生产。通过增强机器对于日常场景的生成与理解,该项目正逐步缩短人工智能与人类认知之间的距离。

项目特点

- 创新性: 作为首个专门针对生成性常识推理设计的约束型文本生成数据集,它填补了该领域的空白。

- 实用性: 提供的基线模型和评估脚本,便于研究人员快速上手,验证新算法的效果。

- 跨学科性: 结合了自然语言处理、知识图谱、深度学习等多个领域的知识,适合多领域专家合作开发。

- 开放性: 所有的资源和数据集都对外公开,鼓励全球开发者参与改进和创新。

结语:CommonGen项目以其独特视角和技术深度,为我们打开了探索人工智能深入理解世界的新窗口。无论是科研人员、工程师还是对自然语言处理感兴趣的爱好者,都不应错过这一宝贵的学术与实践资源。立即加入,一起推动AI向着理解世界的更高层级迈进!

atomcodeClaude Code 的开源替代方案。连接任意大模型,编辑代码,运行命令,自动验证 — 全自动执行。用 Rust 构建,极致性能。 | An open-source alternative to Claude Code. Connect any LLM, edit code, run commands, and verify changes — autonomously. Built in Rust for speed. Get StartedRust0150

atomcodeClaude Code 的开源替代方案。连接任意大模型,编辑代码,运行命令,自动验证 — 全自动执行。用 Rust 构建,极致性能。 | An open-source alternative to Claude Code. Connect any LLM, edit code, run commands, and verify changes — autonomously. Built in Rust for speed. Get StartedRust0150- DDeepSeek-V4-ProDeepSeek-V4-Pro(总参数 1.6 万亿,激活 49B)面向复杂推理和高级编程任务,在代码竞赛、数学推理、Agent 工作流等场景表现优异,性能接近国际前沿闭源模型。Python00

LongCat-Video-Avatar-1.5最新开源LongCat-Video-Avatar 1.5 版本,这是一款经过升级的开源框架,专注于音频驱动人物视频生成的极致实证优化与生产级就绪能力。该版本在 LongCat-Video 基础模型之上构建,可生成高度稳定的商用级虚拟人视频,支持音频-文本转视频(AT2V)、音频-文本-图像转视频(ATI2V)以及视频续播等原生任务,并能无缝兼容单流与多流音频输入。00

LongCat-Video-Avatar-1.5最新开源LongCat-Video-Avatar 1.5 版本,这是一款经过升级的开源框架,专注于音频驱动人物视频生成的极致实证优化与生产级就绪能力。该版本在 LongCat-Video 基础模型之上构建,可生成高度稳定的商用级虚拟人视频,支持音频-文本转视频(AT2V)、音频-文本-图像转视频(ATI2V)以及视频续播等原生任务,并能无缝兼容单流与多流音频输入。00 auto-devAutoDev 是一个 AI 驱动的辅助编程插件。AutoDev 支持一键生成测试、代码、提交信息等,还能够与您的需求管理系统(例如Jira、Trello、Github Issue 等)直接对接。 在IDE 中,您只需简单点击,AutoDev 会根据您的需求自动为您生成代码。Kotlin03

auto-devAutoDev 是一个 AI 驱动的辅助编程插件。AutoDev 支持一键生成测试、代码、提交信息等,还能够与您的需求管理系统(例如Jira、Trello、Github Issue 等)直接对接。 在IDE 中,您只需简单点击,AutoDev 会根据您的需求自动为您生成代码。Kotlin03 Intern-S2-PreviewIntern-S2-Preview,这是一款高效的350亿参数科学多模态基础模型。除了常规的参数与数据规模扩展外,Intern-S2-Preview探索了任务扩展:通过提升科学任务的难度、多样性与覆盖范围,进一步释放模型能力。Python00

Intern-S2-PreviewIntern-S2-Preview,这是一款高效的350亿参数科学多模态基础模型。除了常规的参数与数据规模扩展外,Intern-S2-Preview探索了任务扩展:通过提升科学任务的难度、多样性与覆盖范围,进一步释放模型能力。Python00 skillhubopenJiuwen 生态的 Skill 托管与分发开源方案,支持自建与可选 ClawHub 兼容。Python0111

skillhubopenJiuwen 生态的 Skill 托管与分发开源方案,支持自建与可选 ClawHub 兼容。Python0111