Qwen Image Edit 2509:ComfyUI多图融合编辑工作流深度解析

在数字创作领域,多图像融合与精准编辑一直是设计师和创作者面临的重要挑战。Qwen Image Edit 2509作为一款基于ComfyUI的专业工作流工具,为解决这一难题提供了创新方案。该工具支持将2至3张参考图像通过提示词驱动的方式,无缝合成为单一输出作品,同时保留高度的编辑精确性与创作控制权。无论是物件替换、艺术风格调整,还是多视觉效果的场景融合,Qwen Image Edit 2509都能通过直观的操作流程,让创作者在节省时间成本的同时,获得最大化的创作自由度。

核心功能与技术架构

Qwen Image Edit 2509的核心优势在于其独特的多模态融合架构。该工作流将Qwen图像模型与编辑感知型文本编码器深度整合,使创作者能够通过自然语言描述结合视觉参考,精确引导编辑结果。工具开箱即支持风格迁移、物件插入和场景混合等复杂操作,即使输入图像的外观或质量存在差异,仍能生成风格统一的输出内容。这种技术特性使其特别适用于概念设计、视觉增强和基于参考的修改等专业创作场景。

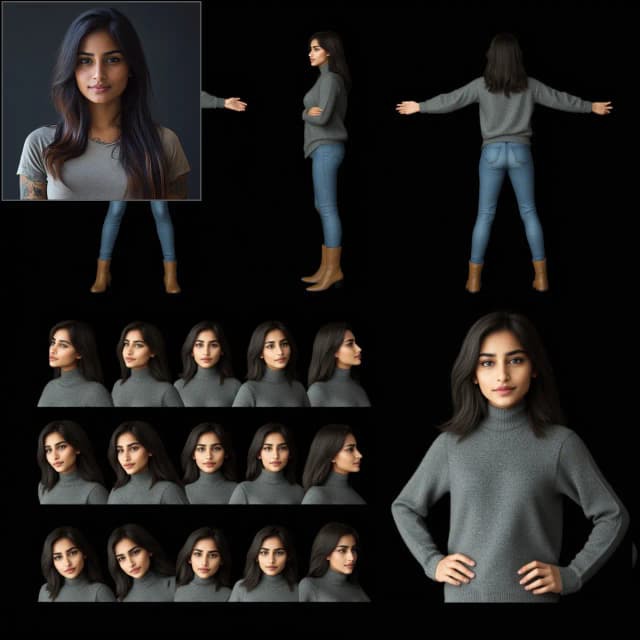

如上图所示,该图片展示了同一女性角色在不同发型、姿态下的多角度视觉效果。这一案例直观呈现了Qwen Image Edit 2509在角色设计中的应用价值,为概念艺术家提供了高效探索角色变体的解决方案。

如上图所示,该图片展示了同一女性角色在不同发型、姿态下的多角度视觉效果。这一案例直观呈现了Qwen Image Edit 2509在角色设计中的应用价值,为概念艺术家提供了高效探索角色变体的解决方案。

关键模型组件解析

Qwen Image Edit 2509工作流的强大功能源于其精心设计的模型组合:

Qwen Image Edit 2509扩散模型(GGUF格式,Q8_0量化)作为核心编辑检查点,采用量化加载方式显著降低显存占用,同时保持精准的编辑能力。该扩散模型骨干能够在采样过程中同时解析文本指令和参考图像信息,实现多源引导的创作过程。

Qwen Image VAE是专为Qwen图像模型设计的变分自编码器,负责将基础画布编码至潜在空间,并将最终生成结果解码回像素图像。这一组件确保了图像转换过程中的质量保留与效率平衡。

Qwen 2.5 VL 7B文本编码器(FP8缩放)则承担着将文本提示与参考图像转化为编辑条件的关键任务。该视觉语言模型能够深度理解创作意图,为后续生成过程提供精准指导。

五步式操作流程指南

1. 资源加载与预处理阶段

首先通过LoadImage节点(#103和#109)分别加载基础画布图像与参考图像,其中图像2将作为主要编辑画布。所有输入图像均需通过ImageScaleToTotalPixels节点(#93和#108)调整至一致的总像素数,这一步骤通过高质量重采样技术,确保不同来源图像的尺度兼容性,为后续融合奠定基础。如需引入第三张参考图,可直接在编码节点的image3输入端口添加额外的LoadImage节点。

2. 创作意图编码阶段

正向编码器TextEncodeQwenImageEditPlus(#104)将文本提示与参考图像结合,生成正向编辑条件。创作者可使用自然语言描述期望的融合效果、风格特征或元素替换需求。负向编码器TextEncodeQwenImageEditPlus(#106)则用于排除不需要的视觉元素,如特定 artifacts 或不匹配的风格特征。两个编码器均基于Qwen文本编码系统构建,确保意图表达的准确性。

3. 模型配置与优化阶段

UnetLoaderGGUF节点(#102)以GGUF格式加载Qwen Image Edit 2509骨干模型,实现高效推理。LoraLoaderModelOnly节点(#89)负责应用Qwen-Image-Lightning LoRA模型,通过调整其强度参数,创作者可精确控制编辑效果的激进程度,实现从细微调整到显著变化的全范围控制。

4. 引导生成与优化阶段

基础画布图像(图像2)通过VAEEncode节点(#88)编码为潜在表示,作为KSampler节点(#3)的起始潜变量。这一设计使工作流实现图像到图像的编辑模式,而非从零开始的文本到图像生成。采样过程中,正向与负向条件共同作用于潜在画布,通过调整采样步数和种子值,创作者可在保持基础结构的同时,实现目标风格与元素的融合。

5. 结果解码与保存阶段

最终生成的潜在表示通过VAEDecode节点(#8)解码为图像格式,并由SaveImage节点(#60)保存至输出文件夹。系统自动生成包含运行参数的文件名,便于创作者追踪不同实验结果,进行比较与迭代优化。

核心节点功能详解

TextEncodeQwenImageEditPlus节点(#104和#106)构成了工作流的意图理解核心。正向编码节点支持最多三幅参考图像与文本提示的混合输入,通过明确描述主题、动作、场景和风格特征,创作者可获得最佳响应效果。负向编码节点则应保持简洁,主要用于抑制不想要的视觉元素,避免与正向意图产生冲突。

UnetLoaderGGUF节点(#102)采用GGUF格式加载模型,这一设计显著降低了显存占用,使普通硬件也能运行复杂编辑任务。量化级别可根据硬件条件调整,较高量化节省显存但可能损失细微细节,创作者需根据项目需求平衡质量与性能。

KSampler节点(#3)作为生成过程的执行核心,通过调整采样步数和采样器类型,可在速度与质量间取得平衡。固定种子值可确保结果的可重复性,而变化种子则能探索更多创意可能性。

此图片展示了三位女性在不同场景中的融合效果,清晰呈现了Qwen Image Edit 2509的多源图像混合能力。通过该案例,创作者可以直观理解如何将不同环境、姿态和风格的元素有机整合,为复杂场景设计提供参考范例。

此图片展示了三位女性在不同场景中的融合效果,清晰呈现了Qwen Image Edit 2509的多源图像混合能力。通过该案例,创作者可以直观理解如何将不同环境、姿态和风格的元素有机整合,为复杂场景设计提供参考范例。

高级应用技巧与最佳实践

为获得最佳编辑效果,创作者应遵循以下实践原则:保持提示词的具体性与简洁性,重点描述主题、动作、场景和风格四个核心要素;将图像2视为基础画布,图像1作为元素捐赠者,在提示中明确指定需要转移的元素与保留的部分;负向提示应精炼,主要抑制光晕、纹理漂移或过度风格化等常见问题;通过微调LoRA强度和采样步数,可在保守编辑与创新重构之间找到精确平衡点。

对于高质量输出需求,建议在最终渲染时提高目标像素值,并重用相同种子以放大理想组合。这种工作流设计特别适合概念艺术家、游戏开发者和视觉设计师,帮助他们快速将创意构想转化为视觉成果,同时保持对细节的精确控制。

资源获取与社区支持

Qwen Image Edit 2509工作流由RobbaW开发维护,核心模型资源可通过Hugging Face平台获取(QuantStack/Qwen-Image-Edit-2509-GGUF)。完整工作流定义与详细文档可参考Reddit r/comfyui社区的官方发布说明。创作者在使用过程中,应遵守各组件的原始许可条款与使用规范。

ComfyUI生态系统还提供了多种互补工作流,如一致角色创建器、Flux PuLID面部交换工具和Wan2.2视频生成器等,为数字创作者构建了完整的AI辅助创作工具箱。通过这些资源的组合应用,创作者能够实现从静态图像到动态视频的全流程内容生产,显著提升创作效率与视觉质量。

随着AI辅助创作技术的不断演进,Qwen Image Edit 2509代表了多模态编辑工具的发展方向——在保持创作自由度的同时,通过精确控制与直观操作,让复杂的视觉构想得以高效实现。对于追求专业级图像编辑效果的创作者而言,这一工作流不仅是生产力工具,更是创意表达的强大延伸。

atomcodeClaude Code 的开源替代方案。连接任意大模型,编辑代码,运行命令,自动验证 — 全自动执行。用 Rust 构建,极致性能。 | An open-source alternative to Claude Code. Connect any LLM, edit code, run commands, and verify changes — autonomously. Built in Rust for speed. Get StartedRust0152

atomcodeClaude Code 的开源替代方案。连接任意大模型,编辑代码,运行命令,自动验证 — 全自动执行。用 Rust 构建,极致性能。 | An open-source alternative to Claude Code. Connect any LLM, edit code, run commands, and verify changes — autonomously. Built in Rust for speed. Get StartedRust0152- DDeepSeek-V4-ProDeepSeek-V4-Pro(总参数 1.6 万亿,激活 49B)面向复杂推理和高级编程任务,在代码竞赛、数学推理、Agent 工作流等场景表现优异,性能接近国际前沿闭源模型。Python00

LongCat-Video-Avatar-1.5最新开源LongCat-Video-Avatar 1.5 版本,这是一款经过升级的开源框架,专注于音频驱动人物视频生成的极致实证优化与生产级就绪能力。该版本在 LongCat-Video 基础模型之上构建,可生成高度稳定的商用级虚拟人视频,支持音频-文本转视频(AT2V)、音频-文本-图像转视频(ATI2V)以及视频续播等原生任务,并能无缝兼容单流与多流音频输入。00

LongCat-Video-Avatar-1.5最新开源LongCat-Video-Avatar 1.5 版本,这是一款经过升级的开源框架,专注于音频驱动人物视频生成的极致实证优化与生产级就绪能力。该版本在 LongCat-Video 基础模型之上构建,可生成高度稳定的商用级虚拟人视频,支持音频-文本转视频(AT2V)、音频-文本-图像转视频(ATI2V)以及视频续播等原生任务,并能无缝兼容单流与多流音频输入。00 auto-devAutoDev 是一个 AI 驱动的辅助编程插件。AutoDev 支持一键生成测试、代码、提交信息等,还能够与您的需求管理系统(例如Jira、Trello、Github Issue 等)直接对接。 在IDE 中,您只需简单点击,AutoDev 会根据您的需求自动为您生成代码。Kotlin03

auto-devAutoDev 是一个 AI 驱动的辅助编程插件。AutoDev 支持一键生成测试、代码、提交信息等,还能够与您的需求管理系统(例如Jira、Trello、Github Issue 等)直接对接。 在IDE 中,您只需简单点击,AutoDev 会根据您的需求自动为您生成代码。Kotlin03 Intern-S2-PreviewIntern-S2-Preview,这是一款高效的350亿参数科学多模态基础模型。除了常规的参数与数据规模扩展外,Intern-S2-Preview探索了任务扩展:通过提升科学任务的难度、多样性与覆盖范围,进一步释放模型能力。Python00

Intern-S2-PreviewIntern-S2-Preview,这是一款高效的350亿参数科学多模态基础模型。除了常规的参数与数据规模扩展外,Intern-S2-Preview探索了任务扩展:通过提升科学任务的难度、多样性与覆盖范围,进一步释放模型能力。Python00 skillhubopenJiuwen 生态的 Skill 托管与分发开源方案,支持自建与可选 ClawHub 兼容。Python0112

skillhubopenJiuwen 生态的 Skill 托管与分发开源方案,支持自建与可选 ClawHub 兼容。Python0112