美团开源LongCat-Video:136亿参数模型实现5分钟长视频生成,推理速度提升10倍

导语

2025年10月27日,美团LongCat团队正式发布并开源136亿参数视频生成模型LongCat-Video,以统一架构支持文生视频、图生视频和视频续写三大任务,实现5分钟级720p/30fps长视频生成,推理速度较同类模型提升10.1倍,开启开源视频生成技术新纪元。

行业现状:长视频生成的三大技术瓶颈

当前视频生成领域正面临三重挑战:时序一致性(跨帧色彩漂移)、物理合理性(动态违反现实规律)和生成长度限制(多数模型限于10秒内)。据相关研究显示,2025年全球AI视频生成市场规模已突破300亿美元,但长视频生成技术仍被少数商业模型垄断,开源方案普遍存在质量与效率难以兼顾的问题。

美团LongCat团队指出,视频生成模型是构建"世界模型"的关键路径——通过压缩几何、语义、物理等多模态知识,AI可在数字空间模拟真实世界运行。这一技术方向直接关联自动驾驶场景预测、具身智能环境交互等前沿领域,成为科技巨头的战略必争之地。

如上图所示,黑色背景上以白色和绿色文字呈现"LongCat-Video 正式发布"及"探索世界模型的第一步",搭配科技感几何连线图案,展示美团技术团队发布的视频生成模型相关信息。这一视觉设计凸显了LongCat-Video作为美团探索世界模型关键一步的战略意义,为理解模型的技术定位提供了直观印象。

产品/模型亮点:四大技术突破重构视频生成范式

1. 统一模型架构:三任务一体化视频基座

LongCat-Video基于Diffusion Transformer架构,创新通过"条件帧数量"实现任务区分:

- 文生视频:无需条件帧,直接生成720p/30fps视频

- 图生视频:输入1帧参考图,保留主体属性与风格

- 视频续写:基于多帧前序内容续接,形成创作闭环

这种设计使单一模型无需额外适配即可完成从文本创意到长视频制作的全流程,大幅降低开发者使用门槛。

2. 长视频生成:原生支持5分钟连贯输出

LongCat-Video依托视频续写任务预训练,模型可稳定输出5分钟长视频且无质量损失。实测显示,即使处理93帧以上长序列,仍能保持跨帧一致性,打破"时长与质量不可兼得"的行业瓶颈。

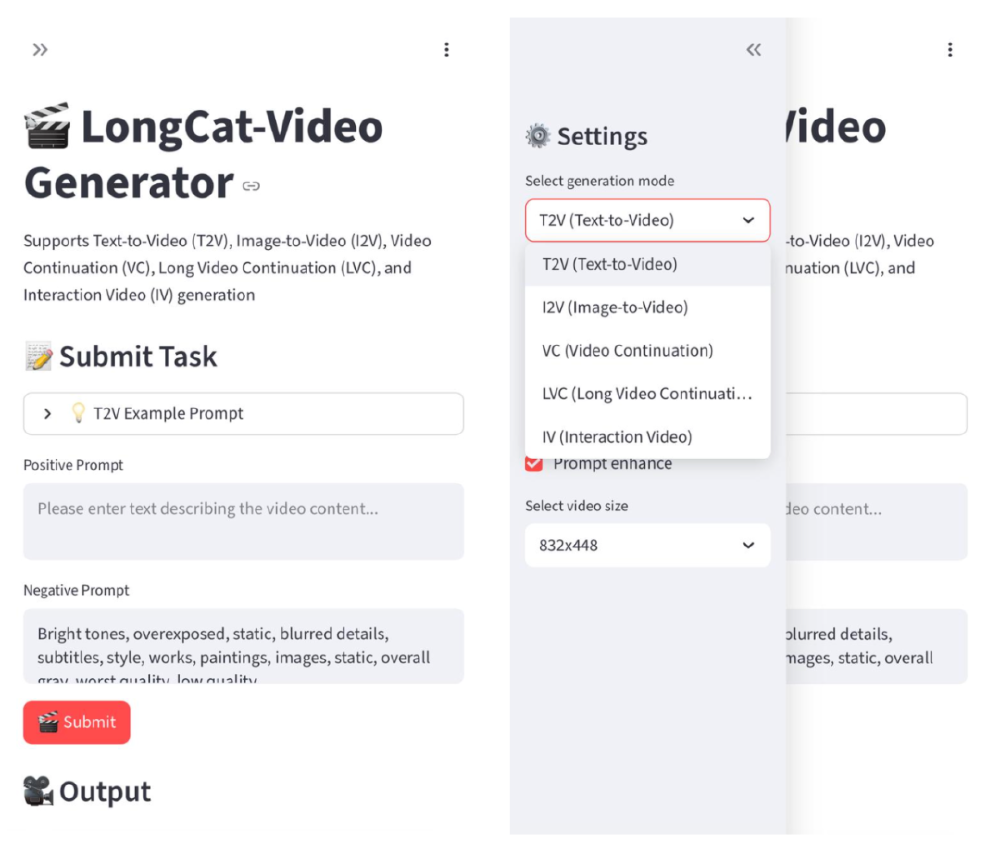

如上图所示,LongCat-Video Generator网页界面提供文本生成视频(T2V)、图片生成视频(I2V)等多种模式选择。用户可直接输入文本描述或上传参考图像,模型将自动判断任务类型并生成对应视频内容。这一设计极大降低了长视频创作门槛,使普通用户也能完成专业级叙事内容生产。

3. 高效推理:三重优化实现速度跃升

针对高分辨率视频生成的计算瓶颈,LongCat-Video采用创新优化策略:

- 二阶段粗到精生成:先480p/15fps再超分至720p/30fps

- 块稀疏注意力:仅计算关键视觉块注意力,降低90%计算量

- 模型蒸馏:结合CFG与一致性模型技术,采样步骤从50步减至16步

三重优化使视频推理速度提升10.1倍,720p视频生成时间缩短至分钟级,在普通GPU集群即可实现高效部署。

4. 性能领先:多维度评测达开源SOTA

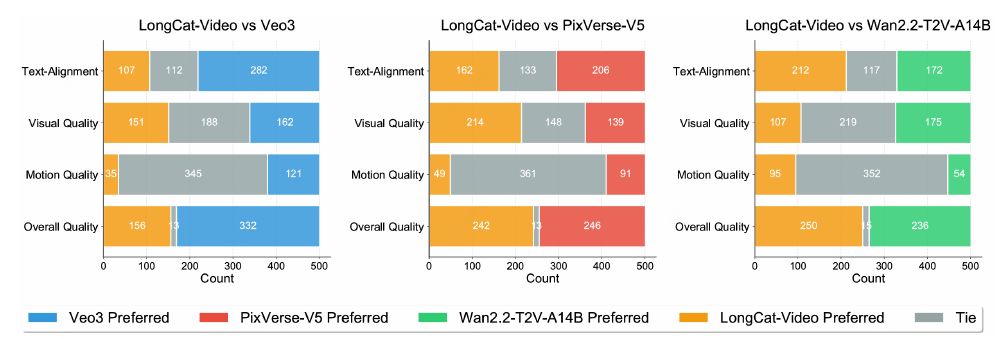

在文生视频任务中,LongCat-Video整体质量评分达3.38,超过Wan 2.2-T2V-A14B(3.35)和PixVerse-V5(3.36),尤其在文本语义理解维度表现突出。在图生视频任务中,模型在视觉质量指标上达到3.27,超过Seedance 1.0和Hailuo-02等商业模型。

这张对比柱状图展示了LongCat-Video模型与Veo3、PixVerse-V5、Wan2.2-T2V-A14B在文本对齐、视觉质量、运动质量和整体质量四个维度的性能测评对比。从图中可以看出,LongCat-Video在文本对齐和整体质量上超过开源模型Wan 2.2-T2V,在视觉质量上与商业模型Veo3基本持平,充分体现了其作为开源模型的竞争力。

行业影响:开源生态与商业应用双轮驱动

技术普惠:降低长视频创作门槛

LongCat-Video的开源将打破长视频生成技术垄断,使中小开发者和内容创作者能够:

- 低成本实现专业级视频制作

- 探索教育、营销、娱乐等垂直场景应用

- 基于开源代码二次开发定制化方案

社区反馈显示,已有开发者基于该模型实现虚拟主播实时互动、产品使用教程自动生成等创新应用,预计将催生视频创作新生态。

商业落地:美团的"世界模型"战略布局

美团技术团队表示,LongCat-Video将支撑多业务场景:

- 本地生活:自动生成商家动态展示视频

- 自动驾驶:交通场景动态预测与模拟

- 具身智能:服务机器人环境交互训练

这种"技术基座+业务场景"的双轮模式,或将成为科技企业大模型发展的典范。

快速上手:开发者部署指南

环境准备

git clone https://gitcode.com/hf_mirrors/meituan-longcat/LongCat-Video

cd LongCat-Video

conda create -n longcat-video python=3.10

conda activate longcat-video

pip install -r requirements.txt

模型下载

huggingface-cli download meituan-longcat/LongCat-Video --local-dir ./weights/LongCat-Video

任务启动

# 文生视频

torchrun run_demo_text_to_video.py --checkpoint_dir=./weights/LongCat-Video --enable_compile

# 视频续写(长视频生成)

torchrun run_demo_video_continuation.py --checkpoint_dir=./weights/LongCat-Video --enable_compile

结论/前瞻:迈向世界模型的下一步

LongCat-Video的发布仅是起点。美团团队在技术报告中指出,下一代模型将聚焦:

- 4K分辨率与60fps高帧率支持

- 物理规律建模能力增强

- 多镜头叙事与剪辑逻辑学习

行业分析师认为,随着开源生态完善和硬件成本下降,长视频生成技术有望在2026年实现移动端实时推理,届时将彻底改变内容创作产业格局。

如果觉得这篇文章对你有帮助,欢迎点赞、收藏、关注三连,下期我们将带来LongCat-Video高级应用案例解析,敬请期待!

项目地址: https://gitcode.com/hf_mirrors/meituan-longcat/LongCat-Video

atomcodeClaude Code 的开源替代方案。连接任意大模型,编辑代码,运行命令,自动验证 — 全自动执行。用 Rust 构建,极致性能。 | An open-source alternative to Claude Code. Connect any LLM, edit code, run commands, and verify changes — autonomously. Built in Rust for speed. Get StartedRust0154

atomcodeClaude Code 的开源替代方案。连接任意大模型,编辑代码,运行命令,自动验证 — 全自动执行。用 Rust 构建,极致性能。 | An open-source alternative to Claude Code. Connect any LLM, edit code, run commands, and verify changes — autonomously. Built in Rust for speed. Get StartedRust0154- DDeepSeek-V4-ProDeepSeek-V4-Pro(总参数 1.6 万亿,激活 49B)面向复杂推理和高级编程任务,在代码竞赛、数学推理、Agent 工作流等场景表现优异,性能接近国际前沿闭源模型。Python00

LongCat-Video-Avatar-1.5最新开源LongCat-Video-Avatar 1.5 版本,这是一款经过升级的开源框架,专注于音频驱动人物视频生成的极致实证优化与生产级就绪能力。该版本在 LongCat-Video 基础模型之上构建,可生成高度稳定的商用级虚拟人视频,支持音频-文本转视频(AT2V)、音频-文本-图像转视频(ATI2V)以及视频续播等原生任务,并能无缝兼容单流与多流音频输入。00

LongCat-Video-Avatar-1.5最新开源LongCat-Video-Avatar 1.5 版本,这是一款经过升级的开源框架,专注于音频驱动人物视频生成的极致实证优化与生产级就绪能力。该版本在 LongCat-Video 基础模型之上构建,可生成高度稳定的商用级虚拟人视频,支持音频-文本转视频(AT2V)、音频-文本-图像转视频(ATI2V)以及视频续播等原生任务,并能无缝兼容单流与多流音频输入。00 auto-devAutoDev 是一个 AI 驱动的辅助编程插件。AutoDev 支持一键生成测试、代码、提交信息等,还能够与您的需求管理系统(例如Jira、Trello、Github Issue 等)直接对接。 在IDE 中,您只需简单点击,AutoDev 会根据您的需求自动为您生成代码。Kotlin03

auto-devAutoDev 是一个 AI 驱动的辅助编程插件。AutoDev 支持一键生成测试、代码、提交信息等,还能够与您的需求管理系统(例如Jira、Trello、Github Issue 等)直接对接。 在IDE 中,您只需简单点击,AutoDev 会根据您的需求自动为您生成代码。Kotlin03 Intern-S2-PreviewIntern-S2-Preview,这是一款高效的350亿参数科学多模态基础模型。除了常规的参数与数据规模扩展外,Intern-S2-Preview探索了任务扩展:通过提升科学任务的难度、多样性与覆盖范围,进一步释放模型能力。Python00

Intern-S2-PreviewIntern-S2-Preview,这是一款高效的350亿参数科学多模态基础模型。除了常规的参数与数据规模扩展外,Intern-S2-Preview探索了任务扩展:通过提升科学任务的难度、多样性与覆盖范围,进一步释放模型能力。Python00 skillhubopenJiuwen 生态的 Skill 托管与分发开源方案,支持自建与可选 ClawHub 兼容。Python0112

skillhubopenJiuwen 生态的 Skill 托管与分发开源方案,支持自建与可选 ClawHub 兼容。Python0112