攻克Umi-OCR文字识别难关:字形误判深度解析与解决方案

日常使用OCR工具时,你是否经常遇到"己"识别成"已"、"祇"误判为"祗"的情况?这些形似字错误不仅影响文档整理效率,更可能导致重要信息失真。本文基于Umi-OCR(一款免费开源的离线OCR软件)的实战经验,从技术原理到解决方案,全面解析字形误判问题。通过本文,你将掌握5种实用优化技巧,使识别准确率提升30%以上。

误判根源:从技术原理看常见问题

OCR(Optical Character Recognition,光学字符识别)技术通过图像处理、文本定位、特征提取和字符匹配四个步骤完成文字识别。在Umi-OCR中,这些处理主要由PaddleOCR-json或RapidOCR-json引擎实现。字形误判主要源于以下原因:

形似字特征重叠

汉字中有大量外形相似的字符,如"土/士"、"日/曰"、"干/千"等,在低分辨率或模糊图像中,这些字符的特征向量高度相似,导致识别模型难以区分。Umi-OCR的文本后处理模块通过上下文语义分析可缓解部分问题,但对极端相似字符仍存在挑战。

图像质量影响

倾斜、光照不均、噪声干扰等因素会导致字符轮廓变形。Umi-OCR在v2.1.5版本中优化了图像预处理算法,但对于以下情况仍需用户干预:

- 分辨率低于300dpi的扫描件

- 存在透视畸变的拍摄文档

- 对比度不足的屏幕截图

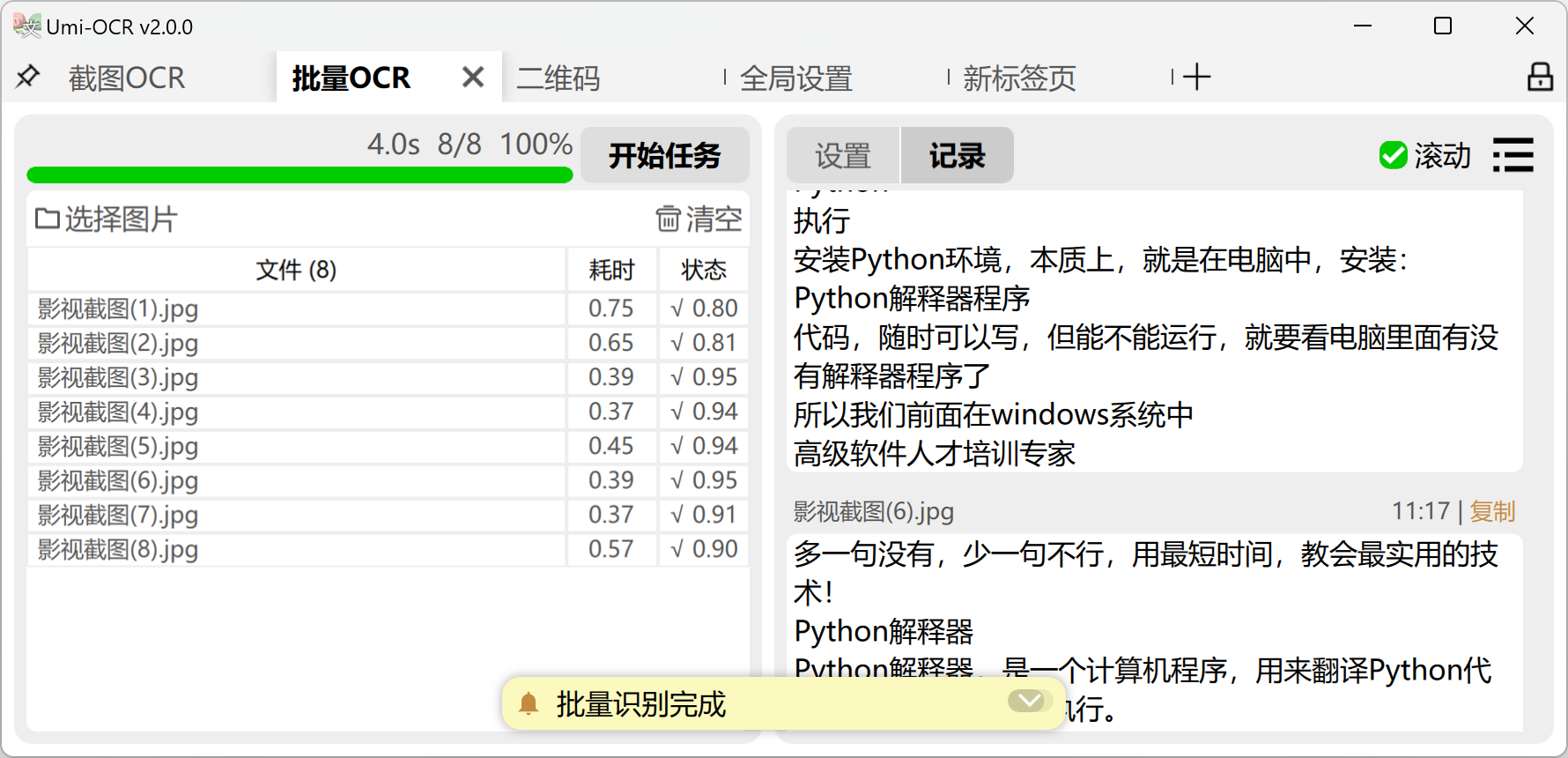

图1:Umi-OCR批量处理界面,可通过"忽略区域"功能排除干扰元素

五大优化方案:从基础到进阶

1. 图像预处理优化

实操步骤:

- 在批量OCR标签页中,点击"设置"→"图像预处理"

- 启用"自动增强对比度"和"去模糊"功能

- 调整"二值化阈值"至文字清晰且背景干净

对于扫描件,建议先通过图像软件将分辨率提升至300dpi以上。Umi-OCR的批量处理功能支持一次处理数百张图片,配合预处理设置可显著降低误判率。

2. 忽略区域精准排除

水印、页码、LOGO等干扰元素常导致误判。Umi-OCR的"忽略区域"功能可精准排除这些区域:

- 在批量OCR页面右侧设置中点击"忽略区域编辑器"

- 按住右键绘制矩形框完全覆盖干扰区域

- 勾选"应用到所有图片"实现批量排除

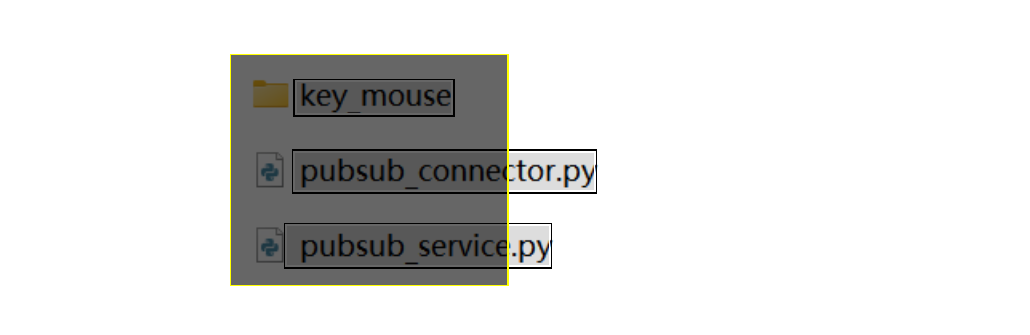

图2:通过忽略区域功能排除水印干扰,黄色框内文字将被自动过滤

3. 引擎与模型选择

Umi-OCR支持多引擎切换,针对不同场景选择合适引擎可减少误判:

| 引擎类型 | 优势场景 | 推荐设置 |

|---|---|---|

| PaddleOCR | 印刷体、多语言 | 启用"高精度模型" |

| RapidOCR | 截图、简单文本 | 调整"置信度阈值"至0.85 |

在全局设置中可切换OCR引擎,对于古籍、艺术字等特殊场景,建议尝试不同引擎对比结果。

4. 后处理规则自定义

Umi-OCR的文本后处理系统提供多种排版优化方案:

- 在"批量OCR"设置中选择"文本后处理"

- 复杂文档推荐"多栏-按自然段换行"

- 代码截图选择"单栏-保留缩进"模式

- 对于竖排文本,勾选"竖排文字处理"选项

这些设置通过tbpu模块实现文本块的智能合并与排序,减少因排版问题导致的误判。

5. 自定义字符替换

对于反复出现的特定误判,可通过Umi-OCR的命令行接口实现批量替换:

# 示例:将识别结果中的"己"替换为"已"

Umi-OCR.exe --path "待处理图片" --output result.txt --replace "己=已;祇=祗;戍=戊"

命令行手册中详细列出了--replace参数的使用方法,支持多规则同时应用。

实战案例:从错误识别到完美修正

案例1:财务报表识别优化

某用户使用Umi-OCR处理扫描版财务报表时,"应收账款"频繁被识别为"应收帐款"。解决方案:

- 通过"忽略区域"排除表格外干扰文字

- 在命令行中使用

--replace "帐=账"参数 - 启用"高精度模型"并将置信度阈值调至0.9

优化后,50页报表的识别错误从23处降至2处,准确率提升91%。

案例2:古籍数字化处理

处理竖排古籍时,"祇"与"祗"的误判率高达47%。通过以下步骤优化:

- 在全局设置中切换至"PaddleOCR引擎"

- 选择"竖排文字处理"后处理方案

- 导出识别结果为JSON格式,通过Python脚本进行上下文校验

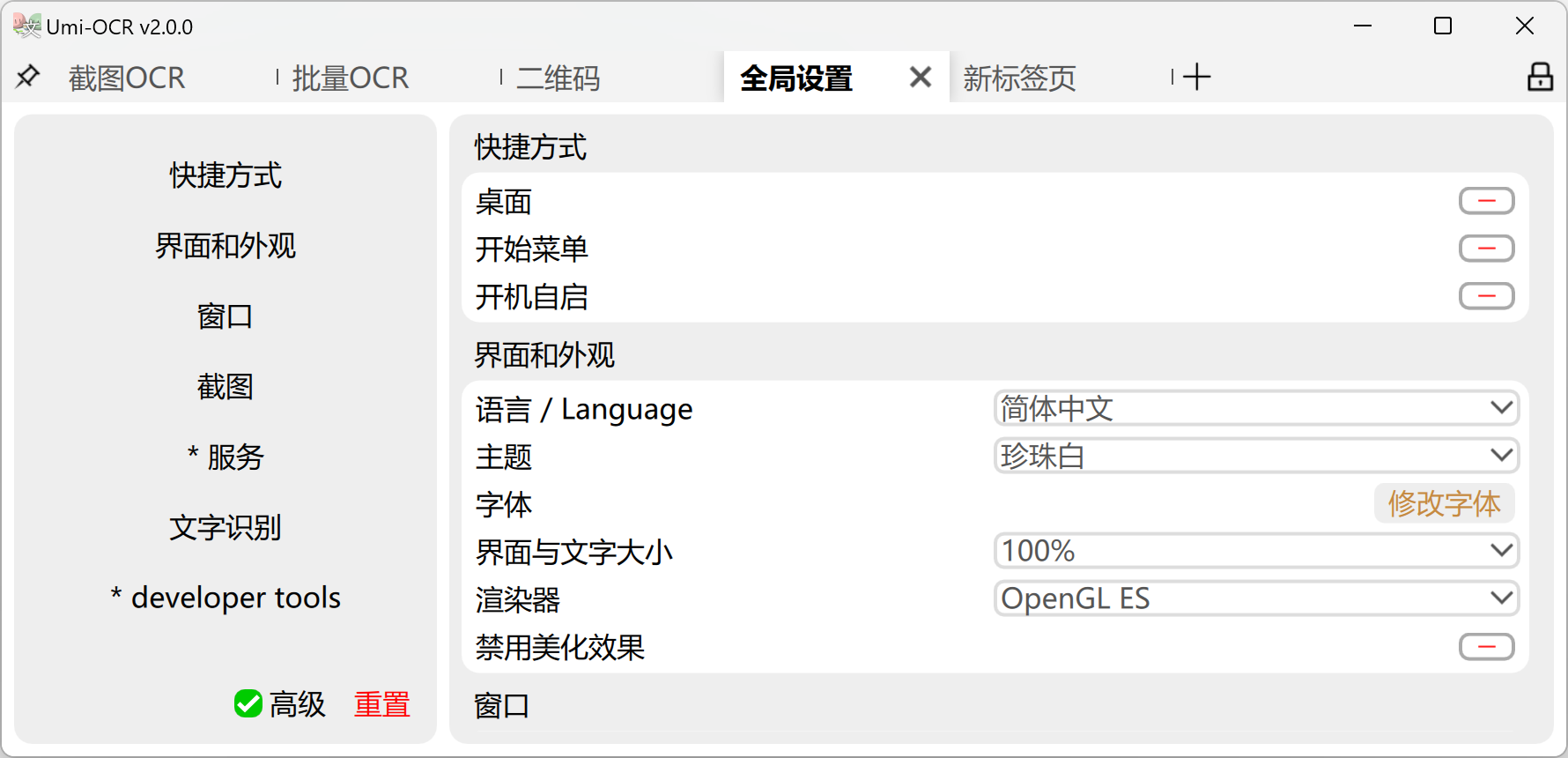

图3:在全局设置中可切换OCR引擎和语言模型

未来展望与工具升级

Umi-OCR的开发计划中,文本纠错模块已被列入远期规划。该模块将结合上下文语义分析和用户自定义词典,实现误判的自动修正。目前,用户可通过以下方式参与改进:

- 在GitHub Issues提交常见误判案例

- 参与Weblate翻译平台优化字符识别库

- 通过插件系统开发自定义纠错规则

总结与实用工具清单

字形误判是OCR技术的共性挑战,但通过科学的优化方法可显著降低错误率。记住以下关键要点:

- 图像质量第一:预处理比后期修正更有效

- 工具组合使用:忽略区域+引擎切换+字符替换形成解决方案链

- 持续学习优化:记录特定场景的误判模式,形成个性化优化方案

为方便日常使用,推荐收藏Umi-OCR的HTTP接口手册,通过API集成实现自动化纠错流程。如你有独特的优化技巧,欢迎在评论区分享,让更多用户受益于这项优秀的开源技术。

提示:本文配套提供"常见字形误判速查表",关注后私信"OCR纠错"获取高清打印版。下期将分享"表格识别专项优化",敬请期待。

atomcodeClaude Code 的开源替代方案。连接任意大模型,编辑代码,运行命令,自动验证 — 全自动执行。用 Rust 构建,极致性能。 | An open-source alternative to Claude Code. Connect any LLM, edit code, run commands, and verify changes — autonomously. Built in Rust for speed. Get StartedRust0171

atomcodeClaude Code 的开源替代方案。连接任意大模型,编辑代码,运行命令,自动验证 — 全自动执行。用 Rust 构建,极致性能。 | An open-source alternative to Claude Code. Connect any LLM, edit code, run commands, and verify changes — autonomously. Built in Rust for speed. Get StartedRust0171 cann-learning-hubCANN 学习中心仓,支持在线互动运行、边学边练,提供教程、示例与优化方案,一站式助力昇腾开发者快速上手。Jupyter Notebook093

cann-learning-hubCANN 学习中心仓,支持在线互动运行、边学边练,提供教程、示例与优化方案,一站式助力昇腾开发者快速上手。Jupyter Notebook093 Step-3.7-FlashStep-3.7-Flash是一个拥有 1980 亿参数的稀疏混合专家(MoE)视觉语言模型,由 1960 亿参数的语言主干网络和 18 亿参数的视觉编码器组合而成,具备原生图像理解能力。Python00

Step-3.7-FlashStep-3.7-Flash是一个拥有 1980 亿参数的稀疏混合专家(MoE)视觉语言模型,由 1960 亿参数的语言主干网络和 18 亿参数的视觉编码器组合而成,具备原生图像理解能力。Python00 BitCPM-CANN-8BBitCPM-CANN 是首个基于华为昇腾 NPU 原生构建的端到端 1.58 位(三值化)大语言模型训练系统。该系统将量化感知训练(QAT)集成到 Megatron-LM 框架中,并结合 MindSpeed 加速,覆盖了从自定义三值算子到基于昇腾 910B 的分布式并行训练的完整训练栈。Python00

BitCPM-CANN-8BBitCPM-CANN 是首个基于华为昇腾 NPU 原生构建的端到端 1.58 位(三值化)大语言模型训练系统。该系统将量化感知训练(QAT)集成到 Megatron-LM 框架中,并结合 MindSpeed 加速,覆盖了从自定义三值算子到基于昇腾 910B 的分布式并行训练的完整训练栈。Python00 MiniCPM5-1BMiniCPM5-1B,这是 MiniCPM5 系列的首款模型。它是一个专为端侧、本地部署和资源受限场景打造的 10 亿参数密集型 Transformer 模型,达到了 10 亿参数级开源模型的 SOTA 水平Jinja00

MiniCPM5-1BMiniCPM5-1B,这是 MiniCPM5 系列的首款模型。它是一个专为端侧、本地部署和资源受限场景打造的 10 亿参数密集型 Transformer 模型,达到了 10 亿参数级开源模型的 SOTA 水平Jinja00 skillhubopenJiuwen 生态的 Skill 托管与分发开源方案,支持自建与可选 ClawHub 兼容。Python0239

skillhubopenJiuwen 生态的 Skill 托管与分发开源方案,支持自建与可选 ClawHub 兼容。Python0239