阿里云Wan 2.2多模态模型震撼发布:MoE架构引领AIGC视频创作新范式

阿里云近日正式推出新一代多模态生成模型——通义万相2.2(Wan 2.2),凭借创新技术架构与强大功能,重新定义AI视频生成的质量标准与应用边界。该模型突破性采用混合专家(Mixture of Experts, MoE)架构,通过动态调配高噪专家模型与低噪专家模型,依据去噪过程的时间步智能分配计算资源,实现视频生成质量与效率的双重跃升。

作为当前AIGC领域的标杆产品,Wan 2.2构建起三大核心技术壁垒。其影视级美学控制系统深度整合电影工业的视觉标准体系,支持从光影层次感、色彩调性到构图法则的全方位精细化调控,使AI生成内容具备专业级视觉表现力;在动态效果处理方面,模型通过强化运动轨迹预测与帧间一致性优化,可精准还原复杂物理运动场景,显著提升视频流畅度与动作可控性;而精准语义遵循技术则解决了多对象交互场景下的逻辑一致性难题,确保生成内容与用户创意意图高度吻合。

针对多样化创作需求,Wan 2.2提供文生视频、图生视频等全链路生成能力,已广泛应用于广告创意、数字艺术、在线教育等领域。值得关注的是,该系列模型基于Apache 2.0开源协议开放商业使用权限,其中文生视频专项模型Wan2.2-T2V-A14B凭借140亿参数量的深度优化,成为当前文本驱动视频生成领域的性能标杆。

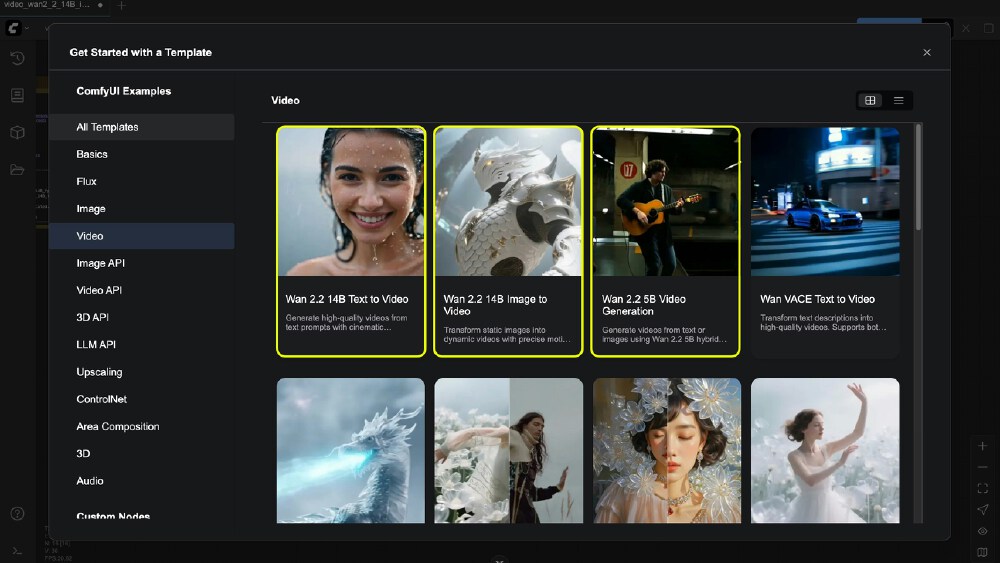

如上图所示,该界面直观呈现了Wan2.2-T2V-A14B模型在ComfyUI中的工作流配置方案。这一可视化操作界面降低了专业模型的使用门槛,帮助创作者快速掌握高质量视频的生成技巧,为实现创意落地提供了直观的技术路径。

如上图所示,该界面直观呈现了Wan2.2-T2V-A14B模型在ComfyUI中的工作流配置方案。这一可视化操作界面降低了专业模型的使用门槛,帮助创作者快速掌握高质量视频的生成技巧,为实现创意落地提供了直观的技术路径。

开发者可通过GitCode仓库获取完整模型资源(仓库地址:https://gitcode.com/hf_mirrors/Wan-AI/Wan2.2-T2V-A14B)。在实际部署时,需在ComfyUI环境中完成高噪/低噪双专家模型的协同加载,并配套相应的文本编码器与VAE模型组件。通过简单配置视频尺寸、帧数参数及创意提示词,即可启动专业化视频生成流程。随着开源生态的持续完善,Wan 2.2有望推动AI视频创作从专业领域向大众化应用加速渗透,为数字内容产业注入全新发展动能。

atomcodeClaude Code 的开源替代方案。连接任意大模型,编辑代码,运行命令,自动验证 — 全自动执行。用 Rust 构建,极致性能。 | An open-source alternative to Claude Code. Connect any LLM, edit code, run commands, and verify changes — autonomously. Built in Rust for speed. Get StartedRust0150

atomcodeClaude Code 的开源替代方案。连接任意大模型,编辑代码,运行命令,自动验证 — 全自动执行。用 Rust 构建,极致性能。 | An open-source alternative to Claude Code. Connect any LLM, edit code, run commands, and verify changes — autonomously. Built in Rust for speed. Get StartedRust0150- DDeepSeek-V4-ProDeepSeek-V4-Pro(总参数 1.6 万亿,激活 49B)面向复杂推理和高级编程任务,在代码竞赛、数学推理、Agent 工作流等场景表现优异,性能接近国际前沿闭源模型。Python00

LongCat-Video-Avatar-1.5最新开源LongCat-Video-Avatar 1.5 版本,这是一款经过升级的开源框架,专注于音频驱动人物视频生成的极致实证优化与生产级就绪能力。该版本在 LongCat-Video 基础模型之上构建,可生成高度稳定的商用级虚拟人视频,支持音频-文本转视频(AT2V)、音频-文本-图像转视频(ATI2V)以及视频续播等原生任务,并能无缝兼容单流与多流音频输入。00

LongCat-Video-Avatar-1.5最新开源LongCat-Video-Avatar 1.5 版本,这是一款经过升级的开源框架,专注于音频驱动人物视频生成的极致实证优化与生产级就绪能力。该版本在 LongCat-Video 基础模型之上构建,可生成高度稳定的商用级虚拟人视频,支持音频-文本转视频(AT2V)、音频-文本-图像转视频(ATI2V)以及视频续播等原生任务,并能无缝兼容单流与多流音频输入。00 auto-devAutoDev 是一个 AI 驱动的辅助编程插件。AutoDev 支持一键生成测试、代码、提交信息等,还能够与您的需求管理系统(例如Jira、Trello、Github Issue 等)直接对接。 在IDE 中,您只需简单点击,AutoDev 会根据您的需求自动为您生成代码。Kotlin03

auto-devAutoDev 是一个 AI 驱动的辅助编程插件。AutoDev 支持一键生成测试、代码、提交信息等,还能够与您的需求管理系统(例如Jira、Trello、Github Issue 等)直接对接。 在IDE 中,您只需简单点击,AutoDev 会根据您的需求自动为您生成代码。Kotlin03 Intern-S2-PreviewIntern-S2-Preview,这是一款高效的350亿参数科学多模态基础模型。除了常规的参数与数据规模扩展外,Intern-S2-Preview探索了任务扩展:通过提升科学任务的难度、多样性与覆盖范围,进一步释放模型能力。Python00

Intern-S2-PreviewIntern-S2-Preview,这是一款高效的350亿参数科学多模态基础模型。除了常规的参数与数据规模扩展外,Intern-S2-Preview探索了任务扩展:通过提升科学任务的难度、多样性与覆盖范围,进一步释放模型能力。Python00 skillhubopenJiuwen 生态的 Skill 托管与分发开源方案,支持自建与可选 ClawHub 兼容。Python0111

skillhubopenJiuwen 生态的 Skill 托管与分发开源方案,支持自建与可选 ClawHub 兼容。Python0111