从数据混乱到质量透明:DataHub数据质量报告全攻略

你是否还在为数据质量问题头疼?团队协作中,数据不一致、缺失或错误常常导致决策失误和资源浪费。本文将详细介绍如何利用DataHub的数据质量报告功能,通过可视化监控和灵活导出,让你的数据质量问题无所遁形,帮助团队轻松掌握数据健康状况。读完本文,你将学会如何配置数据质量检查、生成直观报告、导出关键指标,并通过实际案例了解如何应用这些功能提升数据管理效率。

数据质量报告基础

DataHub的数据质量报告功能是监控和管理数据健康状况的核心工具。它能够整合来自不同数据源的质量指标,通过统一界面展示数据完整性、准确性、一致性等关键维度。数据质量报告不仅帮助数据管理员快速识别问题,还能为数据消费者提供可信的数据使用依据。

DataHub通过数据合约(Data Contract) 机制定义数据质量规则,如metadata-ingestion/src/datahub/api/entities/datacontract/datacontract.py中定义的数据质量断言(DataQualityAssertion),支持用户自定义检查规则,如字段非空、格式验证、业务逻辑校验等。这些规则会自动应用于数据资产,并生成实时质量评分。

可视化监控面板

DataHub提供直观的可视化监控面板,将复杂的数据质量指标转化为易懂的图表和仪表盘。用户可以通过Web界面实时查看各数据资产的质量状态,包括通过/失败检查项、分数趋势、问题分布等。

以下是DataHub数据质量可视化的核心功能:

- 质量评分卡片:每个数据资产显示综合质量分数,颜色编码(绿色/黄色/红色)直观反映健康状态

- 趋势图表:展示质量分数随时间变化,帮助识别周期性问题或改进趋势

- 问题分布热力图:按数据源、数据类型或业务域分类展示质量问题,快速定位高风险区域

- 规则执行日志:详细记录每个检查项的执行结果,支持钻取查看具体错误信息

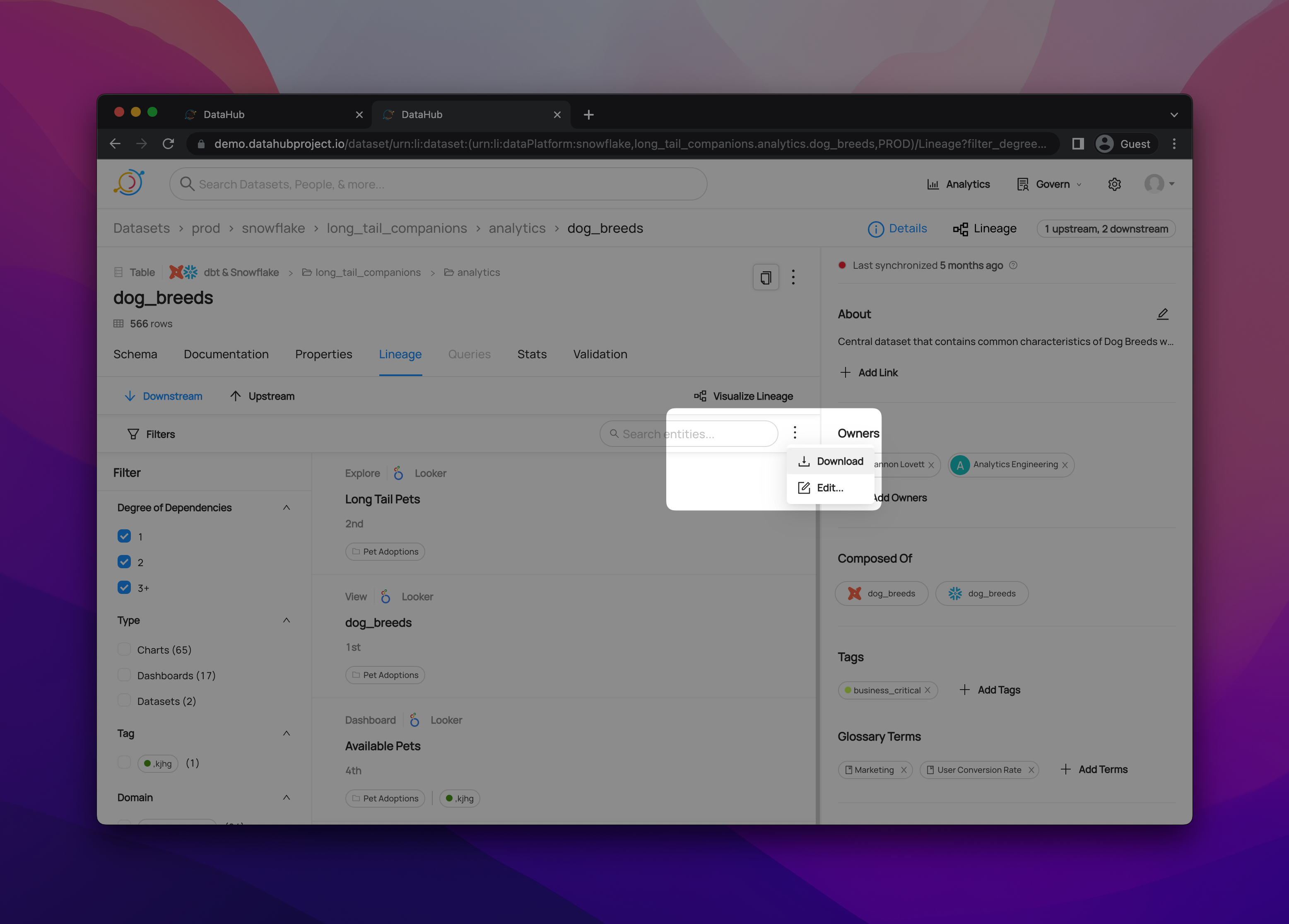

图:DataHub数据质量监控面板,展示多个数据集的质量评分和问题分布

报告导出功能详解

DataHub支持将数据质量报告导出为多种格式,满足不同场景需求,如离线分析、合规审计、定期汇报等。导出功能通过命令行工具实现,操作简单且灵活。

导出命令基础用法

使用DataHub Lite CLI的export命令可以将质量报告导出为JSON格式:

datahub lite export --file /path/to/quality_report.json

该命令会将所有数据资产的质量检查结果导出到指定文件,包含以下信息:

- 数据资产URN和名称

- 质量检查时间戳

- 各检查项的通过状态和详细结果

- 综合质量评分

高级导出选项

DataHub还支持自定义导出范围和格式,例如:

# 导出特定数据集的质量报告

datahub lite export --file report.json --urn "urn:li:dataset:(urn:li:dataPlatform:hive,default.mytable,PROD)"

# 导出最近24小时的质量变化

datahub lite export --file daily_report.json --time-window 24h

导出的JSON文件可通过Python脚本进一步处理,生成CSV或PDF报告:

import json

import csv

with open('quality_report.json', 'r') as f:

data = json.load(f)

with open('quality_report.csv', 'w', newline='') as f:

writer = csv.writer(f)

writer.writerow(['数据集名称', '质量分数', '检查时间', '问题数量'])

for asset in data['assets']:

writer.writerow([

asset['name'],

asset['quality_score'],

asset['timestamp'],

asset['issue_count']

])

实际应用案例

案例1:电商平台数据质量监控

某电商企业使用DataHub监控核心交易表的数据质量。通过配置以下数据质量规则:

- 订单ID非空检查

- 用户ID格式验证(UUID)

- 订单金额>0校验

- 订单时间戳在合理范围内

每日自动生成质量报告并导出为CSV,通过定时任务发送给数据团队。系统上线后,数据异常发现时间从平均2天缩短至2小时,订单数据准确率提升35%。

案例2:金融合规报告

某银行利用DataHub的数据质量报告功能满足监管合规要求。通过导出每月质量报告并存储归档,实现了:

- 自动化合规审计流程,减少70%人工工作量

- 完整的质量指标历史记录,支持回溯分析

- 可定制的报告模板,满足不同监管机构要求

最佳实践与常见问题

最佳实践

- 定期自动导出:配置每日/每周定时任务,自动导出质量报告并存储,建立质量指标基线

- 结合告警机制:将质量报告与Slack/Email告警集成,当分数低于阈值时及时通知负责人

- 定制检查规则:根据业务需求定义关键质量指标,避免过度监控导致噪音

常见问题解决

- 导出文件过大:使用

--urn参数限定导出范围,或通过--time-window只导出增量变化 - 报告生成缓慢:对于大规模数据集,建议在非高峰时段执行导出命令

- 格式不兼容:使用metadata-ingestion/examples/library/data_quality_mcpw_rest.py中的转换脚本,将JSON转为其他格式

总结与展望

DataHub的数据质量报告功能通过可视化监控和灵活导出,为数据治理提供了强大支持。无论是实时监控还是合规审计,都能帮助团队高效管理数据质量。未来,DataHub计划增强报告功能,包括:

- 自定义报告模板

- 更多可视化图表类型

- 与BI工具(如Tableau、PowerBI)的原生集成

立即开始使用DataHub,让数据质量透明化,为业务决策提供可靠保障!

行动指南:

- 点赞收藏本文,方便后续查阅

- 关注项目更新,获取最新功能动态

- 尝试导出你的第一份数据质量报告,识别团队数据痛点

下期待续:《DataHub数据质量规则高级配置指南》

atomcodeClaude Code 的开源替代方案。连接任意大模型,编辑代码,运行命令,自动验证 — 全自动执行。用 Rust 构建,极致性能。 | An open-source alternative to Claude Code. Connect any LLM, edit code, run commands, and verify changes — autonomously. Built in Rust for speed. Get StartedRust0153

atomcodeClaude Code 的开源替代方案。连接任意大模型,编辑代码,运行命令,自动验证 — 全自动执行。用 Rust 构建,极致性能。 | An open-source alternative to Claude Code. Connect any LLM, edit code, run commands, and verify changes — autonomously. Built in Rust for speed. Get StartedRust0153- DDeepSeek-V4-ProDeepSeek-V4-Pro(总参数 1.6 万亿,激活 49B)面向复杂推理和高级编程任务,在代码竞赛、数学推理、Agent 工作流等场景表现优异,性能接近国际前沿闭源模型。Python00

LongCat-Video-Avatar-1.5最新开源LongCat-Video-Avatar 1.5 版本,这是一款经过升级的开源框架,专注于音频驱动人物视频生成的极致实证优化与生产级就绪能力。该版本在 LongCat-Video 基础模型之上构建,可生成高度稳定的商用级虚拟人视频,支持音频-文本转视频(AT2V)、音频-文本-图像转视频(ATI2V)以及视频续播等原生任务,并能无缝兼容单流与多流音频输入。00

LongCat-Video-Avatar-1.5最新开源LongCat-Video-Avatar 1.5 版本,这是一款经过升级的开源框架,专注于音频驱动人物视频生成的极致实证优化与生产级就绪能力。该版本在 LongCat-Video 基础模型之上构建,可生成高度稳定的商用级虚拟人视频,支持音频-文本转视频(AT2V)、音频-文本-图像转视频(ATI2V)以及视频续播等原生任务,并能无缝兼容单流与多流音频输入。00 auto-devAutoDev 是一个 AI 驱动的辅助编程插件。AutoDev 支持一键生成测试、代码、提交信息等,还能够与您的需求管理系统(例如Jira、Trello、Github Issue 等)直接对接。 在IDE 中,您只需简单点击,AutoDev 会根据您的需求自动为您生成代码。Kotlin03

auto-devAutoDev 是一个 AI 驱动的辅助编程插件。AutoDev 支持一键生成测试、代码、提交信息等,还能够与您的需求管理系统(例如Jira、Trello、Github Issue 等)直接对接。 在IDE 中,您只需简单点击,AutoDev 会根据您的需求自动为您生成代码。Kotlin03 Intern-S2-PreviewIntern-S2-Preview,这是一款高效的350亿参数科学多模态基础模型。除了常规的参数与数据规模扩展外,Intern-S2-Preview探索了任务扩展:通过提升科学任务的难度、多样性与覆盖范围,进一步释放模型能力。Python00

Intern-S2-PreviewIntern-S2-Preview,这是一款高效的350亿参数科学多模态基础模型。除了常规的参数与数据规模扩展外,Intern-S2-Preview探索了任务扩展:通过提升科学任务的难度、多样性与覆盖范围,进一步释放模型能力。Python00 skillhubopenJiuwen 生态的 Skill 托管与分发开源方案,支持自建与可选 ClawHub 兼容。Python0112

skillhubopenJiuwen 生态的 Skill 托管与分发开源方案,支持自建与可选 ClawHub 兼容。Python0112