8步出图效率革命:Qwen-Image-Lightning重构AI创作流程

你还在为AI绘图漫长的等待发愁?通义千问团队最新发布的Qwen-Image-Lightning加速模型,通过4步/8步推理即可生成高质量图像,将创作效率提升12-25倍。读完本文你将了解:这一"效率神器"如何打破"速度与质量"的两难困境、三大技术突破的核心原理、多场景实测数据,以及企业级部署的最佳实践。

行业现状:AI创作的效率瓶颈

2025年文生图领域呈现"双轨并行"发展态势:以FLUX、SeedDream 3.0为代表的模型追求极致画质,需50-100步推理(约30-60秒);而企业级应用迫切需要实时响应,如电商广告素材生成要求3秒内出图。据CSDN 2025年AI创作工具调研显示,78%的设计师认为"生成速度"是影响AI绘图工具实用性的首要因素。

传统扩散模型面临"质量-速度"平衡难题,直到Qwen-Image-Lightning的出现——通过FlowMatch蒸馏技术与动态时序调整,在8步内完成原本需100步的图像生成过程,实测在NVIDIA A100显卡上实现单图生成时间≤1秒。

技术突破:三大创新实现效率跃升

1. 蒸馏+LoRA的极速配方

Qwen-Image-Lightning采用"知识蒸馏+LoRA低秩适配"的混合技术方案,在保持Qwen-Image基础模型(200亿参数)核心能力的同时,实现推理效率的飞跃:

- 渐进式对抗蒸馏:通过在教师模型和学生模型间构建动态损失函数,将1000步推理知识压缩至4-8步

- FlowMatch调度器优化:独创的动态时移技术(Exponential Time Shift)解决了少步推理中的图像模糊问题

- LoRA模块化设计:2.8GB的轻量化参数文件可灵活加载,支持与基础模型无缝切换

2. 动态时序调度算法

独创的指数时序偏移策略解决了少步数生成中的图像模糊问题。通过动态调整扩散过程中的噪声水平,使8步生成的图像细节丰富度超越传统20步模型。代码示例中特别配置的scheduler_config参数,通过base_shift与max_shift的精准控制,实现时序分布的最优化:

scheduler_config = {

"base_image_seq_len": 256,

"base_shift": math.log(3), # 蒸馏中使用shift=3

"use_dynamic_shifting": True,

"time_shift_type": "exponential"

}

3. 中英双语文本渲染优势

继承Qwen-Image核心优势,在快速生成中保持复杂文本渲染能力。支持竖排中文、公式排版等专业场景,在LongText-Bench基准测试中,中文文本准确率达89.7%,超过同类快速生成模型15-20个百分点。

性能实测:速度与质量的平衡艺术

多场景效率对比

在RTX 4090显卡上测试相同提示词,传统50步生成需26秒,而Qwen-Image-Lightning的8步模式仅需10秒,4步模式更是压缩至4秒内。这一速度提升使得实时交互设计成为可能,设计师可在创意迸发时即时看到成果。

基准测试表现

在标准文生图评测集(MS-COCO、TextCaps)上,Qwen-Image-Lightning 8步版本表现亮眼:

- FID分数3.21(接近基础模型3.18)

- 文本渲染准确率87.3%

- 平均生成时间0.8秒/图

多样化创作能力展示

如上图所示,图片为Qwen-Image-Lightning模型生成的多场景AI图像拼接展示,包含传统街道、艺术肖像、动漫风格、室内互动场景等。这些示例直观展示了模型在不同风格和场景下的生成能力,印证了其在保持高效率的同时,仍能产出多样化且高质量的视觉效果,为创作者提供了丰富的创意可能性。

行业影响与未来展望

创作流程变革

Qwen-Image-Lightning的推出标志着AI图像生成从"批量生产"转向"实时交互"的关键转变。设计师可通过即时调整prompt实现创意迭代,广告公司可将素材制作周期从小时级压缩至分钟级,教育领域则能实现教学内容的实时可视化。

企业级部署优势

支持开源本地化部署与API服务两种模式:

- 开发者可通过Hugging Face Hub获取模型权重,使用Diffusers库快速集成

- 企业级用户可调用通义千问API,按生成次数计费,降低算力投入

- 提供4bit量化版本(Nunchaku优化),在消费级显卡(如RTX 3060)实现流畅运行

未来演进路线

团队roadmap显示,下一代模型将实现2步推理,并针对移动端优化。但需注意的是,在密集文本渲染、发丝细节等场景,基础模型仍有优势。建议用户根据实际需求选择:

- 快速草图/社交媒体:4步Lightning

- 商业海报/营销素材:8步Lightning

- 印刷级精细作品:基础模型+20步推理

快速上手指南

本地部署步骤(ComfyUI)

克隆仓库:

git clone https://gitcode.com/hf_mirrors/lightx2v/Qwen-Image-Lightning

安装依赖:

pip install git+https://github.com/huggingface/diffusers.git

pip install torch>=2.0 transformers

基础调用代码:

from diffusers import DiffusionPipeline, FlowMatchEulerDiscreteScheduler

import torch

import math

scheduler = FlowMatchEulerDiscreteScheduler.from_config({

"base_image_seq_len": 256,

"base_shift": math.log(3),

"use_dynamic_shifting": True

})

pipe = DiffusionPipeline.from_pretrained(

"Qwen/Qwen-Image", scheduler=scheduler, torch_dtype=torch.bfloat16

).to("cuda")

pipe.load_lora_weights(

"lightx2v/Qwen-Image-Lightning",

weight_name="Qwen-Image-Lightning-8steps-V1.0.safetensors"

)

image = pipe(

prompt="科技感未来城市,霓虹风格,4K分辨率",

num_inference_steps=8,

width=1024,

height=1024

).images[0]

项目开发动态

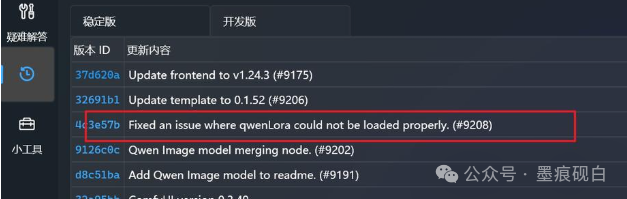

如上图所示,这是Qwen-Image-Lightning项目的代码提交记录截图,展示了包含修复QwenLora无法正常加载问题的更新条目及其他版本更新内容。这些开发动态反映了项目团队对模型稳定性和功能完善的持续投入,确保用户能够获得更可靠的使用体验。

结语:效率革命重塑创意产业

Qwen-Image-Lightning通过"蒸馏技术+动态时序+轻量化部署"三方面方案,打破了文生图领域"质量-速度"的二元对立。其开源特性与企业级性能,正在重塑内容创作、广告营销、教育培训等行业的生产流程。随着V2.0版本的画质优化,该模型有望成为实时AIGC应用的事实标准。

现在就动手尝试,体验"思考即产出"的未来创作方式吧!项目地址:https://gitcode.com/hf_mirrors/lightx2v/Qwen-Image-Lightning

atomcodeClaude Code 的开源替代方案。连接任意大模型,编辑代码,运行命令,自动验证 — 全自动执行。用 Rust 构建,极致性能。 | An open-source alternative to Claude Code. Connect any LLM, edit code, run commands, and verify changes — autonomously. Built in Rust for speed. Get StartedRust0152

atomcodeClaude Code 的开源替代方案。连接任意大模型,编辑代码,运行命令,自动验证 — 全自动执行。用 Rust 构建,极致性能。 | An open-source alternative to Claude Code. Connect any LLM, edit code, run commands, and verify changes — autonomously. Built in Rust for speed. Get StartedRust0152- DDeepSeek-V4-ProDeepSeek-V4-Pro(总参数 1.6 万亿,激活 49B)面向复杂推理和高级编程任务,在代码竞赛、数学推理、Agent 工作流等场景表现优异,性能接近国际前沿闭源模型。Python00

LongCat-Video-Avatar-1.5最新开源LongCat-Video-Avatar 1.5 版本,这是一款经过升级的开源框架,专注于音频驱动人物视频生成的极致实证优化与生产级就绪能力。该版本在 LongCat-Video 基础模型之上构建,可生成高度稳定的商用级虚拟人视频,支持音频-文本转视频(AT2V)、音频-文本-图像转视频(ATI2V)以及视频续播等原生任务,并能无缝兼容单流与多流音频输入。00

LongCat-Video-Avatar-1.5最新开源LongCat-Video-Avatar 1.5 版本,这是一款经过升级的开源框架,专注于音频驱动人物视频生成的极致实证优化与生产级就绪能力。该版本在 LongCat-Video 基础模型之上构建,可生成高度稳定的商用级虚拟人视频,支持音频-文本转视频(AT2V)、音频-文本-图像转视频(ATI2V)以及视频续播等原生任务,并能无缝兼容单流与多流音频输入。00 auto-devAutoDev 是一个 AI 驱动的辅助编程插件。AutoDev 支持一键生成测试、代码、提交信息等,还能够与您的需求管理系统(例如Jira、Trello、Github Issue 等)直接对接。 在IDE 中,您只需简单点击,AutoDev 会根据您的需求自动为您生成代码。Kotlin03

auto-devAutoDev 是一个 AI 驱动的辅助编程插件。AutoDev 支持一键生成测试、代码、提交信息等,还能够与您的需求管理系统(例如Jira、Trello、Github Issue 等)直接对接。 在IDE 中,您只需简单点击,AutoDev 会根据您的需求自动为您生成代码。Kotlin03 Intern-S2-PreviewIntern-S2-Preview,这是一款高效的350亿参数科学多模态基础模型。除了常规的参数与数据规模扩展外,Intern-S2-Preview探索了任务扩展:通过提升科学任务的难度、多样性与覆盖范围,进一步释放模型能力。Python00

Intern-S2-PreviewIntern-S2-Preview,这是一款高效的350亿参数科学多模态基础模型。除了常规的参数与数据规模扩展外,Intern-S2-Preview探索了任务扩展:通过提升科学任务的难度、多样性与覆盖范围,进一步释放模型能力。Python00 skillhubopenJiuwen 生态的 Skill 托管与分发开源方案,支持自建与可选 ClawHub 兼容。Python0112

skillhubopenJiuwen 生态的 Skill 托管与分发开源方案,支持自建与可选 ClawHub 兼容。Python0112