20分钟上手!WeChat Bot贡献代码完全指南:从环境搭建到PR提交

你是否曾想为开源项目贡献代码,却被复杂的流程吓退?本文将带你20分钟内掌握WeChat Bot项目的贡献全流程,从环境配置到代码提交,让你的开源贡献之旅零门槛起步。读完本文,你将能够:

- 快速搭建本地开发环境

- 理解项目核心模块架构

- 开发新功能或修复bug

- 提交高质量PR并通过审核

项目架构速览

WeChat Bot是一个基于WeChaty框架开发的微信机器人,集成了多种AI服务实现智能回复功能。项目采用模块化设计,主要分为以下几个核心部分:

核心目录结构

GitHub_Trending/we/wechat-bot/

├── src/ # 源代码目录

│ ├── wechaty/ # WeChaty核心模块

│ │ ├── sendMessage.js # 消息发送逻辑

│ │ ├── serve.js # AI服务路由

│ │ └── testMessage.js # 消息测试

│ ├── [ai-service]/ # 各AI服务实现

│ │ ├── index.js # 服务入口

│ │ └── __test__.js # 单元测试

│ └── index.js # 项目入口

├── package.json # 项目依赖配置

└── .env.example # 环境变量示例

关键模块解析

- 消息处理模块:src/wechaty/sendMessage.js 负责消息接收和回复逻辑,包含群聊和私聊处理

- AI服务路由:src/wechaty/serve.js 管理不同AI服务的路由分发,目前支持12种AI服务

- AI服务实现:每个AI服务对应独立目录,如src/openai/、src/kimi/等,遵循统一接口规范

开发环境搭建

准备工作

在开始之前,请确保你的开发环境满足以下要求:

- Node.js >= v18.0(推荐LTS版本)

- Git

- npm或yarn

- 微信账号(用于测试)

步骤1:克隆代码库

git clone https://gitcode.com/GitHub_Trending/we/wechat-bot.git

cd wechat-bot

步骤2:安装依赖

# 使用npm

npm install

# 或使用yarn(推荐)

yarn install

中国大陆用户建议切换npm镜像源加速安装:

npm config set registry https://registry.npmmirror.com

步骤3:配置环境变量

复制环境变量示例文件并根据需要修改:

cp .env.example .env

编辑.env文件,至少配置一种AI服务的API密钥,例如OpenAI:

OPENAI_API_KEY=你的API密钥

OPENAI_MODEL=gpt-4o

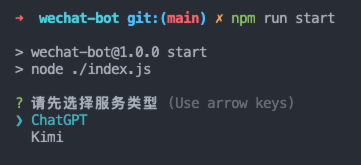

步骤4:验证安装

运行测试命令验证环境是否配置成功:

# 测试OpenAI服务

npm run test-openai

# 或测试Kimi服务

npm run test-kimi

如果一切正常,你将看到AI服务返回的测试回复。

开发新功能

功能开发流程

WeChat Bot采用"功能模块化"开发方式,新增功能或AI服务遵循以下流程:

graph TD

A[确定需求] --> B[创建模块目录]

B --> C[实现核心功能]

C --> D[编写单元测试]

D --> E[更新服务路由]

E --> F[本地测试验证]

示例:添加新的AI服务

下面以添加"NewAI"服务为例,演示完整开发流程:

- 创建模块目录

mkdir -p src/newai

touch src/newai/index.js src/newai/__test__.js

- 实现核心功能

import axios from 'axios'

import dotenv from 'dotenv'

const env = dotenv.config().parsed

export async function getNewAiReply(prompt) {

try {

const response = await axios.post(

env.NEWAI_API_URL,

{

prompt: prompt,

model: env.NEWAI_MODEL || 'default-model'

},

{

headers: {

'Content-Type': 'application/json',

'Authorization': `Bearer ${env.NEWAI_API_KEY}`

}

}

)

return response.data.choices[0].text

} catch (error) {

console.error('NewAI API error:', error)

throw error

}

}

- 编写单元测试

import { getNewAiReply } from './index.js'

async function testNewAI() {

try {

const response = await getNewAiReply('Hello, NewAI!')

console.log('NewAI 回复:', response)

} catch (error) {

console.error('测试失败:', error)

}

}

testNewAI()

- 更新服务路由

修改src/wechaty/serve.js,添加新服务路由:

import { getNewAiReply } from '../newai/index.js'

// ...

export function getServe(serviceType) {

switch (serviceType) {

// ... 现有服务

case 'newai':

return getNewAiReply

default:

return getGptReply

}

}

- 本地测试

# 添加测试命令到package.json

npm run start -- --serve newai

代码规范与提交

代码风格

项目使用Prettier进行代码格式化,提交前请确保代码风格一致:

# 自动格式化代码

npm run format

提交规范

提交代码时,请遵循以下格式:

<type>(<scope>): <subject>

<body>

<footer>

- type:提交类型(feat: 新功能, fix: 修复bug, docs: 文档更新等)

- scope:影响范围(如wechaty, openai, kimi等)

- subject:简短描述(不超过50字符)

示例:

feat(kimi): 添加长文本处理支持

- 实现Kimi 128k模型的流式响应

- 添加文本分片处理逻辑

Closes #123

提交PR流程

- 创建分支

git checkout -b feature/your-feature-name

- 提交更改

git add .

git commit -m "feat: 添加新功能描述"

- 推送到远程

git push origin feature/your-feature-name

- 创建PR

访问项目GitCode页面,点击"创建Pull Request",填写PR描述并提交。

测试与调试

测试策略

为确保代码质量,所有贡献都应包含适当的测试:

- 单元测试:每个AI服务提供test.js测试文件

- 集成测试:通过src/wechaty/testMessage.js测试消息处理流程

- 手动测试:运行完整机器人进行实际场景测试

运行与调试

# 开发模式运行

npm run dev

# 指定AI服务运行

npm run start -- --serve Kimi

运行后,扫描终端显示的二维码登录微信,即可测试机器人功能。

常见问题解决

依赖安装问题

-

puppeteer安装失败:设置环境变量跳过下载

# Mac/Linux export PUPPETEER_SKIP_DOWNLOAD='true' # Windows SET PUPPETEER_SKIP_DOWNLOAD='true' -

Wechaty安装问题:确保Node.js版本符合要求,尝试删除node_modules后重新安装

API调用问题

-

连接超时:检查代理设置,确保终端可以访问API服务

# 设置终端代理 export https_proxy=http://127.0.0.1:你的代理端口 -

API密钥错误:验证.env文件中的API密钥是否正确,权限是否足够

微信登录问题

- 登录二维码不显示:检查终端是否支持ANSI转义序列

- 登录后无响应:确认微信账号未开启设备锁,或尝试使用备用微信账号

贡献者指南

PR审核标准

为确保项目质量,PR需要满足以下条件:

- 代码符合项目风格规范

- 包含适当的测试用例

- 不引入破坏性变更

- 文档(如需要)已更新

- 所有CI检查通过

社区交流

贡献者名单

感谢所有为项目做出贡献的开发者:

总结与展望

本文详细介绍了WeChat Bot项目的贡献流程,从环境搭建到PR提交的完整步骤。通过模块化的设计,项目使得添加新功能或集成新AI服务变得简单直观。

未来,项目计划进一步优化:

- 完善插件系统,支持动态加载

- 增强多语言支持

- 提供更丰富的机器人管理功能

如果你觉得本指南对你有帮助,请点赞、收藏并关注项目,以便获取最新更新。期待你的第一个PR,让我们一起让WeChat Bot变得更加强大!

下一篇预告:《深入理解WeChat Bot的消息处理机制》,敬请关注!

atomcodeClaude Code 的开源替代方案。连接任意大模型,编辑代码,运行命令,自动验证 — 全自动执行。用 Rust 构建,极致性能。 | An open-source alternative to Claude Code. Connect any LLM, edit code, run commands, and verify changes — autonomously. Built in Rust for speed. Get StartedRust0152

atomcodeClaude Code 的开源替代方案。连接任意大模型,编辑代码,运行命令,自动验证 — 全自动执行。用 Rust 构建,极致性能。 | An open-source alternative to Claude Code. Connect any LLM, edit code, run commands, and verify changes — autonomously. Built in Rust for speed. Get StartedRust0152- DDeepSeek-V4-ProDeepSeek-V4-Pro(总参数 1.6 万亿,激活 49B)面向复杂推理和高级编程任务,在代码竞赛、数学推理、Agent 工作流等场景表现优异,性能接近国际前沿闭源模型。Python00

LongCat-Video-Avatar-1.5最新开源LongCat-Video-Avatar 1.5 版本,这是一款经过升级的开源框架,专注于音频驱动人物视频生成的极致实证优化与生产级就绪能力。该版本在 LongCat-Video 基础模型之上构建,可生成高度稳定的商用级虚拟人视频,支持音频-文本转视频(AT2V)、音频-文本-图像转视频(ATI2V)以及视频续播等原生任务,并能无缝兼容单流与多流音频输入。00

LongCat-Video-Avatar-1.5最新开源LongCat-Video-Avatar 1.5 版本,这是一款经过升级的开源框架,专注于音频驱动人物视频生成的极致实证优化与生产级就绪能力。该版本在 LongCat-Video 基础模型之上构建,可生成高度稳定的商用级虚拟人视频,支持音频-文本转视频(AT2V)、音频-文本-图像转视频(ATI2V)以及视频续播等原生任务,并能无缝兼容单流与多流音频输入。00 auto-devAutoDev 是一个 AI 驱动的辅助编程插件。AutoDev 支持一键生成测试、代码、提交信息等,还能够与您的需求管理系统(例如Jira、Trello、Github Issue 等)直接对接。 在IDE 中,您只需简单点击,AutoDev 会根据您的需求自动为您生成代码。Kotlin03

auto-devAutoDev 是一个 AI 驱动的辅助编程插件。AutoDev 支持一键生成测试、代码、提交信息等,还能够与您的需求管理系统(例如Jira、Trello、Github Issue 等)直接对接。 在IDE 中,您只需简单点击,AutoDev 会根据您的需求自动为您生成代码。Kotlin03 Intern-S2-PreviewIntern-S2-Preview,这是一款高效的350亿参数科学多模态基础模型。除了常规的参数与数据规模扩展外,Intern-S2-Preview探索了任务扩展:通过提升科学任务的难度、多样性与覆盖范围,进一步释放模型能力。Python00

Intern-S2-PreviewIntern-S2-Preview,这是一款高效的350亿参数科学多模态基础模型。除了常规的参数与数据规模扩展外,Intern-S2-Preview探索了任务扩展:通过提升科学任务的难度、多样性与覆盖范围,进一步释放模型能力。Python00 skillhubopenJiuwen 生态的 Skill 托管与分发开源方案,支持自建与可选 ClawHub 兼容。Python0112

skillhubopenJiuwen 生态的 Skill 托管与分发开源方案,支持自建与可选 ClawHub 兼容。Python0112