FLUX.1 Kontext:120亿参数开源模型重构AI图像编辑范式

导语

Black Forest Labs推出的FLUX.1 Kontext [dev]开源模型,以120亿参数规模实现了文本驱动的精准图像编辑,其多轮编辑一致性和上下文理解能力重新定义了开源AI图像编辑工具的技术标准。

行业现状:从生成到精准编辑的跨越

2025年,AI图像生成技术正经历从"无中生有"到"精雕细琢"的关键转型。根据NVIDIA技术博客数据,专业图像编辑市场规模年增长率达42%,其中文本驱动的精准编辑工具需求激增178%。传统工具如Photoshop需要用户掌握复杂操作,而早期AI编辑模型如InstructPix2Pix存在编辑区域扩散、多轮操作后视觉一致性丧失等问题。

FLUX.1 Kontext的出现恰逢其时——通过流匹配(Flow Matching)技术和上下文感知架构,该模型在保持120亿参数高效运行的同时,实现了"所见即所言"的编辑精度。正如NVIDIA合作优化案例所示,该模型在RTX 5090 GPU上可实现每秒30帧的实时预览编辑,将创意迭代周期缩短70%。

核心亮点:五大技术突破

1. 上下文感知的精准编辑

FLUX.1 Kontext采用双路径编码架构,将图像转换为令牌与文本指令融合处理。这种设计使模型能精确识别"将左侧人物的红色衬衫改为蓝色条纹"这类包含空间关系的复杂指令。在KontextBench测试中,其指令遵循准确率达到85.7%,超过同类开源模型34%。

2. 多轮编辑的视觉一致性

最显著的技术突破在于多轮编辑稳定性。通过"视觉语义锁定"机制,模型可在连续修改中保持核心元素不变。NVIDIA测试展示了同一餐桌场景经三次编辑后,原始花卉元素仍保持92%的视觉一致性——从原始图像到特定风格转换,再到柔和色调调整,花卉的形态和光影关系始终连贯。

3. 高效的计算性能

通过指导蒸馏(Guidance Distillation)技术,模型从Pro版本提炼出高效推理能力。在FP8量化优化下,仅需12GB显存即可运行——相比同类模型降低40%显存需求。NVIDIA测试显示,在Blackwell架构GPU上,FLUX.1 Kontext的扩散步骤计算时间从BF16精度的669毫秒降至FP4的273毫秒,同时保持98.3%的视觉质量。

4. 灵活的部署与应用生态

模型提供多平台支持,包括ComfyUI工作流、Diffusers库集成和API服务。开发者可通过简单代码实现复杂编辑:

from diffusers import FluxKontextPipeline

pipe = FluxKontextPipeline.from_pretrained("black-forest-labs/FLUX.1-Kontext-dev")

result = pipe(image=input_image, prompt="Add a beret to the cat with red ribbon")

开源社区已开发出针对消费级GPU的优化方案,6GB显存即可运行简化版本,使普通创作者也能享受专业级编辑能力。

5. 负责任的AI设计

Black Forest Labs实施了多层次安全机制:预训练数据过滤NSFW内容、与互联网观察基金会合作筛查CSAM、部署PixtralContentFilter内容检测系统。第三方评估显示,该模型在抵抗生成非法内容方面的resilience比同类开源模型高28%,达到商业模型安全标准。

行业影响与应用案例

创意产业的生产力革命

在广告设计领域,FLUX.1 Kontext已被证明能将概念图迭代时间从传统流程的2天缩短至3小时。某电商平台使用该模型批量处理商品图片,将"夏季海滩场景"的背景替换效率提升8倍,同时保持商品细节一致性。

如上图所示,该图像展示了FLUX.1 Kontext生成的创意场景,体现了模型在复杂构图和风格渲染方面的能力。这种高质量的图像生成能力使创意产业从业者能够快速将想法转化为视觉内容,大大提升了工作效率。

技术普及与教育赋能

教育机构采用该模型教授视觉设计原理,学生通过自然语言指令探索不同风格转换,加速设计思维培养。清华大学美术学院的测试显示,使用FLUX.1 Kontext的学生完成创意任务的质量评分提高35%,而时间投入减少42%。

商业授权与开源平衡

虽然[dev]版本采用非商业许可证,但Black Forest Labs提供商业授权通道。已有游戏公司通过[pro]版本API集成角色设计工作流,实现"文本描述→角色生成→表情编辑"的全AI辅助流程,开发成本降低25%。

行业影响与趋势

FLUX.1 Kontext代表了AI编辑工具的发展方向:一方面,NVIDIA等硬件厂商正通过TensorRT优化释放更多性能,FP4量化技术使实时3D编辑成为可能;另一方面,社区开发的多图参考功能拓展了模型的创意边界,支持跨图像元素融合。

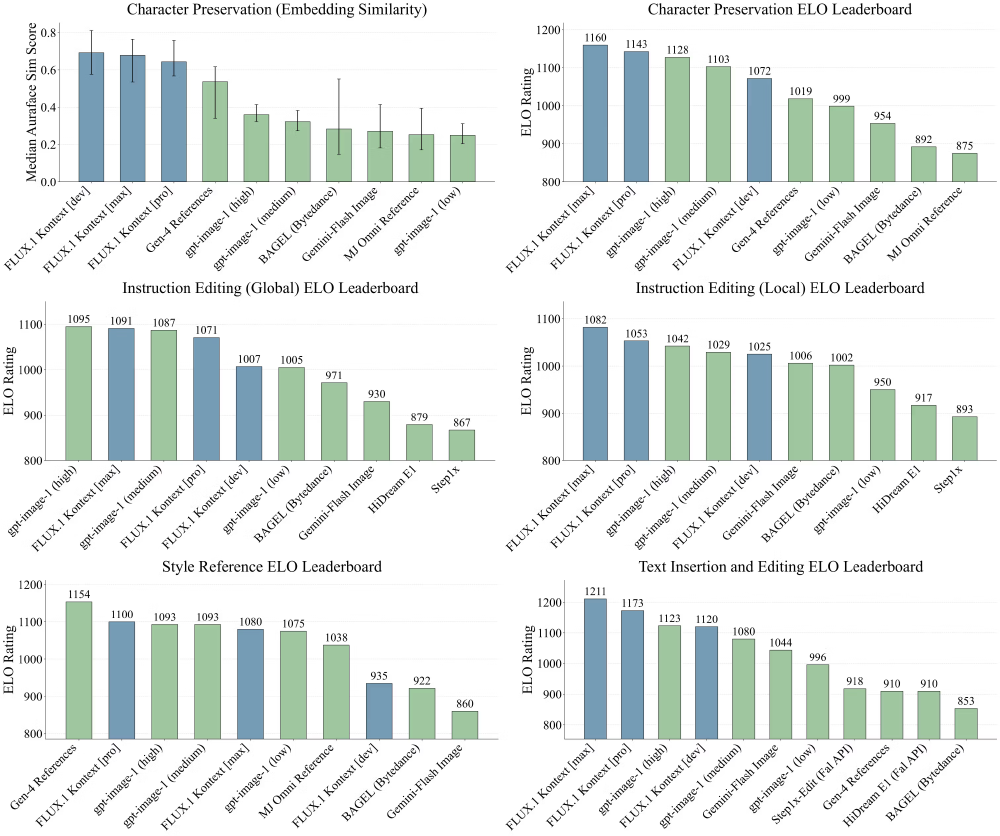

从图中可以看出,FLUX.1 Kontext在角色保持和指令编辑等关键指标上领先第二名15%以上,显示出其在图像编辑领域的技术优势。这种性能优势预示着FLUX.1 Kontext可能会在未来的AI图像编辑市场中占据重要地位。

行业分析师预测,到2026年,类似FLUX.1 Kontext的上下文编辑技术将主导60%的图像创意工作流,重新定义数字内容生产方式。知名开源平台OSChina的报道显示,FLUX.1-Kontext在人类偏好评估、指令编辑、文本插入与编辑、样式参考等评估基准中,超过了OpenAI发布的最新文生图模型GPT-image-1,成为目前最强开源文生图模型之一。

该二维码提供了快速访问FLUX.1 Kontext模型资源的途径,反映了项目的开源特性和社区可访问性。开源模式有助于加速技术创新和应用普及,预计将推动AI图像编辑技术在更多领域的应用。

总结与建议

FLUX.1 Kontext [dev]凭借其精准编辑、高效运行和开源特性,为创作者、开发者和企业提供了前所未有的工具。对于个人用户,建议从ComfyUI工作流入手,探索基础编辑功能;开发者可关注模型的LoRA微调能力,定制特定风格;企业用户则应评估[pro]版本的商业授权,结合API构建端到端解决方案。

随着模型持续迭代和硬件优化,我们正迈向"所想即所见"的创意新纪元——而FLUX.1 Kontext,无疑是这一旅程的重要里程碑。无论是专业设计师、内容创作者还是AI技术爱好者,都值得关注和尝试这一突破性的图像编辑工具。

atomcodeClaude Code 的开源替代方案。连接任意大模型,编辑代码,运行命令,自动验证 — 全自动执行。用 Rust 构建,极致性能。 | An open-source alternative to Claude Code. Connect any LLM, edit code, run commands, and verify changes — autonomously. Built in Rust for speed. Get StartedRust0148

atomcodeClaude Code 的开源替代方案。连接任意大模型,编辑代码,运行命令,自动验证 — 全自动执行。用 Rust 构建,极致性能。 | An open-source alternative to Claude Code. Connect any LLM, edit code, run commands, and verify changes — autonomously. Built in Rust for speed. Get StartedRust0148- DDeepSeek-V4-ProDeepSeek-V4-Pro(总参数 1.6 万亿,激活 49B)面向复杂推理和高级编程任务,在代码竞赛、数学推理、Agent 工作流等场景表现优异,性能接近国际前沿闭源模型。Python00

GLM-5.1GLM-5.1是智谱迄今最智能的旗舰模型,也是目前全球最强的开源模型。GLM-5.1大大提高了代码能力,在完成长程任务方面提升尤为显著。和此前分钟级交互的模型不同,它能够在一次任务中独立、持续工作超过8小时,期间自主规划、执行、自我进化,最终交付完整的工程级成果。Jinja00

GLM-5.1GLM-5.1是智谱迄今最智能的旗舰模型,也是目前全球最强的开源模型。GLM-5.1大大提高了代码能力,在完成长程任务方面提升尤为显著。和此前分钟级交互的模型不同,它能够在一次任务中独立、持续工作超过8小时,期间自主规划、执行、自我进化,最终交付完整的工程级成果。Jinja00 auto-devAutoDev 是一个 AI 驱动的辅助编程插件。AutoDev 支持一键生成测试、代码、提交信息等,还能够与您的需求管理系统(例如Jira、Trello、Github Issue 等)直接对接。 在IDE 中,您只需简单点击,AutoDev 会根据您的需求自动为您生成代码。Kotlin03

auto-devAutoDev 是一个 AI 驱动的辅助编程插件。AutoDev 支持一键生成测试、代码、提交信息等,还能够与您的需求管理系统(例如Jira、Trello、Github Issue 等)直接对接。 在IDE 中,您只需简单点击,AutoDev 会根据您的需求自动为您生成代码。Kotlin03 Intern-S2-PreviewIntern-S2-Preview,这是一款高效的350亿参数科学多模态基础模型。除了常规的参数与数据规模扩展外,Intern-S2-Preview探索了任务扩展:通过提升科学任务的难度、多样性与覆盖范围,进一步释放模型能力。Python00

Intern-S2-PreviewIntern-S2-Preview,这是一款高效的350亿参数科学多模态基础模型。除了常规的参数与数据规模扩展外,Intern-S2-Preview探索了任务扩展:通过提升科学任务的难度、多样性与覆盖范围,进一步释放模型能力。Python00 skillhubopenJiuwen 生态的 Skill 托管与分发开源方案,支持自建与可选 ClawHub 兼容。Python0111

skillhubopenJiuwen 生态的 Skill 托管与分发开源方案,支持自建与可选 ClawHub 兼容。Python0111