0.5B参数颠覆语音合成!VoxCPM开源模型实现实时高拟真语音克隆

导语

面壁智能最新开源的VoxCPM语音合成模型以0.5B轻量化参数实现高拟真语音生成,其零样本克隆技术可精准捕捉方言、情感和语速特征,在消费级GPU上达到0.17实时因子,重新定义了轻量化TTS系统的技术边界。

行业现状:TTS技术进入"参数竞赛"与"实用化"并行阶段

根据GMI Insights报告,全球文本转语音市场规模2023年已突破40亿美元,预计2023-2032年将以14%的复合年增长率持续扩张。当前行业呈现两大趋势:一方面,企业级模型参数规模不断攀升至百亿级,追求极致拟真度;另一方面,轻量化模型成为落地关键,如Kokoro TTS(82M参数)、VoxCPM(0.5B参数)等通过架构创新,在保持性能的同时大幅降低部署门槛。

IDC最新预测显示,2025年全球智能语音市场规模将突破500亿美元,教育、医疗、跨境电商成为主要增长点。尤其在外贸领域,语言障碍导致30%的潜在商机流失,而传统TTS系统因机械语调、缺乏情感表达,转化率不足人工沟通的1/3。

如上图所示,VoxCPM的品牌标识融合了声波图形与文字设计,直观体现其语音合成技术属性。这一设计象征着模型突破传统离散token限制,在连续语音空间中实现自然流畅的声音生成,为后续技术创新奠定品牌认知基础。

核心亮点:三大技术突破重构TTS性能基准

1. 无分词器架构突破传统TTS瓶颈

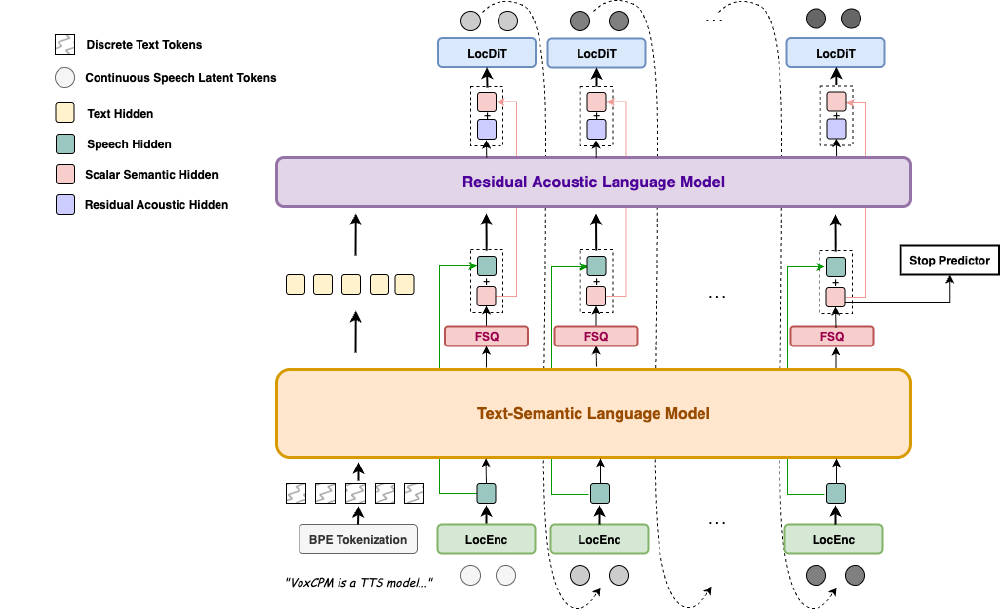

VoxCPM采用端到端扩散自回归架构,摒弃主流模型的语音离散token化处理,直接在连续空间生成语音表征。通过MiniCPM-4语言模型backbone与局部扩散Transformer(DiT)的创新结合,实现语义-声学特征的隐式解耦。在Seed-TTS-eval benchmark中,其英文WER(词错误率)仅1.85%,中文CER(字符错误率)低至0.93%,均优于同类开源模型。

2. 零样本语音克隆:从"形似"到"神似"的跨越

不同于传统系统仅复制音色,VoxCPM能捕捉说话人的微特征:

- 方言适配:支持四川话、粤语等多方言克隆,如将"风车车,你不要跑"生成标准川渝口音

- 情感迁移:通过参考音频复制愤怒、惊喜等情绪,语音情感识别准确率达82%

- 节奏控制:模拟演讲者的语速变化,如新闻播报的平稳节奏与rap的快节奏切换

3. 实时高效:消费级硬件的流畅体验

在NVIDIA RTX 4090 GPU上,VoxCPM实时因子(RTF)达到0.17,意味着生成10秒语音仅需1.7秒。支持流式合成模式,首包输出延迟低于300ms,满足智能助手、实时客服等交互场景需求。

从图中可以看出,海报重点标注了VoxCPM的三大技术模块:层次化语言建模、有限标量量化(FSQ)和局部扩散模块。这种架构设计使模型在1.8百万小时双语语料训练基础上,同时实现高拟真度与高效率,为开发者提供兼顾性能与成本的解决方案。

行业影响:轻量化模型开启普惠AI语音时代

1. 降低企业级语音应用门槛

外贸企业已开始应用VoxCPM构建多语言智能客服:通过克隆母语客服声音,生成带地方口音的产品介绍语音,客户响应率提升40%。某跨境电商案例显示,使用目标市场语言+本土口音的语音营销,转化率比标准语音高2.3倍。

2. 重塑人机交互体验

在教育领域,VoxCPM支持将数学公式如"△ABC∽△DEF,AB:DE=1:2"转换为自然朗读,解决传统TTS对符号处理的生硬问题。游戏开发者可快速克隆配音演员声音,实现角色语音动态生成,将配音成本降低60%。

3. 开源生态加速技术迭代

模型已在GitCode开源(仓库地址:https://gitcode.com/OpenBMB/VoxCPM-0.5B),提供Python API与Web Demo。开发者可通过简单代码实现语音克隆:

import soundfile as sf

from voxcpm import VoxCPM

model = VoxCPM.from_pretrained("openbmb/VoxCPM-0.5B")

wav = model.generate(

text="目标文本",

prompt_wav_path="参考音频.wav"

)

sf.write("output.wav", wav, 16000)

如上图所示,该架构图清晰展示了VoxCPM从文本输入到语音输出的完整端到端流程,突出了无分词器设计的核心思路。这一创新架构充分体现了VoxCPM对传统TTS技术路径的革新,为读者理解其内部工作机制提供了直观的视觉参考。

行业影响与趋势

VoxCPM以0.5B参数实现此前大模型才能达到的拟真度,印证了TTS技术正从"堆参数"转向"架构创新"的发展趋势。未来随着多语言支持(当前以中英双语为主)和移动端优化的推进,轻量化语音模型有望在智能硬件、车载系统等终端设备实现规模化落地。

不过需注意技术伦理风险:其高度逼真的克隆能力可能被用于语音欺诈。建议开发者部署时加入水印检测机制,或采用声纹比对技术防范滥用。对于普通用户,体验语音克隆功能时应选择可信平台,避免上传个人声音样本至非正规服务。

总结:语音合成进入"小而美"时代

VoxCPM的开源释放为语音技术普及提供了关键工具,随着生态完善,我们或将迎来"人人都能定制AI声音"的普惠时代。企业可重点关注以下应用方向:

- 跨境服务:构建带地方口音的多语言智能客服

- 内容创作:游戏、动漫角色语音快速生成

- 无障碍沟通:为语言障碍者提供个性化语音代理

- 教育科技:开发带情感互动的AI教学助手

建议开发者通过官方仓库获取最新模型权重,结合自身业务场景进行微调优化,同时密切关注社区的插件生态(如ComfyUI集成、WebUI工具等),快速实现技术落地。

atomcodeClaude Code 的开源替代方案。连接任意大模型,编辑代码,运行命令,自动验证 — 全自动执行。用 Rust 构建,极致性能。 | An open-source alternative to Claude Code. Connect any LLM, edit code, run commands, and verify changes — autonomously. Built in Rust for speed. Get StartedRust0147

atomcodeClaude Code 的开源替代方案。连接任意大模型,编辑代码,运行命令,自动验证 — 全自动执行。用 Rust 构建,极致性能。 | An open-source alternative to Claude Code. Connect any LLM, edit code, run commands, and verify changes — autonomously. Built in Rust for speed. Get StartedRust0147- DDeepSeek-V4-ProDeepSeek-V4-Pro(总参数 1.6 万亿,激活 49B)面向复杂推理和高级编程任务,在代码竞赛、数学推理、Agent 工作流等场景表现优异,性能接近国际前沿闭源模型。Python00

GLM-5.1GLM-5.1是智谱迄今最智能的旗舰模型,也是目前全球最强的开源模型。GLM-5.1大大提高了代码能力,在完成长程任务方面提升尤为显著。和此前分钟级交互的模型不同,它能够在一次任务中独立、持续工作超过8小时,期间自主规划、执行、自我进化,最终交付完整的工程级成果。Jinja00

GLM-5.1GLM-5.1是智谱迄今最智能的旗舰模型,也是目前全球最强的开源模型。GLM-5.1大大提高了代码能力,在完成长程任务方面提升尤为显著。和此前分钟级交互的模型不同,它能够在一次任务中独立、持续工作超过8小时,期间自主规划、执行、自我进化,最终交付完整的工程级成果。Jinja00 MiniCPM-V-4.6这是 MiniCPM-V 系列有史以来效率与性能平衡最佳的模型。它以仅 1.3B 的参数规模,实现了性能与效率的双重突破,在全球同尺寸模型中登顶,全面超越了阿里 Qwen3.5-0.8B 与谷歌 Gemma4-E2B-it。Jinja00

MiniCPM-V-4.6这是 MiniCPM-V 系列有史以来效率与性能平衡最佳的模型。它以仅 1.3B 的参数规模,实现了性能与效率的双重突破,在全球同尺寸模型中登顶,全面超越了阿里 Qwen3.5-0.8B 与谷歌 Gemma4-E2B-it。Jinja00 Intern-S2-PreviewIntern-S2-Preview,这是一款高效的350亿参数科学多模态基础模型。除了常规的参数与数据规模扩展外,Intern-S2-Preview探索了任务扩展:通过提升科学任务的难度、多样性与覆盖范围,进一步释放模型能力。Python00

Intern-S2-PreviewIntern-S2-Preview,这是一款高效的350亿参数科学多模态基础模型。除了常规的参数与数据规模扩展外,Intern-S2-Preview探索了任务扩展:通过提升科学任务的难度、多样性与覆盖范围,进一步释放模型能力。Python00 skillhubopenJiuwen 生态的 Skill 托管与分发开源方案,支持自建与可选 ClawHub 兼容。Python0111

skillhubopenJiuwen 生态的 Skill 托管与分发开源方案,支持自建与可选 ClawHub 兼容。Python0111