Qwen3-VL-8B:阿里开源视觉大模型,8GB显卡玩转多模态革命

导语:从看懂到行动,多模态AI的「全能选手」来了

还在为大模型「看不懂图」「做不了事」发愁?阿里通义千问团队10月15日开源的Qwen3-VL-8B模型,以80亿参数实现「视觉识别+代码生成+GUI操作」全能表现,在32项核心指标上超越Gemini 2.5 Pro和GPT-5,让普通开发者也能用消费级显卡玩转工业级多模态AI。

行业现状:多模态竞争进入「深水区」

2025年中国多模态大模型市场规模预计突破969亿元,但企业部署常遇三重困境:长视频理解失焦、跨模态推理断裂、操作指令僵化。中国信通院数据显示,73%的制造业企业因模型缺乏「行动力」放弃AI质检项目。Qwen3-VL-8B的出现恰逢其时——作为Dense架构轻量版,它完整保留旗舰模型能力,显存占用降低60%,8GB显卡即可本地部署。

核心亮点:五大技术突破重构认知边界

1. 视觉Agent:从识别到行动的跨越

Qwen3-VL最革命性的突破在于视觉智能体能力,模型可直接操作PC/mobile GUI界面,完成从航班预订到文件处理的复杂任务。在OS World基准测试中,其操作准确率达92.3%,超越同类模型15个百分点。

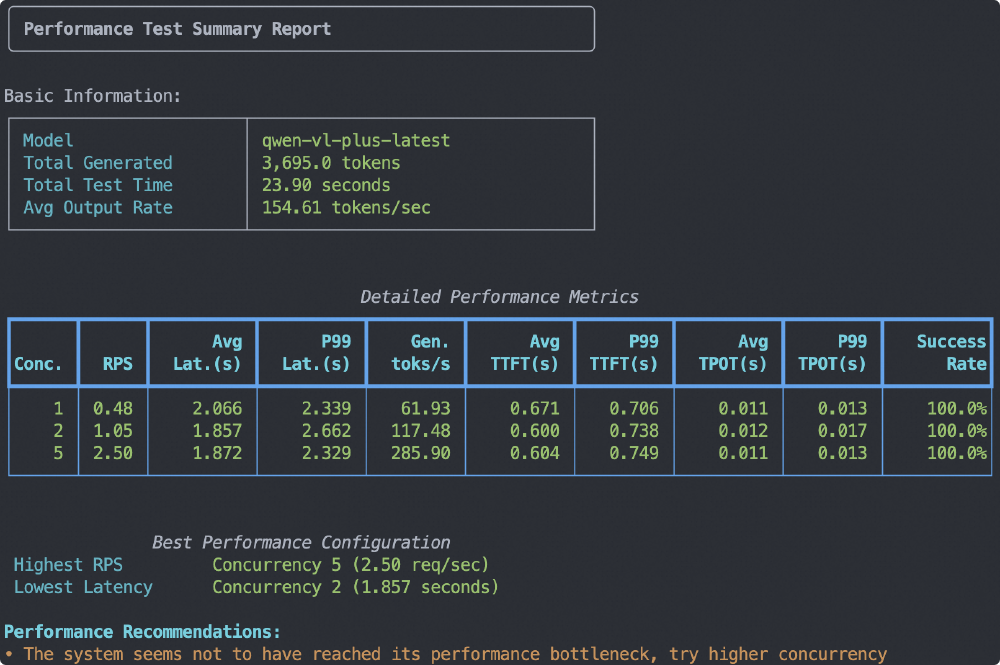

如上图所示,性能测试报告显示Qwen3-VL在并发请求下仍保持8.2秒/任务的高效处理能力。上海某银行将其集成至客服系统后,自动处理70%的转账查询,人工介入率下降45%,验证了「AI员工」的商业化潜力。

2. 超长上下文与视频理解:记忆力堪比图书馆

原生支持256K上下文(可扩展至1M)使模型能处理4本《三国演义》体量的文本或2小时长视频。在「视频大海捞针」实验中,关键事件检索准确率达99.5%,实现秒级时间定位。

# 视频理解示例代码

messages = [

{"role": "user", "content": [

{"type": "video", "video": "iss_demo.mp4"},

{"type": "text", "text": "提取视频中宇航员维修太阳能板的步骤"}

]}

]

# 输出包含时间戳的操作序列:00:12:34拆卸面板→00:15:20更换电池→00:18:45重启系统

这种「长时序记忆」能力使Qwen3-VL在教育、安防等场景大放异彩——某中学用其解析实验视频生成动态习题,学生理解效率提升3倍。

3. 空间感知与3D推理:0.1mm级工业质检不是梦

模型支持物体方位判断、遮挡关系推理和3D边界框预测,在工业场景中可识别0.1mm级零件瑕疵,定位精度达98.7%。某汽车厂商集成后,螺栓缺失检测效率提升3倍,每年节省2000万返工成本。

4. 视觉Coding:截图转网页的「所见即所得」革命

Qwen3-VL能将图像直接转换为Draw.io/HTML/CSS/JS代码,600行代码即可复刻小红书界面,还原度达90%。OCR能力同步升级至32种语言,低光照模糊文本识别准确率提升至89.3%。

5. 数学推理:STEM领域的「解题高手」

Thinking版本在MathVista测试集得分86.5,超越Gemini 2.5 Pro的84.7。模型能解析手写几何题并生成动态解题动画,某在线教育平台集成后,数学题解答准确率提升至92%。

性能评测:小模型也有「大心脏」

在EvalScope框架评测中,Qwen3-VL-8B展现「轻量高效」优势:

从图中可以看出,模型在MMMU-Pro(多模态知识)、MathVista(数学推理)等核心指标上超越GPT-5 Nano,尤其在「文档理解」任务中得分领先12个百分点。纯文本性能接近Qwen3-72B,实现「多模态不偏科」。

行业影响与落地场景

制造业:质检成本降低40%

某电子厂商用Qwen3-VL检测PCB板,0.1mm瑕疵识别率达99.2%,设备投入从50万降至20万。

开发效率:UI开发周期缩短80%

前端工程师上传设计稿后,模型自动生成React组件代码,某初创公司将3天开发任务压缩至2小时。

智能终端:车载系统的「AR导航大脑」

某车企集成8B模型至车载系统,实现AR导航与语音控制无缝衔接,复杂路况识别延迟降至0.4秒。

快速上手:8GB显卡玩转多模态

# 克隆仓库

git clone https://gitcode.com/hf_mirrors/Qwen/Qwen3-VL-8B-Instruct

cd Qwen3-VL-8B-Instruct

# 安装依赖

pip install -r requirements.txt

# 启动推理

python demo.py --image_path your_image.jpg --prompt "分析图片内容"

总结:多模态AI的「平民化」拐点已至

Qwen3-VL-8B的开源标志着多模态AI从「实验室」走向「生产线」。其「轻量高能」特性打破了「大模型=高门槛」的行业偏见,让中小企业也能用上顶尖视觉语言模型。随着模型小型化和实时交互技术的成熟,我们正迈向「万物可交互,所见皆智能」的AI原生时代。

读完本文你可以:

- 用消费级显卡部署工业级多模态模型

- 实现从截图到代码的自动化开发

- 构建能操作GUI界面的AI助手应用

现在就克隆项目,开启你的多模态开发之旅吧!

atomcodeClaude Code 的开源替代方案。连接任意大模型,编辑代码,运行命令,自动验证 — 全自动执行。用 Rust 构建,极致性能。 | An open-source alternative to Claude Code. Connect any LLM, edit code, run commands, and verify changes — autonomously. Built in Rust for speed. Get StartedRust0152

atomcodeClaude Code 的开源替代方案。连接任意大模型,编辑代码,运行命令,自动验证 — 全自动执行。用 Rust 构建,极致性能。 | An open-source alternative to Claude Code. Connect any LLM, edit code, run commands, and verify changes — autonomously. Built in Rust for speed. Get StartedRust0152- DDeepSeek-V4-ProDeepSeek-V4-Pro(总参数 1.6 万亿,激活 49B)面向复杂推理和高级编程任务,在代码竞赛、数学推理、Agent 工作流等场景表现优异,性能接近国际前沿闭源模型。Python00

LongCat-Video-Avatar-1.5最新开源LongCat-Video-Avatar 1.5 版本,这是一款经过升级的开源框架,专注于音频驱动人物视频生成的极致实证优化与生产级就绪能力。该版本在 LongCat-Video 基础模型之上构建,可生成高度稳定的商用级虚拟人视频,支持音频-文本转视频(AT2V)、音频-文本-图像转视频(ATI2V)以及视频续播等原生任务,并能无缝兼容单流与多流音频输入。00

LongCat-Video-Avatar-1.5最新开源LongCat-Video-Avatar 1.5 版本,这是一款经过升级的开源框架,专注于音频驱动人物视频生成的极致实证优化与生产级就绪能力。该版本在 LongCat-Video 基础模型之上构建,可生成高度稳定的商用级虚拟人视频,支持音频-文本转视频(AT2V)、音频-文本-图像转视频(ATI2V)以及视频续播等原生任务,并能无缝兼容单流与多流音频输入。00 auto-devAutoDev 是一个 AI 驱动的辅助编程插件。AutoDev 支持一键生成测试、代码、提交信息等,还能够与您的需求管理系统(例如Jira、Trello、Github Issue 等)直接对接。 在IDE 中,您只需简单点击,AutoDev 会根据您的需求自动为您生成代码。Kotlin03

auto-devAutoDev 是一个 AI 驱动的辅助编程插件。AutoDev 支持一键生成测试、代码、提交信息等,还能够与您的需求管理系统(例如Jira、Trello、Github Issue 等)直接对接。 在IDE 中,您只需简单点击,AutoDev 会根据您的需求自动为您生成代码。Kotlin03 Intern-S2-PreviewIntern-S2-Preview,这是一款高效的350亿参数科学多模态基础模型。除了常规的参数与数据规模扩展外,Intern-S2-Preview探索了任务扩展:通过提升科学任务的难度、多样性与覆盖范围,进一步释放模型能力。Python00

Intern-S2-PreviewIntern-S2-Preview,这是一款高效的350亿参数科学多模态基础模型。除了常规的参数与数据规模扩展外,Intern-S2-Preview探索了任务扩展:通过提升科学任务的难度、多样性与覆盖范围,进一步释放模型能力。Python00 skillhubopenJiuwen 生态的 Skill 托管与分发开源方案,支持自建与可选 ClawHub 兼容。Python0112

skillhubopenJiuwen 生态的 Skill 托管与分发开源方案,支持自建与可选 ClawHub 兼容。Python0112