Galgame翻译神器LunaTranslator:支持20+翻译引擎的全能平台

LunaTranslator作为一款专为Galgame设计的翻译工具,集成了HOOK、OCR、剪贴板等多种翻译模式,支持20+主流翻译引擎,为视觉小说玩家提供无缝翻译体验。本文将详细介绍其核心功能、翻译引擎架构及实战应用场景。

核心翻译模式解析

HOOK模式:深度集成游戏进程

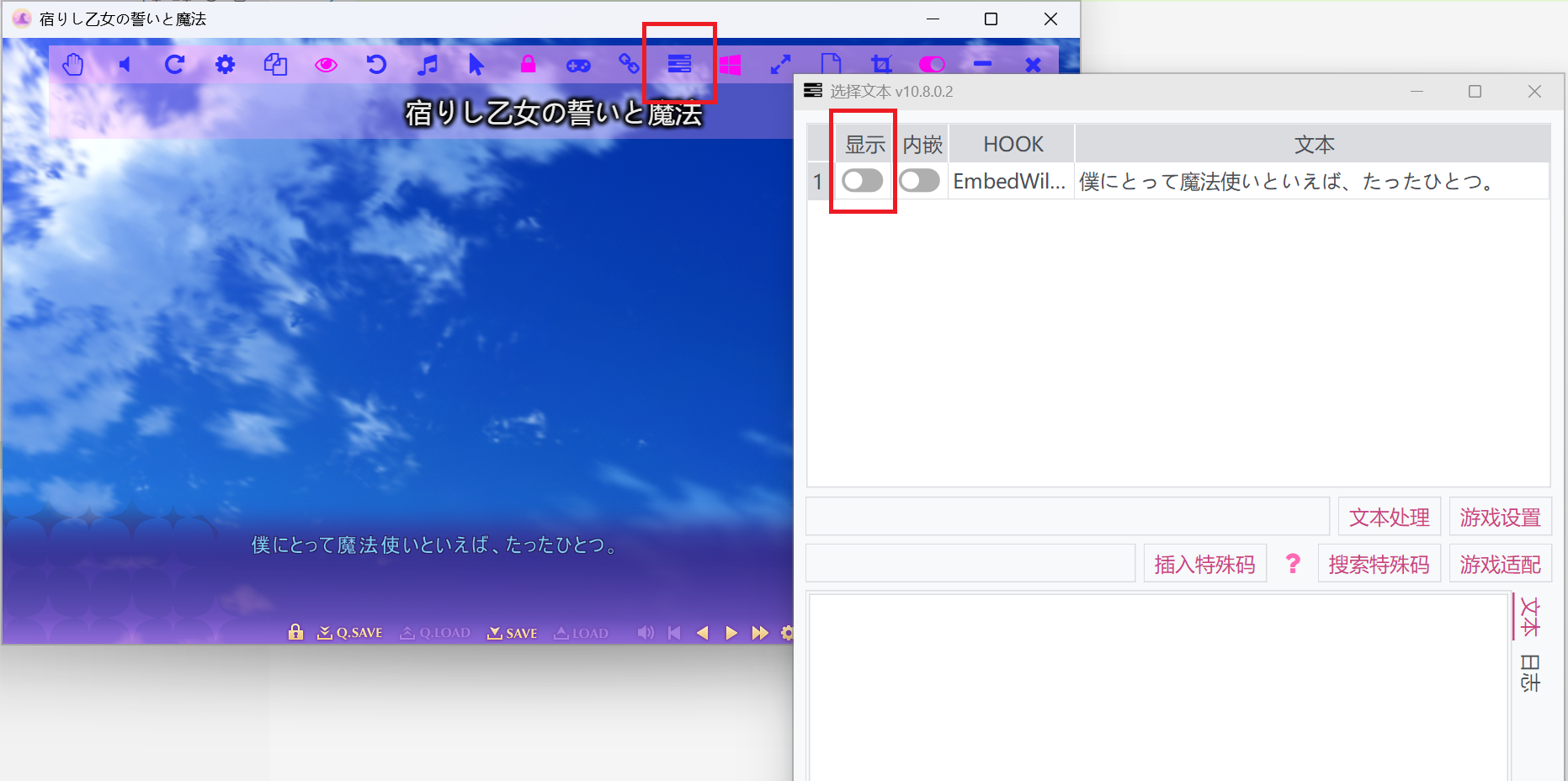

HOOK模式通过注入游戏进程实现文本实时捕获,无需手动选择即可自动翻译对话内容。操作流程如下:

- 在已启动游戏的情况下,打开进程选择窗口并注入目标游戏

- 游戏运行后自动识别候选文本行,用户仅需选择匹配的文本即可开始翻译

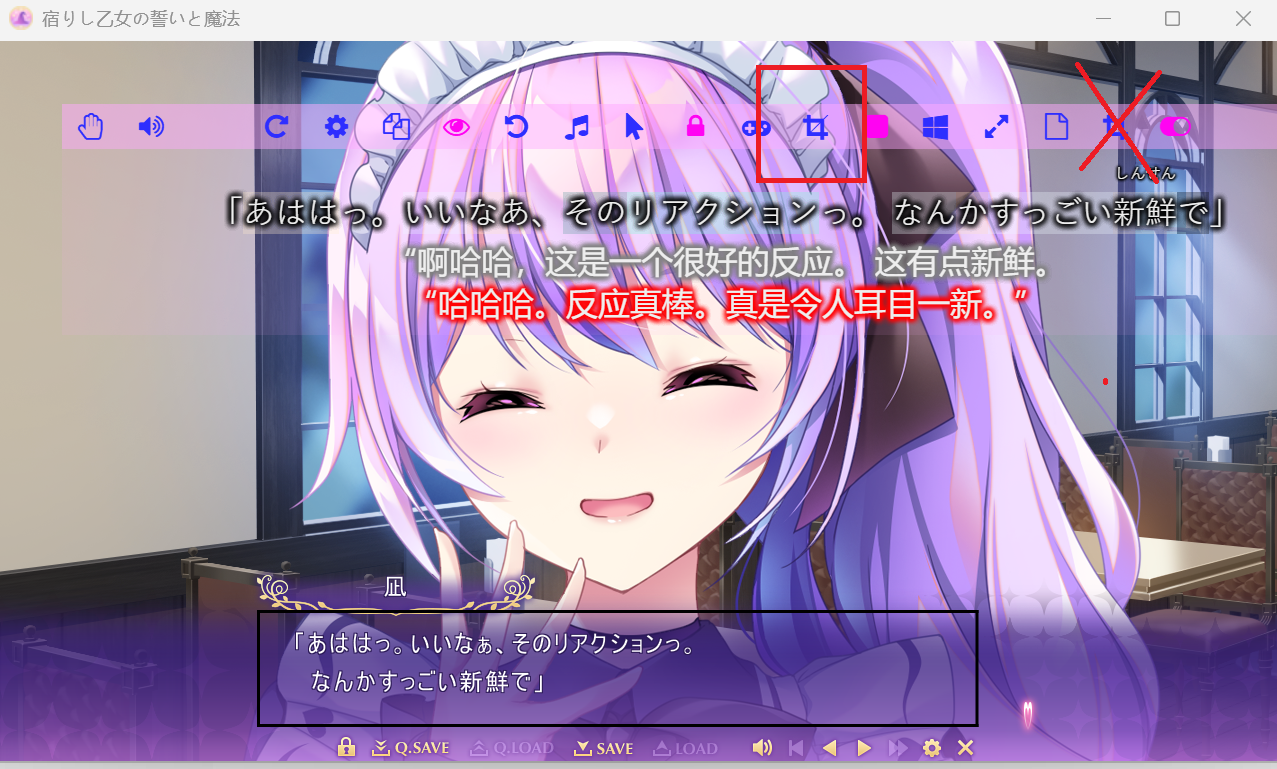

- 支持内嵌翻译功能,直接在游戏界面显示译文

技术实现:HOOK核心代码位于src/LunaTranslator/windows.py,通过Windows API实现进程注入与内存文本捕获

OCR模式:图像文本精准识别

针对不支持HOOK的游戏,OCR模式提供屏幕区域识别功能:

- 手动框选游戏文本区域实现实时识别

- 支持多种OCR引擎切换,包括百度、谷歌云视觉等

- 提供临时识别与持续识别两种模式

混合翻译方案

对于复杂场景,可组合使用多种模式:

- HOOK+OCR:主要文本用HOOK捕获,特殊UI文本用OCR补充

- 剪贴板监听:复制游戏文本自动触发翻译

- 拖拽启动:将游戏程序拖拽至软件窗口自动完成转区与HOOK

多引擎翻译架构

翻译引擎抽象设计

LunaTranslator采用面向对象设计,所有翻译引擎继承自basetranslator.py中的basetrans基类,统一实现以下核心方法:

class basetrans(commonbase):

def translate(self, content): # 核心翻译接口

return ""

def langmap(self): # 语言代码映射

return {}

def init(self): # 引擎初始化

pass

20+翻译引擎矩阵

项目在src/LunaTranslator/translator/目录下实现了丰富的翻译引擎,包括:

- 在线API:谷歌、百度、腾讯、DeepL、ChatGPT等

- 离线引擎:Sakura、本地部署模型

- 特殊用途:Yandex(小语种)、Papago(韩语)、Lingva(开源替代)

每个引擎独立封装为单独模块,如baiduapi.py实现百度翻译接口,sakura.py处理本地模型调用。

智能缓存机制

系统实现二级缓存策略提升翻译效率:

- 内存短期缓存:保存最近翻译结果,毫秒级响应

- SQLite长期缓存:持久化存储历史翻译,路径为

cache/{translator_name}.sqlite

缓存逻辑在basetranslator.py中实现,自动处理相同文本的重复翻译请求。

实战应用场景

经典游戏翻译配置

以日系Galgame为例,推荐配置组合:

- 文本捕获:HOOK模式(src/LunaTranslator/windows.py)

- 翻译引擎:DeepL(精准度)+ 百度翻译(中日优化)

- 辅助功能:TTS语音朗读(src/LunaTranslator/tts/)

复杂场景解决方案

- 图像文本处理:启用MangaOCR引擎处理竖排日文

- 翻译优化:通过transoptimi/模块实现术语库管理

- 多语言切换:在language.py中定义的语言映射表支持40+语种

扩展与定制

翻译引擎扩展开发

开发者可通过继承basetrans类快速集成新引擎:

class NewTranslator(basetrans):

def init(self):

# 初始化代码

self.api_key = config.get("api_key")

def translate(self, content):

# 实现翻译逻辑

return self._call_api(content)

自定义快捷键

通过fastkeys.md配置文件可自定义操作热键,支持全局与应用内两种模式。

安装与获取

项目源码托管于GitCode,可通过以下命令获取:

git clone https://gitcode.com/GitHub_Trending/lu/LunaTranslator.git

完整使用文档参见官方中文手册,包含详细配置教程与常见问题解答。

提示:定期关注更新日志获取新功能通知,社区贡献可提交PR至develop分支

LunaTranslator通过模块化设计与开放架构,持续进化以应对Galgame翻译的复杂需求,无论是普通玩家还是技术爱好者,都能找到适合自己的使用方式。

atomcodeClaude Code 的开源替代方案。连接任意大模型,编辑代码,运行命令,自动验证 — 全自动执行。用 Rust 构建,极致性能。 | An open-source alternative to Claude Code. Connect any LLM, edit code, run commands, and verify changes — autonomously. Built in Rust for speed. Get StartedRust0152

atomcodeClaude Code 的开源替代方案。连接任意大模型,编辑代码,运行命令,自动验证 — 全自动执行。用 Rust 构建,极致性能。 | An open-source alternative to Claude Code. Connect any LLM, edit code, run commands, and verify changes — autonomously. Built in Rust for speed. Get StartedRust0152- DDeepSeek-V4-ProDeepSeek-V4-Pro(总参数 1.6 万亿,激活 49B)面向复杂推理和高级编程任务,在代码竞赛、数学推理、Agent 工作流等场景表现优异,性能接近国际前沿闭源模型。Python00

LongCat-Video-Avatar-1.5最新开源LongCat-Video-Avatar 1.5 版本,这是一款经过升级的开源框架,专注于音频驱动人物视频生成的极致实证优化与生产级就绪能力。该版本在 LongCat-Video 基础模型之上构建,可生成高度稳定的商用级虚拟人视频,支持音频-文本转视频(AT2V)、音频-文本-图像转视频(ATI2V)以及视频续播等原生任务,并能无缝兼容单流与多流音频输入。00

LongCat-Video-Avatar-1.5最新开源LongCat-Video-Avatar 1.5 版本,这是一款经过升级的开源框架,专注于音频驱动人物视频生成的极致实证优化与生产级就绪能力。该版本在 LongCat-Video 基础模型之上构建,可生成高度稳定的商用级虚拟人视频,支持音频-文本转视频(AT2V)、音频-文本-图像转视频(ATI2V)以及视频续播等原生任务,并能无缝兼容单流与多流音频输入。00 auto-devAutoDev 是一个 AI 驱动的辅助编程插件。AutoDev 支持一键生成测试、代码、提交信息等,还能够与您的需求管理系统(例如Jira、Trello、Github Issue 等)直接对接。 在IDE 中,您只需简单点击,AutoDev 会根据您的需求自动为您生成代码。Kotlin03

auto-devAutoDev 是一个 AI 驱动的辅助编程插件。AutoDev 支持一键生成测试、代码、提交信息等,还能够与您的需求管理系统(例如Jira、Trello、Github Issue 等)直接对接。 在IDE 中,您只需简单点击,AutoDev 会根据您的需求自动为您生成代码。Kotlin03 Intern-S2-PreviewIntern-S2-Preview,这是一款高效的350亿参数科学多模态基础模型。除了常规的参数与数据规模扩展外,Intern-S2-Preview探索了任务扩展:通过提升科学任务的难度、多样性与覆盖范围,进一步释放模型能力。Python00

Intern-S2-PreviewIntern-S2-Preview,这是一款高效的350亿参数科学多模态基础模型。除了常规的参数与数据规模扩展外,Intern-S2-Preview探索了任务扩展:通过提升科学任务的难度、多样性与覆盖范围,进一步释放模型能力。Python00 skillhubopenJiuwen 生态的 Skill 托管与分发开源方案,支持自建与可选 ClawHub 兼容。Python0112

skillhubopenJiuwen 生态的 Skill 托管与分发开源方案,支持自建与可选 ClawHub 兼容。Python0112