bpftime:用户态eBPF运行时,加速Uprobe与Syscall Hook

项目介绍

bpftime 是一个功能全面、高性能的用户态eBPF运行时,专为在用户空间中运行eBPF程序而设计。它提供了快速的用户态Uprobe和Syscall Hook功能,能够在不重启或手动重新编译的情况下,安全高效地挂钩和过滤进程的所有系统调用。bpftime 的核心优势在于其用户态Uprobe的性能,相比内核态Uprobe,速度提升了10倍!

项目技术分析

bpftime 的核心技术包括:

- 二进制重写基础的Uprobe和Syscall Hook:通过二进制重写技术,

bpftime能够在用户空间中运行eBPF程序,并将其附加到Uprobes和Syscall跟踪点上。无需手动插桩或重启,即可实现函数的跟踪和执行路径的修改。 - 高性能:用户态Uprobe的开销比内核态Uprobe低10倍,用户态内存的读写速度也优于内核态eBPF。

- 进程间eBPF映射:在共享用户态内存中实现eBPF映射,用于汇总聚合或控制平面通信。

- 兼容性:支持使用现有的eBPF工具链(如clang、libbpf和bpftrace)开发用户态eBPF应用程序,无需任何修改。支持CO-RE(Compile Once, Run Everywhere)通过BTF,并提供用户态

ufunc访问。 - 多JIT支持:支持llvmbpf,这是一个由LLVM驱动的高速JIT/AOT编译器,或使用

ubpf JIT和INTERPRETER。虚拟机可以构建为独立的库,类似于ubpf。 - 与内核eBPF协同运行:可以从内核加载用户态eBPF程序,并使用内核eBPF映射与内核eBPF程序(如kprobes和网络过滤器)协同工作。

项目及技术应用场景

bpftime 适用于多种应用场景,包括但不限于:

- 性能监控与调优:通过用户态Uprobe和Syscall Hook,实时监控应用程序的性能瓶颈,无需重启或重新编译。

- 安全审计:安全地挂钩和过滤进程的所有系统调用,用于安全审计和入侵检测。

- 动态插桩:在不重启进程的情况下,动态注入eBPF程序,实现函数的跟踪和行为修改。

- 网络过滤与加速:与内核eBPF协同工作,实现高效的网络过滤和加速。

项目特点

- 高性能:用户态Uprobe的性能比内核态Uprobe高10倍,用户态内存的读写速度也更快。

- 无需重启:无需手动插桩或重启,即可实现函数的跟踪和执行路径的修改。

- 兼容性强:支持现有的eBPF工具链,无需任何修改。

- 多JIT支持:支持多种JIT编译器,包括LLVM和ubpf。

- 与内核eBPF协同:可以与内核eBPF协同工作,实现更强大的功能。

快速开始

使用bpftime,您可以使用熟悉的工具(如clang和libbpf)构建eBPF应用程序,并在用户空间中执行它们。例如,malloc eBPF程序通过uprobe跟踪malloc调用,并使用哈希映射聚合计数。

您可以参考eunomia.dev/bpftime/documents/build-and-test了解如何构建项目,或使用GitHub packages中的容器镜像。

要开始使用,您可以构建并运行基于libbpf的eBPF程序,通过bpftime CLI启动:

make -C example/malloc # 构建eBPF程序示例

bpftime load ./example/malloc/malloc

在另一个shell中,使用eBPF运行目标程序:

$ bpftime start ./example/malloc/victim

Hello malloc!

malloc called from pid 250215

continue malloc...

malloc called from pid 250215

您还可以动态附加eBPF程序到正在运行的进程:

$ ./example/malloc/victim & echo $! # 进程ID为101771

[1] 101771

101771

continue malloc...

continue malloc...

然后附加到它:

$ sudo bpftime attach 101771 # 您可能需要以root权限运行make install

Inject: "/root/.bpftime/libbpftime-agent.so"

Successfully injected. ID: 1

您可以看到原始程序的输出:

$ bpftime load ./example/malloc/malloc

...

12:44:35

pid=247299 malloc calls: 10

pid=247322 malloc calls: 10

或者,您也可以直接在内核eBPF中运行我们的示例eBPF程序,以查看类似的输出。这可以作为bpftime如何与内核eBPF兼容工作的示例。

$ sudo example/malloc/malloc

15:38:05

pid=30415 malloc calls: 1079

pid=30393 malloc calls: 203

pid=29882 malloc calls: 1076

pid=34809 malloc calls: 8

更多详细信息,请参阅eunomia.dev/bpftime/documents/usage。

示例与用例

bpftime 目前正在积极开发中,尚未推荐用于生产环境。请参阅我们的路线图了解详情。我们非常欢迎您的反馈和建议!请随时打开一个issue或联系我们。

更多示例和详细信息,请参考eunomia.dev/bpftime/documents/examples/网页。

示例包括:

- 最小示例的eBPF程序。

- eBPF

Uprobe/USDT跟踪和syscall跟踪:- sslsniff 用于跟踪SSL/TLS未加密数据。

- opensnoop 用于跟踪文件打开系统调用。

- 更多bcc/libbpf-tools。

- 使用bpftrace命令或脚本运行。

- 错误注入:使用

bpf_override_return更改函数行为。 - 将eBPF LLVM JIT/AOT虚拟机用作独立库。

- 用户态XDP eBPF与DPDK。

深入了解

工作原理

bpftime 支持两种模式:

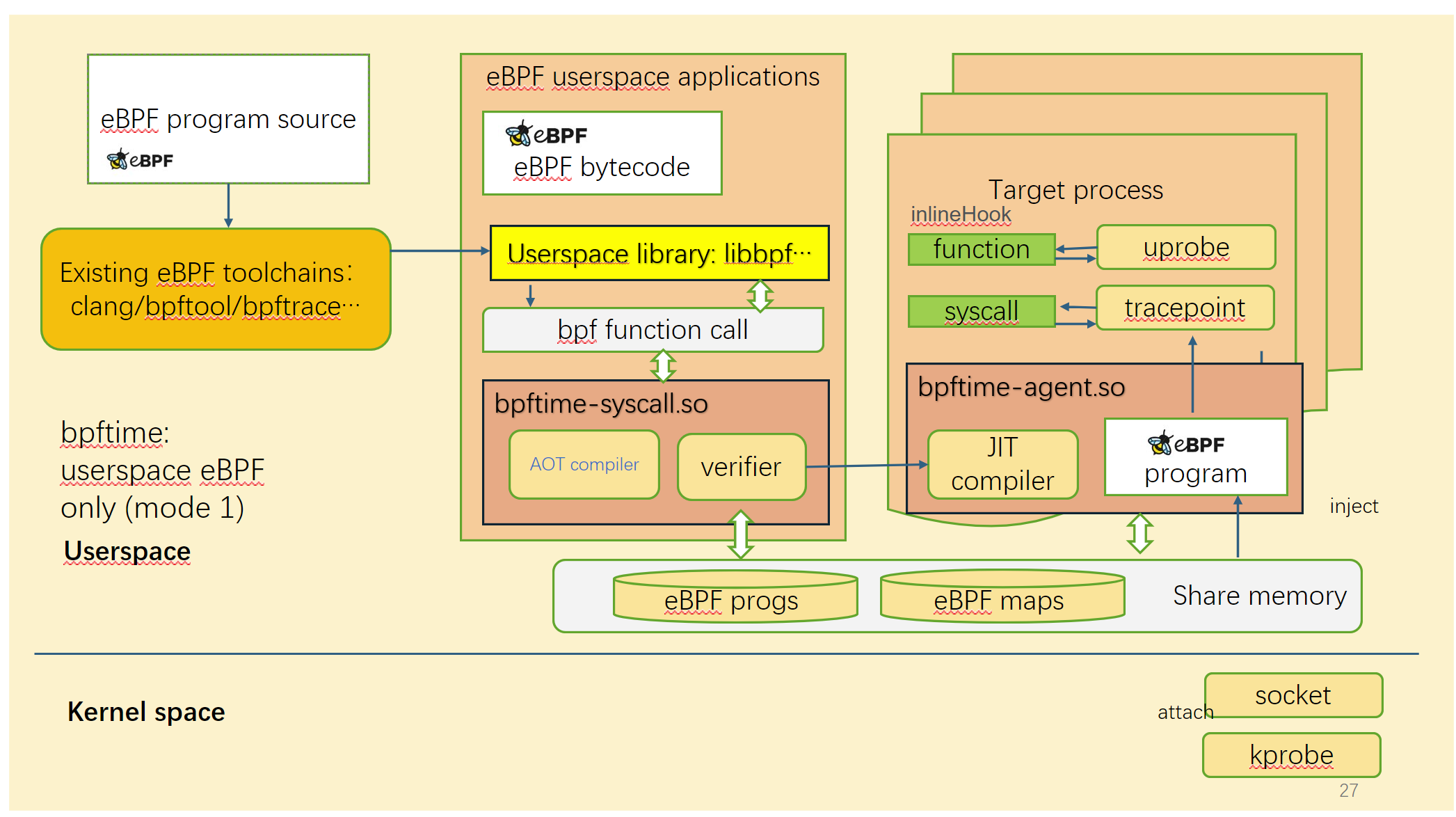

仅在用户空间运行

左侧:原始内核eBPF | 右侧:bpftime

在这种模式下,bpftime 可以在用户空间中运行eBPF程序,无需内核支持,因此可以移植到低版本的Linux或其他系统中,并且无需root权限即可运行。它依赖于用户态验证器来确保eBPF程序的安全性。

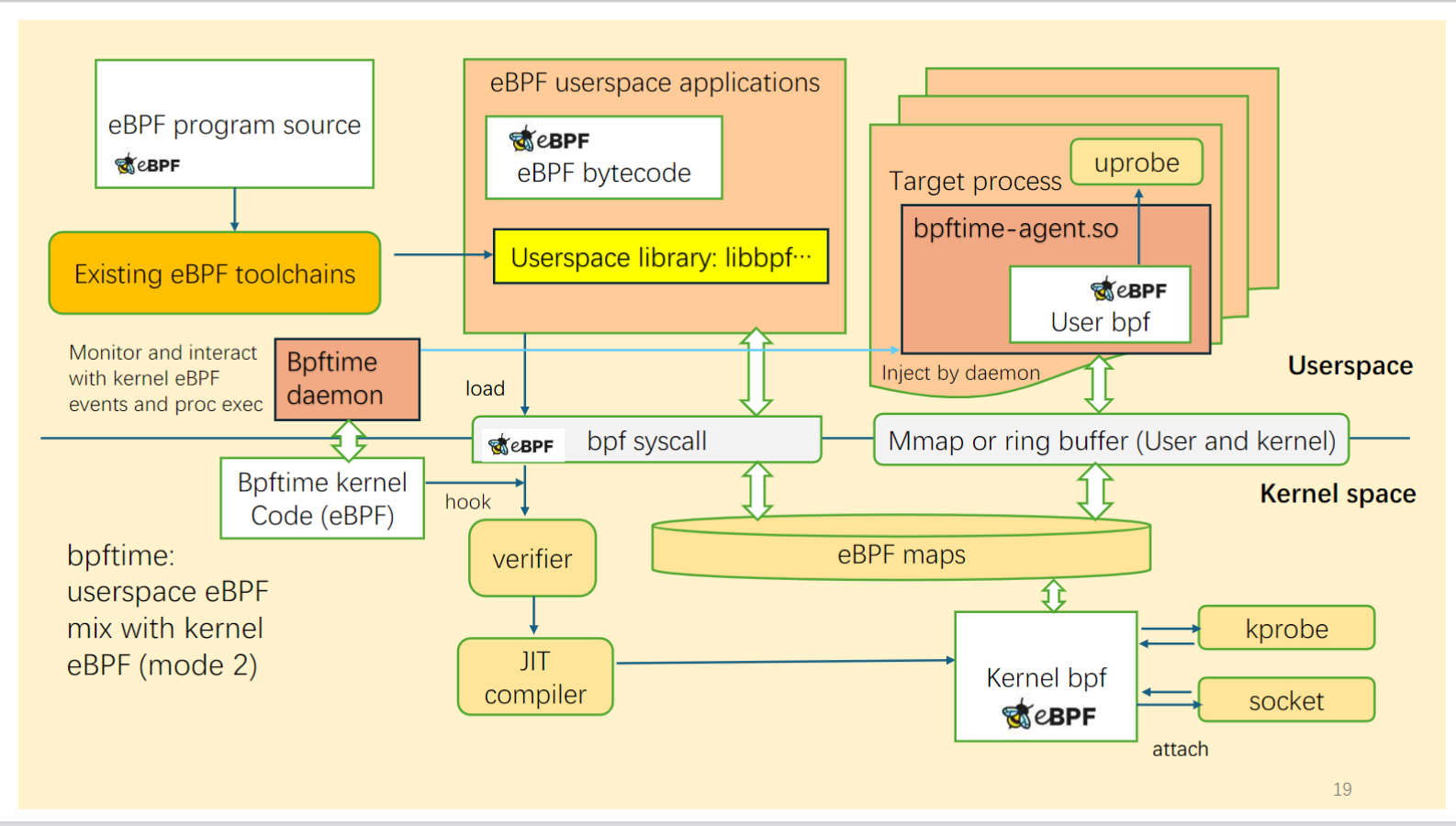

与内核eBPF协同运行

在这种模式下,bpftime 可以与内核eBPF协同运行。它可以从内核加载eBPF程序,并使用内核eBPF映射与内核eBPF程序(如kprobes和网络过滤器)协同工作。

插桩实现

当前的挂钩实现基于二进制重写,底层技术灵感来自:

- 用户态函数挂钩:frida-gum

- 系统调用挂钩:zpoline 和 pmem/syscall_intercept。

挂钩可以轻松替换为其他DBI方法或框架,或在未来添加更多挂钩机制。

更多详细信息,请参阅我们的预印本论文bpftime: userspace eBPF Runtime for Uprobe, Syscall and Kernel-User Interactions。

性能基准测试

用户态Uprobe与内核态Uprobe的性能对比如何?

| 探针/跟踪点类型 | 内核(ns) | 用户态(ns) |

|---|---|---|

| Uprobe | 3224.172760 | 314.569110 |

| Uretprobe | 3996.799580 | 381.270270 |

| 系统调用跟踪点 | 151.82801 | 232.57691 |

| 手动插桩 | 不可用 | 110.008430 |

它可以像内核Uprobe一样附加到正在运行的进程中的函数。

LLVM JIT/AOT与其他eBPF用户态运行时、原生代码或wasm运行时的性能对比如何?

在所有测试中,bpftime的LLVM JIT始终展现出卓越的性能。两者在整数计算(如log2_int)、复杂数学运算(如prime)和内存操作(如memcpy和strcmp)中均表现出高效性。尽管它们在性能上领先,但每个运行时都有其独特的优势和劣势。这些见解有助于选择最适合特定应用场景的运行时。

总结

bpftime 是一个功能强大且高性能的用户态eBPF运行时,适用于多种应用场景。其高性能、无需重启、兼容性强和多JIT支持等特点,使其成为开发和部署eBPF应用程序的理想选择。无论您是性能监控、安全审计还是动态插桩的需求,bpftime 都能为您提供高效、灵活的解决方案。立即尝试bpftime,体验用户态eBPF的强大功能!

atomcodeClaude Code 的开源替代方案。连接任意大模型,编辑代码,运行命令,自动验证 — 全自动执行。用 Rust 构建,极致性能。 | An open-source alternative to Claude Code. Connect any LLM, edit code, run commands, and verify changes — autonomously. Built in Rust for speed. Get StartedRust0153

atomcodeClaude Code 的开源替代方案。连接任意大模型,编辑代码,运行命令,自动验证 — 全自动执行。用 Rust 构建,极致性能。 | An open-source alternative to Claude Code. Connect any LLM, edit code, run commands, and verify changes — autonomously. Built in Rust for speed. Get StartedRust0153- DDeepSeek-V4-ProDeepSeek-V4-Pro(总参数 1.6 万亿,激活 49B)面向复杂推理和高级编程任务,在代码竞赛、数学推理、Agent 工作流等场景表现优异,性能接近国际前沿闭源模型。Python00

LongCat-Video-Avatar-1.5最新开源LongCat-Video-Avatar 1.5 版本,这是一款经过升级的开源框架,专注于音频驱动人物视频生成的极致实证优化与生产级就绪能力。该版本在 LongCat-Video 基础模型之上构建,可生成高度稳定的商用级虚拟人视频,支持音频-文本转视频(AT2V)、音频-文本-图像转视频(ATI2V)以及视频续播等原生任务,并能无缝兼容单流与多流音频输入。00

LongCat-Video-Avatar-1.5最新开源LongCat-Video-Avatar 1.5 版本,这是一款经过升级的开源框架,专注于音频驱动人物视频生成的极致实证优化与生产级就绪能力。该版本在 LongCat-Video 基础模型之上构建,可生成高度稳定的商用级虚拟人视频,支持音频-文本转视频(AT2V)、音频-文本-图像转视频(ATI2V)以及视频续播等原生任务,并能无缝兼容单流与多流音频输入。00 auto-devAutoDev 是一个 AI 驱动的辅助编程插件。AutoDev 支持一键生成测试、代码、提交信息等,还能够与您的需求管理系统(例如Jira、Trello、Github Issue 等)直接对接。 在IDE 中,您只需简单点击,AutoDev 会根据您的需求自动为您生成代码。Kotlin03

auto-devAutoDev 是一个 AI 驱动的辅助编程插件。AutoDev 支持一键生成测试、代码、提交信息等,还能够与您的需求管理系统(例如Jira、Trello、Github Issue 等)直接对接。 在IDE 中,您只需简单点击,AutoDev 会根据您的需求自动为您生成代码。Kotlin03 Intern-S2-PreviewIntern-S2-Preview,这是一款高效的350亿参数科学多模态基础模型。除了常规的参数与数据规模扩展外,Intern-S2-Preview探索了任务扩展:通过提升科学任务的难度、多样性与覆盖范围,进一步释放模型能力。Python00

Intern-S2-PreviewIntern-S2-Preview,这是一款高效的350亿参数科学多模态基础模型。除了常规的参数与数据规模扩展外,Intern-S2-Preview探索了任务扩展:通过提升科学任务的难度、多样性与覆盖范围,进一步释放模型能力。Python00 skillhubopenJiuwen 生态的 Skill 托管与分发开源方案,支持自建与可选 ClawHub 兼容。Python0112

skillhubopenJiuwen 生态的 Skill 托管与分发开源方案,支持自建与可选 ClawHub 兼容。Python0112