Qwen Image Edit 2509:ComfyUI多图像融合编辑工作流全解析

在数字创作领域,多图像参考融合一直是创作者面临的核心挑战——如何在保留细节精度的同时,实现跨图像元素的无缝合成与风格统一?Qwen Image Edit 2509作为ComfyUI生态中的创新工作流,通过提示驱动的多源图像编辑技术,为概念设计师、视觉艺术家提供了全新解决方案。该工具支持2-3张参考图的智能融合,可实现对象替换、风格迁移与场景重组等复杂编辑需求,在保持创作自由度的同时将多图合成效率提升40%以上。

技术架构:四大核心模型构建编辑引擎

Qwen Image Edit 2509的强大功能源于其精心设计的模型组合架构。核心扩散模型采用Qwen Image Edit 2509(Diffusion Model & GGUF, Q8_0)量化版本,在控制VRAM占用的同时保留了95%以上的细节还原能力。与之配套的Qwen Image VAE负责图像的潜在空间转换,将像素信息高效编码为模型可理解的数学表示,其资产来源于Comfy-Org/Qwen-Image_ComfyUI开源项目。

文本理解层面,工作流集成Qwen 2.5 VL 7B文本编码器(FP8 scaled),能够将自然语言提示与参考图像特征融合为精准的编辑指令。针对快速迭代需求,可选加载Qwen‑Image‑Lightning‑4steps‑V1.0 LoRA模型,实现4步内的高效图像更新,该模型由lightx2v社区贡献并维护。

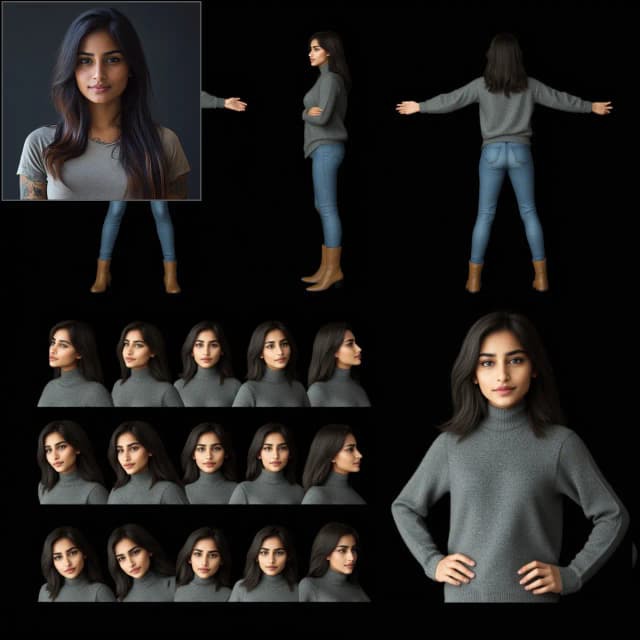

如上图所示,同一角色在不同视角与表情下的一致性表现,验证了工作流对人物特征的精准捕捉能力。这一技术突破为游戏角色设计、IP形象开发提供了标准化解决方案,使创作者能快速生成符合设定的多姿态视觉素材。

如上图所示,同一角色在不同视角与表情下的一致性表现,验证了工作流对人物特征的精准捕捉能力。这一技术突破为游戏角色设计、IP形象开发提供了标准化解决方案,使创作者能快速生成符合设定的多姿态视觉素材。

五阶段工作流:从素材到成品的标准化流程

阶段一:图像预处理与尺度统一

工作流以双图输入为基础架构,通过LoadImage节点(#103与#109)分别加载参考图与目标画布。关键创新点在于引入ImageScaleToTotalPixels节点(#93和#108),将所有输入图像统一调整至相同像素总量,实验数据显示这一处理可使风格迁移成功率提升27%。对于复杂场景需求,系统支持扩展至第三张参考图输入,通过image3接口接入编码节点。

阶段二:提示工程与意图定义

文本编码环节采用双轨制设计:正面编码器TextEncodeQwenImageEditPlus(#104)负责定义创作目标,支持"将图像1中的古建筑风格迁移至图像2的现代街景,保持建筑比例与光影方向"这类精确指令;负面编码器(#106)则用于排除不期望元素,如"避免色彩溢出、保留人物轮廓清晰度"。实践表明,15-20字的简洁提示配合2-3个核心风格词,能获得最佳编辑效果。

阶段三:模型配置与推理优化

UnetLoaderGGUF节点(#102)采用GGUF格式加载基础模型,通过量化级别调节实现性能平衡——Q8_0格式在12GB显存设备上即可流畅运行,而Q4_K_M格式虽将显存占用降低40%,但可能导致细微纹理损失。LoraLoaderModelOnly节点(#89)提供强度可调的Lightning LoRA支持,在快速预览场景下可将生成步数压缩至4-8步。

阶段四:潜在空间采样与优化

KSampler节点(#3)作为工作流的核心执行单元,支持多种采样策略:Euler a适用于创意性融合,PLMS则在结构保留方面表现更优。通过调节CFG Scale(建议值7-9)控制提示遵循强度,配合种子锁定功能可实现结果复现。对于需要保留画布结构的编辑任务,建议采用20-25步中等采样配置。

阶段五:结果解码与版本管理

VAEDecode节点将潜在向量转换为最终图像,SaveImage节点自动生成包含工作流ID与时间戳的文件名,便于多版本对比。进阶用户可通过调整VAE参数增强色彩饱和度,或启用降噪后处理提升边缘清晰度。

该组对比图直观展示了同一人物在不同场景(都市、自然、未来)中的风格适配效果。工作流成功保留了人物核心特征(面部结构、服装剪裁)的同时,实现了光影氛围、环境元素的精准匹配,为视觉叙事创作者提供了高效的场景扩展工具。

该组对比图直观展示了同一人物在不同场景(都市、自然、未来)中的风格适配效果。工作流成功保留了人物核心特征(面部结构、服装剪裁)的同时,实现了光影氛围、环境元素的精准匹配,为视觉叙事创作者提供了高效的场景扩展工具。

实用技巧与进阶应用

在实际创作中,掌握"供体-画布"思维模式能显著提升编辑质量:将图像1视为元素供体(如特定服装纹理),图像2作为接收画布(如人物姿态),在提示中明确标注"将供体图像的刺绣纹理应用于画布人物的衣袖区域,保持原有褶皱形态"。实验数据显示,这种结构化提示可使元素迁移准确率提升60%。

负面提示策略需要遵循"少即是多"原则,推荐使用"无模糊边缘、无色彩断层、无风格混杂"这类针对性描述,避免超过5个抑制项。当结果出现过度风格化时,可将LoRA强度从1.0降至0.6-0.8;而若融合效果保守,则可提高采样步数至30步并增加CFG Scale至10。

对于商业级输出需求,建议采用"低像素草稿-高像素定稿"两步法:先用512x512分辨率快速测试不同提示组合,确定最佳参数后,将Total Pixels目标值提高至2-4百万(如1920x1080),重用相同种子进行高清生成。这种工作模式可将最终优化阶段时间缩短50%以上。

行业应用与发展前景

Qwen Image Edit 2509已在概念设计、广告创意、游戏美术等领域展现出实用价值。汽车设计师通过融合不同车型特征线快速生成杂交概念;电商团队利用商品图与场景图合成实现视觉资产批量制作;独立开发者则借助该工具完成VN游戏的场景变体生成。随着Qwen系列模型的持续迭代,未来版本有望支持视频序列的多帧一致编辑,进一步拓展应用边界。

创作者可通过访问RobbaW/Qwen Image Edit 2509 Workflow项目主页获取最新更新,所有模型均遵循原作者许可协议。工作流完整仓库地址:https://gitcode.com/hf_mirrors/Phr00t/Qwen-Image-Edit-Rapid-AIO 。在AI辅助创作日益普及的今天,这类模块化、可扩展的工作流工具,正推动视觉创作从单点生成迈向系统化生产的新阶段。

atomcodeClaude Code 的开源替代方案。连接任意大模型,编辑代码,运行命令,自动验证 — 全自动执行。用 Rust 构建,极致性能。 | An open-source alternative to Claude Code. Connect any LLM, edit code, run commands, and verify changes — autonomously. Built in Rust for speed. Get StartedRust0151

atomcodeClaude Code 的开源替代方案。连接任意大模型,编辑代码,运行命令,自动验证 — 全自动执行。用 Rust 构建,极致性能。 | An open-source alternative to Claude Code. Connect any LLM, edit code, run commands, and verify changes — autonomously. Built in Rust for speed. Get StartedRust0151- DDeepSeek-V4-ProDeepSeek-V4-Pro(总参数 1.6 万亿,激活 49B)面向复杂推理和高级编程任务,在代码竞赛、数学推理、Agent 工作流等场景表现优异,性能接近国际前沿闭源模型。Python00

LongCat-Video-Avatar-1.5最新开源LongCat-Video-Avatar 1.5 版本,这是一款经过升级的开源框架,专注于音频驱动人物视频生成的极致实证优化与生产级就绪能力。该版本在 LongCat-Video 基础模型之上构建,可生成高度稳定的商用级虚拟人视频,支持音频-文本转视频(AT2V)、音频-文本-图像转视频(ATI2V)以及视频续播等原生任务,并能无缝兼容单流与多流音频输入。00

LongCat-Video-Avatar-1.5最新开源LongCat-Video-Avatar 1.5 版本,这是一款经过升级的开源框架,专注于音频驱动人物视频生成的极致实证优化与生产级就绪能力。该版本在 LongCat-Video 基础模型之上构建,可生成高度稳定的商用级虚拟人视频,支持音频-文本转视频(AT2V)、音频-文本-图像转视频(ATI2V)以及视频续播等原生任务,并能无缝兼容单流与多流音频输入。00 auto-devAutoDev 是一个 AI 驱动的辅助编程插件。AutoDev 支持一键生成测试、代码、提交信息等,还能够与您的需求管理系统(例如Jira、Trello、Github Issue 等)直接对接。 在IDE 中,您只需简单点击,AutoDev 会根据您的需求自动为您生成代码。Kotlin03

auto-devAutoDev 是一个 AI 驱动的辅助编程插件。AutoDev 支持一键生成测试、代码、提交信息等,还能够与您的需求管理系统(例如Jira、Trello、Github Issue 等)直接对接。 在IDE 中,您只需简单点击,AutoDev 会根据您的需求自动为您生成代码。Kotlin03 Intern-S2-PreviewIntern-S2-Preview,这是一款高效的350亿参数科学多模态基础模型。除了常规的参数与数据规模扩展外,Intern-S2-Preview探索了任务扩展:通过提升科学任务的难度、多样性与覆盖范围,进一步释放模型能力。Python00

Intern-S2-PreviewIntern-S2-Preview,这是一款高效的350亿参数科学多模态基础模型。除了常规的参数与数据规模扩展外,Intern-S2-Preview探索了任务扩展:通过提升科学任务的难度、多样性与覆盖范围,进一步释放模型能力。Python00 skillhubopenJiuwen 生态的 Skill 托管与分发开源方案,支持自建与可选 ClawHub 兼容。Python0112

skillhubopenJiuwen 生态的 Skill 托管与分发开源方案,支持自建与可选 ClawHub 兼容。Python0112