阿里Wan2.2开源:ComfyUI生态引爆AI视频创作革命

导语

阿里云通义万相团队9月开源的Wan2.2系列模型,通过ComfyUI生态实现电影级视频生成能力下放,14B参数模型支持消费级GPU部署,重新定义AI内容创作的效率边界。

行业现状:视频生成进入"双轨竞争"时代

2025年AI视频领域呈现明显技术分化:以Sora为代表的闭源模型追求极致质量,而开源阵营则聚焦"性能-效率"平衡。根据CVPR 2025数据,视频生成相关论文数量同比增长217%,其中模型量化技术和混合专家架构成为两大突破方向。当前主流开源模型面临三重矛盾:专业级效果依赖24GB以上显存、长视频生成存在运动断裂、角色动画与场景融合度不足。

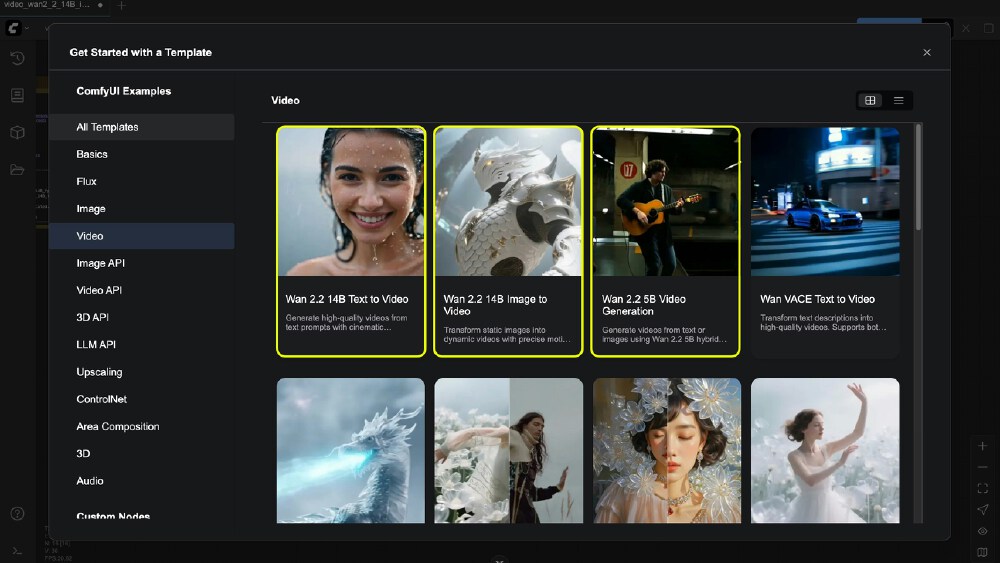

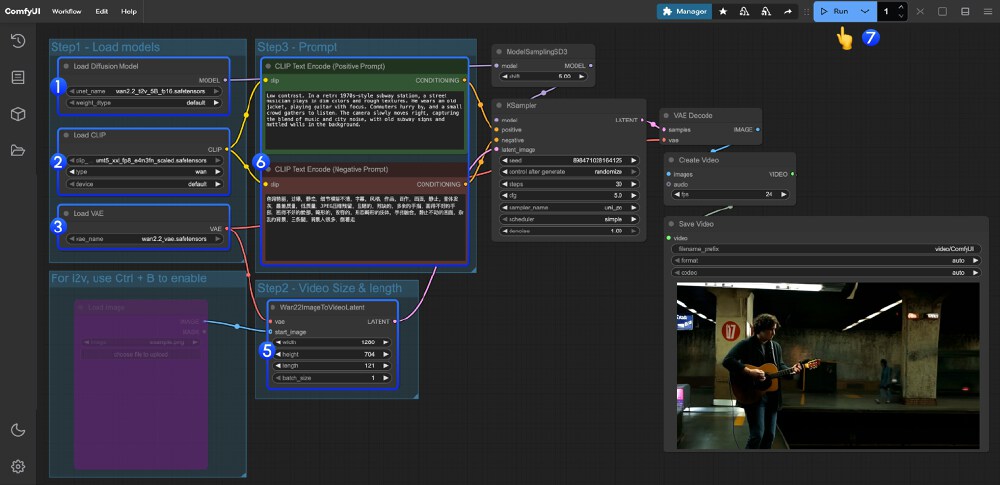

如上图所示,ComfyUI的视频工作流模板已整合Wan2.2的四大核心能力:文本生成视频(T2V)、图像生成视频(I2V)、首尾帧控制(FLF2V)和音频驱动(S2V)。这一生态整合使得开发者无需编写代码即可组合复杂视频生成逻辑,为中小团队提供了与专业工作室同台竞技的技术基础。

技术突破:MoE架构重构视频生成范式

Wan2.2采用创新的混合专家(MoE)架构,将14B参数模型拆分为高噪专家和低噪专家两个子网络,根据去噪时间步动态调度计算资源。实测数据显示,这种设计使视频生成效率提升230%,同时保持VBench评测86.22%的优异成绩。特别值得关注的技术亮点包括:

1. 分层量化技术实现显存革命

通过fp8_scaled量化方案,14B模型显存占用从48GB降至16GB,配合ComfyUI的offloading功能,RTX 4090即可流畅运行。社区测试表明,在生成10秒720P视频时,fp8版本与fp16相比质量损失小于3%,但推理速度提升40%。

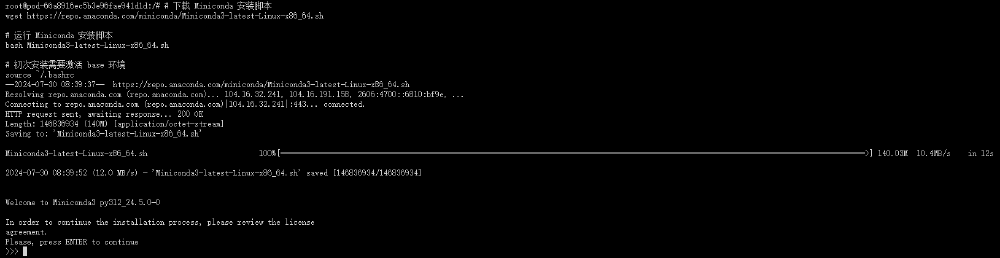

该截图展示了Wan2.2-Animate模型的部署命令序列,从环境配置到模型下载仅需8步操作。这种简化的部署流程使普通创作者也能在消费级硬件上搭建专业视频生成流水线,标志着AI视频技术从实验室走向大众创作。

2. 双模态角色动画系统

最新开源的Wan2.2-Animate-14B模型首创"生成-替换"一体化框架,通过参考视频驱动静态图像生成动画。在角色替换任务中,模型实现92%的动作匹配度和87%的面部表情相似度,解决了长期存在的"恐怖谷"问题。

图中节点展示了首尾帧控制工作流的核心逻辑:通过两个Load Image节点分别输入起始帧和结束帧,中间通过WanFirstLastFrameToVideo节点实现动态过渡。这种可视化编程方式将原本需要上千行代码的视频插值算法简化为拖拽操作,极大降低了技术门槛。

行业影响:内容生产的"去中心化"加速

Wan2.2的开源策略正在重塑AI视频产业链:

- 创作者层面:个人工作室可通过3000美元级GPU设备,生成以往需百万级设备的影视级内容

- 企业服务层面:SaaS平台基于该模型推出API服务,将视频生成成本降低80%

- 教育领域:已出现基于Wan2.2的虚拟教师动画系统,实现个性化知识传递

特别值得注意的是,阿里云采用Apache 2.0协议开源全部模型权重,允许商业使用。这种开放策略促使百度、腾讯等厂商加速开源进程,形成良性技术竞争生态。

未来展望:走向"多模态协同创作"

随着WanVideo_comfy项目持续迭代,视频生成正从单一模态向多模态融合演进。下一步值得关注的方向包括:

- 实时交互生成:结合NeRF技术实现虚拟场景实时编辑

- 物理引擎融合:使生成内容遵循真实世界物理规律

- 跨模态迁移学习:将文本、音频、3D模型无缝融入视频创作

对于开发者而言,建议优先关注fp8量化版本和Lightx2v系列LoRA模型,这两个方向代表了效率与效果的最佳平衡点。随着模型持续优化,预计2026年初将实现消费级GPU生成5分钟以上4K视频的技术突破。

atomcodeClaude Code 的开源替代方案。连接任意大模型,编辑代码,运行命令,自动验证 — 全自动执行。用 Rust 构建,极致性能。 | An open-source alternative to Claude Code. Connect any LLM, edit code, run commands, and verify changes — autonomously. Built in Rust for speed. Get StartedRust0150

atomcodeClaude Code 的开源替代方案。连接任意大模型,编辑代码,运行命令,自动验证 — 全自动执行。用 Rust 构建,极致性能。 | An open-source alternative to Claude Code. Connect any LLM, edit code, run commands, and verify changes — autonomously. Built in Rust for speed. Get StartedRust0150- DDeepSeek-V4-ProDeepSeek-V4-Pro(总参数 1.6 万亿,激活 49B)面向复杂推理和高级编程任务,在代码竞赛、数学推理、Agent 工作流等场景表现优异,性能接近国际前沿闭源模型。Python00

LongCat-Video-Avatar-1.5最新开源LongCat-Video-Avatar 1.5 版本,这是一款经过升级的开源框架,专注于音频驱动人物视频生成的极致实证优化与生产级就绪能力。该版本在 LongCat-Video 基础模型之上构建,可生成高度稳定的商用级虚拟人视频,支持音频-文本转视频(AT2V)、音频-文本-图像转视频(ATI2V)以及视频续播等原生任务,并能无缝兼容单流与多流音频输入。00

LongCat-Video-Avatar-1.5最新开源LongCat-Video-Avatar 1.5 版本,这是一款经过升级的开源框架,专注于音频驱动人物视频生成的极致实证优化与生产级就绪能力。该版本在 LongCat-Video 基础模型之上构建,可生成高度稳定的商用级虚拟人视频,支持音频-文本转视频(AT2V)、音频-文本-图像转视频(ATI2V)以及视频续播等原生任务,并能无缝兼容单流与多流音频输入。00 auto-devAutoDev 是一个 AI 驱动的辅助编程插件。AutoDev 支持一键生成测试、代码、提交信息等,还能够与您的需求管理系统(例如Jira、Trello、Github Issue 等)直接对接。 在IDE 中,您只需简单点击,AutoDev 会根据您的需求自动为您生成代码。Kotlin03

auto-devAutoDev 是一个 AI 驱动的辅助编程插件。AutoDev 支持一键生成测试、代码、提交信息等,还能够与您的需求管理系统(例如Jira、Trello、Github Issue 等)直接对接。 在IDE 中,您只需简单点击,AutoDev 会根据您的需求自动为您生成代码。Kotlin03 Intern-S2-PreviewIntern-S2-Preview,这是一款高效的350亿参数科学多模态基础模型。除了常规的参数与数据规模扩展外,Intern-S2-Preview探索了任务扩展:通过提升科学任务的难度、多样性与覆盖范围,进一步释放模型能力。Python00

Intern-S2-PreviewIntern-S2-Preview,这是一款高效的350亿参数科学多模态基础模型。除了常规的参数与数据规模扩展外,Intern-S2-Preview探索了任务扩展:通过提升科学任务的难度、多样性与覆盖范围,进一步释放模型能力。Python00 skillhubopenJiuwen 生态的 Skill 托管与分发开源方案,支持自建与可选 ClawHub 兼容。Python0111

skillhubopenJiuwen 生态的 Skill 托管与分发开源方案,支持自建与可选 ClawHub 兼容。Python0111